AI研究におけるボトルネックは人間

ChatGPTの開発元であるOpenAIの創設メンバーのひとりとして知られる著名AI研究者のアンドレイ・カルパシー氏が、「AI研究におけるボトルネックは人間である」と主張しました。

Andrej Karpathy: Humans Are the Bottleneck in AI Research

https://winbuzzer.com/2026/03/23/karpathy-humans-bottleneck-ai-research-xcxwbn/

'The Karpathy Loop': 700 experiments, 2 days, and a glimpse of where AI is heading | Fortune

https://fortune.com/2026/03/17/andrej-karpathy-loop-autonomous-ai-agents-future/

カルパシー氏は2026年初頭から数カ月かけて、GPT-2の学習設定を手作業で調整しました。その後、一晩だけAIエージェントにGPT-2の調整を任せたところ、カルパシー氏が見落としていた改善点をAIエージェントが見つけたそうです。

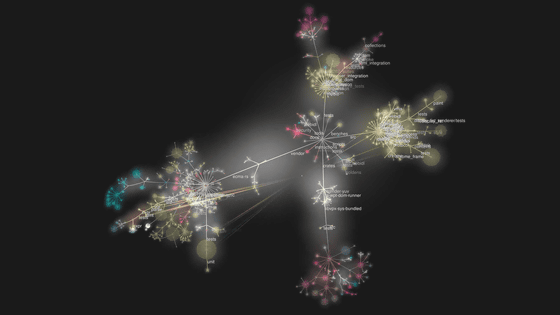

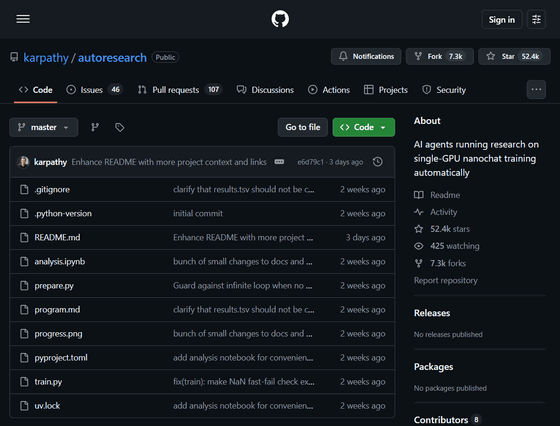

カルパシー氏はこの経験をベースに、「autoresearch」をGitHubで公開しました。

GitHub - karpathy/autoresearch: AI agents running research on single-GPU nanochat training automatically · GitHub

https://github.com/karpathy/autoresearch

カルパシー氏はautoresearchを、「自己完結型の最小リポジトリとしてまとめた」と説明しました。具体的にはカルパシー氏が作成した大規模言語モデル(LLM)をトレーニングするためのシンプルな実験用ハーネスであるnanochatのLLMトレーニングコアを削ぎ落し、単一のNVIDIA H100で動作する、約630行のコードに簡略化したものだそうです。autoresearchの目的はAIエージェントを設計し、ユーザーが関与しなくても無限かつ最速で研究を進展させられるようにすることです。AIエージェントはGitの機能ブランチ上で自律ループとして動作し、より良い設定(最終的な検証損失が低いもの)を見つけるたびに、ニューラルネットワークのアーキテクチャ、オプティマイザ、各種ハイパーパラメータなどについて、トレーニングスクリプトにコミットを積み重ねるよう設計されています。

I packaged up the "autoresearch" project into a new self-contained minimal repo if people would like to play over the weekend. It's basically nanochat LLM training core stripped down to a single-GPU, one file version of ~630 lines of code, then:

— Andrej Karpathy (@karpathy) March 7, 2026

- the human iterates on the… pic.twitter.com/3tyOq2P9c6

カルパシー氏はautoresearchを用いて700回におよぶ実験を実施。AIエージェントはたった一晩で50回の実験を実行し、より良い学習方法を発見し、人間の指示を一切受けることなく、Gitにコミットすることに成功したそうです。AIエージェントはカルパシー氏が見落とした細かな調整も発見し、人間が見落としがちな微調整も見つけることができました。

autoresearchを2日間連続で稼働させると、AIエージェントは小規模言語モデルの学習時間を改善するための方法を20個も見つけたそうです。この調整をLLMに適用すると、学習速度が11%も向上しています。

通常のセッションでは、autoresearchは1時間当たり12種類の実験を実行します。単一のGPUで一晩実行すれば、実行できる実験の数は80~100種類にもおよぶそうです。各実験は一貫したパターンに従っており、AIエージェントは既存のトレーニングスクリプトを読み込み、変更案を提案し、トレーニングループを実行し、結果として得られたスコアを記録し、変更を保持するか破棄するかを決定します。すべての決定はGitにログとして記録されるため、カルパシー氏はAIエージェントが試みたこと、成功したこと、失敗したことの完全な履歴をすべて確認できます。

autoresearchと同じ実験を人間の研究者が手作業で行う場合、フィードバックループは1回の反復につき数分から数時間にまで延び、時間の経過と共に疲労も蓄積していきます。

カルパシー氏はこの経験を基に、YouTubeのポッドキャスト内で「現在利用可能なツールを最大限に活用するには、自分がボトルネックにならないようにしなければいけません。次の行動を促すには、そこにいてはいけません」と語っています。

カルパシー氏によるとautoresearchはこれまでの自動機械学習の取り組みとは根本的に異なるそうです。従来の自動機械学習アプローチは、ランダムな変動または進化アルゴリズムに依存しており、既に試したことについて推論する能力はありませんでした。また、従来の「ニューラルアーキテクチャ探索」は事前に定義されたニューラルネットワークの関数等を並び替えてタスクに最適な構成を発見する手法なので、定義済みの構成要素をシャッフルすることしかできません。しかし、autoresearchは全く新しいトレーニングロジックを記述し、それを単一の数値でテストし、うまくいったものに基づいて構築することができます。そのため、カルパシー氏は従来の自動機械学習アプローチと「比較することは全く役に立たない」と説明しています。

なお、カルパシー氏が公開したautoresearchは、すぐに外部のAI研究者により検証され、AIコミュニティの注目を集めるようになりました。Shopifyのトビアス・リュートケCEOは「社内データにautoresearchを適用したところ、一晩で37回の実験を実行し、全く関係のないコードベースで19%のパフォーマンス向上を達成した」と報告。

LangChainの創設者であるハリソン・チェイス氏は、autoresearchのフォークとして「エージェントのためのautoresearch」を作成。これはAIコーディングエージェントにAIエージェントのコードと評価データセットを与え、自律的に実験させ、コードを修正し、LangSmith経由で評価を実行し、改善されたものは採用し、性能が悪化したものは破棄します。

loved this from @karpathy

— Harrison Chase (@hwchase17) March 9, 2026

over the weekend I built "autoresearch but for agents"

Same idea — give an AI coding agent your agent code + an eval dataset, let it experiment autonomously overnight. It modifies the code, runs evals via LangSmith, keeps improvements, discards… https://t.co/mqWvTLrAjH

なお、カルパシー氏はautoresearchについて、「定量的に評価できる場合にのみ有効」と言及しており、評価に人間の判断や創造性、主観的な評価などが必要な分野では役に立たないと説明しています。

・関連記事

AIの普及に伴って「2種類のAIユーザー」が出現しているとの指摘、どうすればAIで生産性を向上できるのか? - GIGAZINE

AIバブルが崩壊したらどれほど壊滅的な被害をもたらすのか? - GIGAZINE

AIの需要増加によりデータセンターの消費電力が爆増してAI開発のボトルネックになっている - GIGAZINE

AIを開発するために必要なデータが急速に枯渇、たった1年で高品質データの4分の1が使用不可に - GIGAZINE

・関連コンテンツ

in AI, Posted by logu_ii

You can read the machine translated English article The bottleneck in AI research is humans….