2026年5月1日のヘッドラインニュース

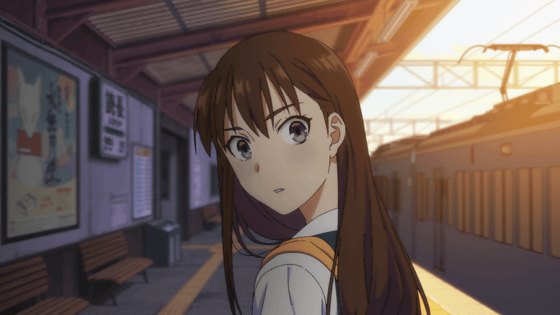

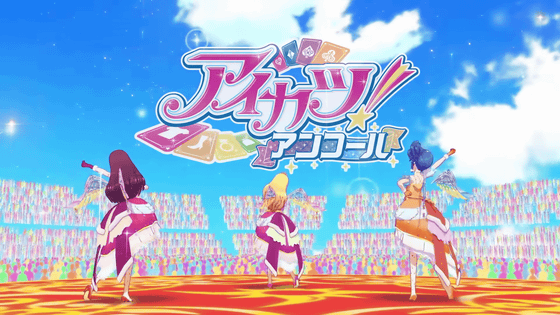

データカードダス『アイカツ!アンコール』が2026年秋から稼働する予定であることが発表されました。稼働にあわせて、アニメ『アイカツ!』のアンコール放送も行われる予定だとのことです。

データカードダス「アイカツ!アンコール」公式サイト

https://dcd.aikatsu.com/encore/

アイカツ!アンコール予告プロモーションビデオ - YouTube

ちなみに、過去の同月同日にはこんな記事を掲載していました。

RISC-Vプロセッサ内蔵でWi-Fi 6とBluetooth 5による無線通信も可能なSoC「ESP32-C5」が登場、すでに開発ボードが2000円台で入手可能 - GIGAZINE

小中学校の生徒によるスマートフォンの使用を制限する法律がフィンランドで成立 - GIGAZINE

「ティラノサウルス革」を作り出そうとする企業が登場するが専門家は問題点を指摘 - GIGAZINE

Reolinkの4Kセキュリティカメラ「TrackMix PoE」と「RLC-833A」のできることの違いを比較してみた&Synology NASにつないでみた - GIGAZINE

人気VTuberのつぶやきをAIによる音声合成で本人の声で再現する「棒読みこち」がすごい - GIGAZINE

砂漠化抑制と緑地増加を目指す計画の一環としてサウジアラビアで人工降雨プロジェクト開始 - GIGAZINE

アラーム音を変更するだけで目覚めが劇的に改善することが判明、どんな音が最適なのか? - GIGAZINE

フォアグラ採取後の鴨ロース「マグレカナール」はどんな味なのか実際に焼いて食べてみた - GIGAZINE

「無知の知」が科学研究で証明される - GIGAZINE

優れたゲームを作るための方法は「地下鉄での読みやすさ」にあり - GIGAZINE

ピンク色のSLが期間限定で走行するところを若桜鉄道若桜駅へ見に行ってきた - GIGAZINE

◆ネタ(メモ・その他いろいろ)

BeRealがフランス製なのは有名でしょう。オーストリアへ逃亡するマリー・アントワネットが承認欲求に負けてBeReal投稿したせいで王室一行がバレンヌで捕まったと世界史の授業で習うからね

— 兵務局 (@Truppenamt) 2026年4月30日

いつか空に届いて pic.twitter.com/AfeKKqk3Nh

— アムロ・メイ (@Chris_novas) 2026年4月30日

映像整理してたら出てきた pic.twitter.com/stpns4Rzlz

— ْ (@jinsei1or8) 2026年4月29日

◆サイエンス(科学・学問・テクノロジー)

カニはいつ「横歩き」を獲得したのか ―約2億年前の共通祖先に由来し、多様化につながった可能性―|長崎大学

カニの「横歩き」は約2億年前に始まったか 長崎大など研究 | NHKニュース | サイエンス

◆社会・政治・経済(事件・世界のニュース・ビジネス)

長期金利上昇、一時29年ぶり2.5%超 原油高でインフレ懸念 - 日本経済新聞

【動画】「昭和100年式典を粉砕する」全学連が武道館周辺でデモ 機動隊ともみ合いに…逮捕者も - 産経ニュース

【速報】「いよいよ断固たる措置近づく」と財務相|47NEWS(よんななニュース)

マレーシア沖に違法な洋上給油所、「影の船団」によるイラン産原油の取引・貯蔵拠点(1/2) - CNN.co.jp

本件投稿について、本日付で第二東京弁護士会より福島正洋弁護士から懲戒請求が申し立てられたとの連絡がありました。… https://t.co/xwl7t9ghhh

— 弁護士浦川祐輔/Yusuke Urakawa (@yurakawa92) 2026年4月30日

高市首相がナフサ由来品「年越し供給」を表明、実像は

辺野古転覆、船運航の抗議団体「ご遺族にさらなる深い傷を負わせた」とコメント掲載 - 産経ニュース

高市首相がどんなに反論しても…石油・ナフサ危機「6月に詰む」に現実味、トヨタ系企業からも悲鳴|日刊ゲンダイDIGITAL

事故後対応および安全管理の不備に関するお詫び | ヘリ基地反対協議会

報道の自由度 世界の平均スコアは過去最低に 日本は62位 | NHKニュース | メディア、トランプ大統領、アメリカ

トランプ氏、イタリアとスペインからも米軍撤退の可能性示唆 | ロイター

トランプ氏、防弾ベスト着用に難色「太って見えるのに耐えられないかも」 写真1枚 国際ニュース:AFPBB News

トランプ氏、イタリアとスペインの駐留米軍も削減検討 対イラン軍事作戦に非協力的 写真1枚 国際ニュース:AFPBB News

高市陣営が総裁選中に進次郎氏、林氏を“大バッシング”した疑惑…「中傷動画問題」の告発者はサナエトークン騒動のキーマンだった | 集英社オンライン | ニュースを本気で噛み砕け

エフピコ、食品容器など全製品20%以上値上げ

高市首相 ナフサ由来の化学製品 年越えて供給継続できる見込み | NHKニュース | イラン情勢 日本への影響・対応、ナフサ、資源・エネルギー

抗議者制止で警備員死亡の事故現場、沖縄・玉城知事「安全対策は事業者でも検討を」 - 産経ニュース

両陛下「深い反省と平和守る努力大切」 昭和100年式典で感想 | 毎日新聞

円相場 一時1ドル=155円台まで値上がり 急激な円高 政府・日銀が市場介入か 市場に見方広がる | NHKニュース | 株価・為替、金融、日本銀行(日銀)

円急騰、海外で一時155円台 政府・日銀が介入観測―片山財務相「断固たる措置近い」:時事ドットコム

中東から日本に向かう12隻のタンカー:ホルムズ海峡の不安定化×石油輸送の多重化|渡邉英徳研究室|渡邉英徳

元検事正からの性被害訴えた女性検事が辞表提出…「訴えが無視され続け、戻る場所がなくなった」と涙 : 読売新聞

自民党大会で国歌、告発状を提出 弁護士ら「自衛隊法違反」 | NEWSjp

読む政治:「稲田の乱」で一気に関心増 怒号飛び交う自民再審論議の行方 | 毎日新聞

「石油が空から降ってくる」、ウクライナの無人機攻撃で環境災害 衛星画像に黒く染まった海(1/2) - CNN.co.jp

「日出づる国」はロシア プーチン氏、改めて主張:時事ドットコム

ウガンダ幼稚園襲撃犯に死刑判決 金持ちになるため「いけにえ」で4人殺害 写真4枚 国際ニュース:AFPBB News

海上自衛隊の1尉、覚醒剤所持容疑で逮捕…東京音楽隊で指揮者務める : 読売新聞

エフピコ、原料高で食品トレー6月から値上げ 今期業績予想は未定 | ロイター

5年以内に運賃値上げの「申請タイミングくる」 JR西日本社長:朝日新聞

若者のオーバードーズ対策 市販薬販売を厳格化 改正法施行【Q&A】 | NHKニュース | 医療・健康、家庭・子育て、厚生労働省

「国保逃れ」に重いペナルティー 過去の医療費が全額自己負担に - 日本経済新聞

「ベビーカーのためでもダメ?」区長に反論した町中華が大炎上…無言電話10件超、店主“悪者扱い”の裏で何が起きたのか(秋葉原) | 集英社オンライン | ニュースを本気で噛み砕け

トランプ氏、独駐留米軍削減を示唆 イラン軍事作戦でメルツ首相に不満 写真2枚 国際ニュース:AFPBB News

【速報】退職女性検事「地獄から解放されたかった」|47NEWS(よんななニュース)

米、ホルムズ海峡の航行再開に向け国際有志連合への参加呼びかけ 報道 写真1枚 国際ニュース:AFPBB News

【速報】高市首相はイラン大統領に、全ての国の船舶が自由で安全に航行できるよう強く求めた:時事ドットコム

アスファルト路面の穴再発防げ 中日本高速が補修材を開発 工事規制、事故減へ - 産経ニュース

【速報】「父が生前申し訳ないことを」と石原環境相|47NEWS(よんななニュース)

過去30年で日本の格差は危険なレベルにまで拡大した | ニューズウィーク日本版 オフィシャルサイト

「日章丸」の画像、在日イラン大使館がXに投稿…「遺産が意義を持ち続けている」 : 読売新聞

町長が2月から意識不明、議会が不信任案を提出へ…「本人の名誉のために不信任という言葉を使わない議案名を考えている」 : 読売新聞

◆ライフスタイル(人生・生活・健康)

社会を維持するためには下層に人生は良いものだと錯覚させて子供を産ませる必要があるのに上層があまりに搾取しすぎているせいで上層すら共倒れになっていく - Togetter

職場でいつも陰口を言われている人がいるけど、飲み会の後に「幹事をしてくれてありがとう」と言ってきてくれたのは唯一その一人だけで...本当にやるせない... - Togetter

昭和元年生まれのおばあちゃんは溜め込み癖があって”モノのない時代”を体験した反動だと思っていたけど今なら分かる...ばあちゃん、死ぬまで国を信用できなかったんだな... - Togetter

これは100%、ソニーが悪い。

— 本田雅一 (@rokuzouhonda) 2026年4月30日

景表法違反で行政処分が下っても文句は言えないのでは。業界内で決めた8年規約にも違反している上、法規制が厳しい米国では部品が購入でき、甘い日本では切り捨てとなると言い訳できない。…

京都市街を東西に、北陸新幹線に匹敵する深さ40mで掘り抜く大規模シールドトンネル工事、ついに完成。

— 彩葉 (@iloha_train) 2026年4月30日

誰も水脈が断ち切られるとか井戸が枯れるとか叫ばないまま、京都新聞も「ナゾの工事」で押し通した。

北陸新幹線も「ナゾの工事」で済ませれば文句言われないんでね? https://t.co/hp7tbXxwPW

夜逃げされた物件を見に行ったら、なぜか引戸が開かない部屋があり、室内から入れないので窓から入ったら内側がこうなっていた「何に使ってたんだろうな」 - Togetter

あ…ありのまま今起こったことを話すぜ

— ふかぽん a.k.a ボロ戸建てKING👑 (@king_fukapon) 2026年4月30日

夜逃げされた物件を久しぶりに見に行ったんだ

そしたら何故か引戸が開かない部屋があった…

室内から入れないのでナゾに開いている外の窓から入ってみたら内側がこうなってた…

な…何を言ってるかわからねーと思うが、俺も何をされたのかわからなかった pic.twitter.com/YudfEYae4y

98歳の施設利用者がペースト食も困難になったことを息子さんに伝えると「お前らがヘタクソやからや!」と怒りだし、八つ橋を食べさせて詰まらせる→その後の展開がさらに怖い - Togetter

女性へ 付き合ってるのにGWに会えない男は既婚者か茶農家です→米農家「我々も入れてください!」繁忙期に突入している職業の人々が存在をアピール - Togetter

「カレーの味がしない」世界屈指の金融機関に勤める女性、部下に薬を飲ませセクハラ、更に人種差別的な発言を放つ→調査の結果、驚きの事実が判明 - Togetter

「6Lのジョウロに除草剤入れて何回か撒いた そしたら今、すき家でシャキうま塩野菜牛丼をうまく口に運べない」→どうした、大丈夫か? - Togetter

リフォームで浴室の工事が終わった後、何を思ったか施工店の従業員が真っ先にシャワーを浴び始め、やってきた施主と遭遇するという地獄のような案件を聞いたことがある - Togetter

桂浜水族館の視点変換スキルはすごい pic.twitter.com/4YarVtIHr8

— ゆきつばき@現実創造コンシェルジュ (@ppfallgmlcom) 2026年4月30日

東京行きのバスで爆睡していたら、起きたときには車内は真っ暗で誰もおらず、バスは車庫に向かっていた→その後、人数確認があったにもかかわらず気づかれなかったことが判明 - Togetter

面接で希望の時給額を聞かれ「これまでが時給1850円だったので同額を希望します」と言ったら「1800円で、と言ったらお断りしますか?」と言われたので速攻辞退した - Togetter

バンクシーの新作像出現 ナショナリズム風刺か―ロンドン:時事ドットコム

お茶屋さんがお茶の写真と一緒に「この濁りのない水色を見て欲しい」と投稿したら「どう見ても水色には見えないけど...?」という反応が集まる→実は業界用語だった - Togetter

母が亡くなったとき、自分は火葬のつもりでいたが、父が「うちは代々土葬や。絶対に火葬するな」といいだしたので、あわてて父の親戚に電話で説得を頼み、ことなきを得た話 - Togetter

独身子無し中年女性だが「子供いなくて自由満喫。お金も時間も自由にやり放題」とは思ってないし「寂しい!不幸!」とも思ってない…ただ可もなく不可もない - Togetter

日本刀の世界では、こうした最新の技術を用いた作刀ができない。

— 町井勲@日本が日本らしくあって欲しい (@IsaoMachii) 2026年4月30日

どの時代の刀工も、進化を求めて躍進した。

その結果、様々な刃文が生まれたわけですが、今の法律では江戸後期の作刀法を基準とし、それ以外の鍛造法を認めない。… https://t.co/308rKdwPYO

ガイアの夜明けのLUUP回見てると胸糞悪いな

— うざき🐰 (@uzakidesu) 2026年4月27日

「交通安全と採算性のバランスを取らないといけない」とか意味不明なことを堂々と言ってたけど、お前らの金儲けのためになんで関係の無い人たちが危険に晒されないといけないの?

意訳で誤解が生まれてはいけないので、以下当該シーンのテロップ原文ママ

— うざき🐰 (@uzakidesu) 2026年4月28日

「交通安全領域はビジネスの総合格闘技感がある

マーケティングの考え方もあれば、データ分析、どういう事故が起きていてだからこうすべきというのもある

事業との採算も合わせていく経営思考も必要」

そりゃあこれだもん https://t.co/c7VOsXvtEu pic.twitter.com/qlZ8Gl0D62

— スマホしょっちゅうかえてた者🍥 (@xyz9071) 2026年5月1日

◆IT・ガジェット(ネット・ソフト・ハード・モバイル)

xAIに入社した - lapla.dev

市立小学校教員によるSNSへの画像投稿について|仙台市

Mini Shai-Hulud の概要と対応指針(2026年4月末 連続パッケージ侵害) - GMO Flatt Security Blog

ローカル開発環境のS3互換ストレージとしてRustFSを使う

Photoshopの生成AIの新機能「オブジェクトを回転」について。試しもせずに称賛も批判もできないと思い、自分の絵で使ってみました。結果としてはこんな感じでしたが、他の方たちがあまり違和感なく生成している例も多く見ています。… pic.twitter.com/pTbC5bQ8Tf

— サタケシュンスケ|イラストレーター (@satakeshunsuke) 2026年4月30日

「これが理想の使い方」 話題になっている「BeReal.」だが、一人旅ユーザーの使っていた際の画像を見ると、めちゃくちゃ魅力を感じる - Togetter

BeReal.は若者よりむしろ定期的な生存確認の必要がある隠居老人がやるべきアプリなのでは?という投稿に→「その手があったか」「老人に2分の時間制限はハードル高い」 - Togetter

コーディングをAIに任せても、エンジニアの仕事は減らなかった ― ほぼ一人で1か月、AI機能をリリースしてみて - Findy Tech Blog

西日本シティ銀行のBeReal騒動、バイトテロと違って今は無自覚にやらかしていそう「上司たちのキャリアが終わるかもしれないと思うと涙が止まらない」 - Togetter

自作MCPサーバーのトークン消費を9割削減するTips ── MCPの退避パターン

RubyKaigi 2025でキーノートとして話しました - Eggshell

ゼロからのOS自作入門を563日で完走した感想 - sasurau4のブログ

terraform applyをGHAで実行してはいけない理由

高価なPCを買わずにオープンウェイトなLLMを試す|hiza

【Claude Code】CLAUDE.md・skills・agents を整備して開発体験が劇的に変わった話

エディター「with」を作り始めました – Taiyo Fujii, writing

「本書の意義が、陰にも陽にも、読者諸氏に吟味されることを望む」『超知能AIをつくれば人類は絶滅する』書評:江永泉|Hayakawa Books & Magazines(β)

◆アニメ・ゲーム・マンガ(サブカル)

【マチ★アソビMAP解禁第一弾】

— マチ★アソビ (@machiasobi) 2026年5月1日

マチ★アソビvol.30における

・ポッポ街

・東新町商店街

の「空き店舗出店MAP」が公開です!!

「アミコビル」のMAP解禁は明日18時!!

今回のマチ★アソビは空き店舗出店数も史上最大規模でのお届けいたします!!

魅力的な出店が目白押しのマチ★アソビvol.30を、… pic.twitter.com/WbOwWbbNSL

「ほぼすべての野球マンガ」の年譜を作成したと謳っていたアレについて|ちゆ12歳

2025年度における誹謗中傷等の権利侵害行為に対する対応報告 | カバー株式会社

『カルドセプト ビギンズ』開発者インタビュー。大宮ソフト誕生から『カルドセプト』の軌跡、空白の10年と世界を目指す最新作にかける想い | Game*Spark - 国内・海外ゲーム情報サイト

ディズニー同人誌の印刷を印刷所に断られました|まるとも

【獣道】ウメハラ選手、「負けたら競技引退」を決めていた。しかし「最後の1週間の熱量」を胸に現役続行を表明 - GAME Watch

2026年4月30日 ウメハラ獣道 後日談配信

— 格ゲーマークリップス (@FGAMER_clips) 2026年4月30日

スト6で初めて「自分が強いな」と思えて嬉しかった話/負けたら現役を辞めようと思っていた話/涙がボタッと落ちた話/タクシーでえいたのデスボイスがうるさかった話/若い頃の「負ける訳にはいかない」という必死な気持ちがまた戻ってきた話 pic.twitter.com/KF7PyJTnsJ

台湾で出たパチモノ桃太郎電鉄?!【台湾大亨/メガドライブ】【レトロゲームゆっくり実況解説】 - ニコニコ動画

怪我しない分だけサポートするP pic.twitter.com/3tr2sFTKPo

— しんごー@現在 (@bycilefighter) 2026年4月30日

焦りすぎて逆に告白してしまう、東北きりたん【ソフトウェアトーク劇場】 - ニコニコ動画

【公式】『呪術廻戦≡』最終3巻発売記念 スペシャルPV【制作:MAPPA】 - YouTube

アイカツ!アンコール予告プロモーションビデオ - YouTube

00110101 11100110 10011100 10001000 00110010 11100110 10010111 10100101 00101000 11100101 10011100 10011111 00101001 11100101 10001101 10001000 11100101 10111110 10001100 00111000 11100110 10011001 10000010 11100011 10000001 10101011 11100011 10000011 10000111 11100011 10000010…

— デジモンアニメシリーズ【公式】 (@Digimon_Anime) 2026年4月30日

暗証番号 pic.twitter.com/xvk3mQbDHK

— ペプチド🙃🙃 (@peputido) 2026年4月30日

【速報】「世界最強の魔女、始めました」TVアニメ化決定!特報映像公開 - YouTube

TVアニメ『対ありでした。~お嬢さまは格闘ゲームなんてしない~』ティザーPV第2弾 - YouTube

TV アニメ『盗掘王』剛力遼河キャラクター PV【2026年7月よりフジテレビ、関西テレビほかにて放送開始!】 - YouTube

『DEAD OR ALIVE 6 Last Round』×『THE KING OF FIGHTERS XIV』コラボレーショントレーラー - YouTube

『ディアブロ IV』: 憎悪の帝王 | オープニングムービー - YouTube

『エーペックスレジェンズ』: オーバークロック アンセムトレーラー - YouTube

『フォーミュラレジェンズ』:フォーミュラE - エレクトリックエボリューション DLC ローンチトレーラー - YouTube

『アドラブル・アドベンチャー』- 発売トレーラー - YouTube

上手なアニメーターに「円は机のパースには合わない、縦パースの直角が最大幅」と教わったので皿の上に爪楊枝を置いて確かめた、カメラのレンズも考慮する必要がある - Togetter

ウメハラ選手が“現役続行”に前向きな姿勢を表明。MenaRD選手との獣道を、配信で振り返る

【記事全文】宇野昌磨さん eスポーツチーム電撃加入! スケートと“二刀流”へ「ちゃんとしたゲーマーとして活動」 - スポニチ Sponichi Annex スポーツ

メディア芸術ナショナルセンター(仮称)初の収蔵予定資料としてマンガ家ちばてつや氏のマンガ原画等資料を受け入れました | 文化庁

あれ!?

— ロクバ (@rokubanana) 2026年4月30日

初手から殺す気でなくて?

普通、これだけのいい女

なぶってから殺す、拷問ののち殺す、

段階と言うものがあると

お父様から聞き及んでおりましたのに… pic.twitter.com/EVB9rrsX0e

今話題の、編集者に「絵柄が古いから今風の細い線に」と言われた話。

— こげどんぼ*🦹🥋💜Vtuberざべてさま (@koge_dobo) 2026年4月30日

これは「絵を変えろ」ではなく、「今のままだと戦いづらいから、新規にも届く形に持ち味をアップデートしてみて」という意味だと思う。

昔、編集者の仕事で作家担当をしていたので、編集側の気持ちも分からなくはない。… pic.twitter.com/HgGYp2e5Fl

#今月描いた絵を晒そう

— プードッグ (@harenchinschool) 2026年4月30日

今月は黒ギャルしか描いてない

でも初期黒ギャルはセンシティブ喰らいそうなので黒子貼ります pic.twitter.com/860ulKD9YK

かなり前のことだけど、押井守ファンの自分は押井監督がアニメになったところをただ見たくて、途中まで描いて動かしていたことがあった pic.twitter.com/Ik0Yb6fy0y

— 門脇康平 KOHEI KADOWAKI (@KadowakiKouhei) 2026年4月29日

福本伸行✖ちいかわwithウシジマ pic.twitter.com/Trea5DA3kK

— こつぶ (@MikanCiao) 2026年4月29日

◆スポーツ・芸能・音楽・映画(エンタメ)

バット直撃の審判員、一般病棟に移るもいまだ意識戻らず NPBが容体報告 - 産経ニュース

テニス 錦織圭が現役引退を発表 日本男子最高の世界4位を記録 SNS投稿全文 松岡修造さん 大坂なおみの談話 | NHKニュース | テニス、島根県、オリンピック・パラリンピック

おい!俺の相方を舐めるなよ!

— レインボー ジャンボたかお (@kando_jjj) 2026年5月1日

確かに集客力無くて、

確かにお笑いファンから人気無くて、

確かに最近差し入れの数、カゲヤマ益田さんに負けてるけど、

お金を一切使わない、ライブにも一切来ない無課金女子には強いらしいぞ!!!!

学祭での人気凄いんだぞ!!! https://t.co/WnfrS1mMfg

◆新商品(衣・食・住)

【松のや】松のや創業25周年記念第2弾「国産雪国育ちロースかつ」発売|松屋フーズ

・1つ前のヘッドライン

2026年4月30日のヘッドラインニュース - GIGAZINE

・関連コンテンツ

in ヘッドライン, Posted by logc_nt

You can read the machine translated English article Headline news for May 1, 2026….