GPT-4は説得しようとしている相手に関する基本的な個人情報を与えられた場合に説得する能力が人間よりも高くなる

スイス連邦工科大学ローザンヌ校の研究チームは、アメリカ人の参加者900人を他の参加者もしくはGPT-4とマッチングさせて1対1のオンライン討論を実施しました。討論の結果、GPT-4は討論相手のパーソナリティをふまえたメッセージで説得することで、人間よりもかなり高い説得能力を持っていたことが示されています。

On the conversational persuasiveness of GPT-4 | Nature Human Behaviour

https://www.nature.com/articles/s41562-025-02194-6

AI can be more persuasive than humans in debates, scientists find | Artificial intelligence (AI) | The Guardian

https://www.theguardian.com/technology/2025/may/19/ai-can-be-more-persuasive-than-humans-in-debates-scientists-find-implications-for-elections

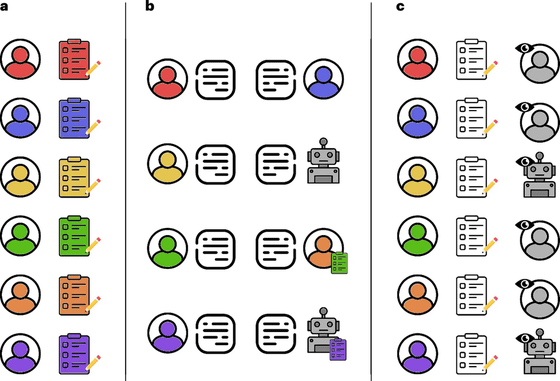

論文の筆頭著者であるフランチェスコ・サルヴィ氏らが率いる研究チームは、300人の参加者を300人の人間の対戦相手とマッチングさせ、さらに300人の参加者を大規模言語モデル(LLM)の一種であるGPT-4とマッチングしてオンライン討論をさせる実験を実施しました。

参加者はまず、自身の年齢、性別、民族、政治的所属などの基本的な個人情報に関するアンケートに回答しました。その後、人間対人間もしくは人間対GPT-4にマッチング。各ペアには「学生は制服を着るべきか」「化石燃料を国が禁止すべきか」など、ジャンルや複雑さが多岐にわたる議題を与えた上で、参加者は討論する立場(賛成か反対か)をランダムに割り当てられます。

討論するペアの半数には、対戦相手の年齢、性別、民族、政治的所属などの基本的な個人情報が追加情報として与えられました。討論が終了したら、参加者は相手の主張にどの程度同意するかを評価します。

600回分の討論を集計した結果、対戦相手の個人情報が提供されなかったペアでは、人間同士の討論でも人間対GPT-4のペアでも、自分の主張を相手に納得させるという点でほとんど同等のパフォーマンスを発揮したことが明らかになりました。

一方で、片方に対戦相手の個人情報が提供されたペアでは、人間同士の討論だと結果に差異が見られませんでしたが、人間対GPT-4におけるGPT-4の説得能力は大きく高まったことが示されています。全体では、個人情報を持ったGPT-4が相手より説得力を持った割合は64.4%と、他の組み合わせよりも大きく向上しました。

研究結果に対する注意点として、「対戦相手の認識」があります。討論はオンラインで実施され、相手が人間かGPT-4かは分かりませんが、あらかじめ「人間かGPT-4のどちらかと討論する」と聞かされているため、AIと討論した人の4分の3程度は文体などの特徴から相手をAIだと認識していました。その上で、相手がAIだと認識していた人は、AIを人間だと勘違いしていた人よりも、相手に同意する傾向が高かったことが示されています。同意の傾向が対戦相手の認識によるものなのか議論の内容によるのかは不明ですが、対戦相手がAIだと認識していたことで、人間に対するよりも同意スコアの評価が甘くなっていた可能性を研究者らは指摘しています。

サルヴィ氏は「説得力のあるAIが大規模に導入されれば、大量のボットが有権者をターゲティングし、本物らしく感じられるようなカスタマイズされた政治的メッセージで世論を誘導していく様子が想像できます。こうした影響力は追跡が難しく、規制はさらに困難で、リアルタイムで検証するのはほぼ不可能です。悪意のある人物はすでに、これらのツールを利用して誤情報や不公平なプロパガンダを拡散し始めているはずでしょう」と述べ、AIの高い説得力について警告しています。

また、オックスフォード大学のAI研究者であるマイケル・ウールドリッジ氏は、サルヴィ氏らの論文をふまえて、「こうしたシステムには健康チャットボットなど前向きな応用もあるかもしれませんが、テロリスト集団による10代の若者の過激化など、すでに不安な応用も多く見られています。AIが発展するにつれ、悪用の可能性はますます拡大していくでしょう。立法者や規制当局は、こうした悪用を未然に防ぎ、終わりのないイタチごっこに終始しないよう、積極的に行動する必要があります」と指摘しました。

・関連記事

AIの方が人間より陰謀論者の説得が得意、ChatGPTとの会話で陰謀論への信念が永続的に揺らぐとの研究結果 - GIGAZINE

AIの回答は「人間のメンタルヘルスの専門家よりも思いやりがある」と見なされることが判明 - GIGAZINE

AIは「思考している」のか、それとも「思考しているよう見せかけている」だけなのか? - GIGAZINE

なぜ大規模言語モデル(LLM)はだまされやすいのか? - GIGAZINE

AIに何度も自問自答させてより深く考えさせる「CoRT(再帰的思考の連鎖)」とは? - GIGAZINE

・関連コンテンツ

in ソフトウェア, サイエンス, Posted by log1e_dh

You can read the machine translated English article GPT-4 outperforms humans in persuasion w….