オープンソースのコーディング支援AI「Qwen2.5-Coder」シリーズの性能はGPT-4oに匹敵、64GBのRAM&M2搭載MacBook Proでもローカル実行可能

中国・Alibabaグループが開発する大規模言語モデル(LLM)「Qwen」の研究チームが、コード生成や補完、数学の推論タスクに特化したLLM「Qwen2.5-Coder」の新モデルを2024年11月12日にリリースしました。Qwen2.5-Coderのコーディング機能はGPT-4oに匹敵し、パラメータ数も最大320億で、M2搭載MacBook Pro上でも実行できたことが報告されています。

Qwen2.5-Coder Series: Powerful, Diverse, Practical. | Qwen

https://qwenlm.github.io/blog/qwen2.5-coder-family/

Qwen2.5-Coderは2024年10月にテクニカルレポートが発表されており、この時にパラメータ数15億(1.5B)のモデルと70億(7B)のモデルがオープンソースで公開されていました。今回、パラメータ数5億(0.5B)・30億(3B)・140億(14B)・320億(32B)の4モデルが新たにオープンソース化されました。

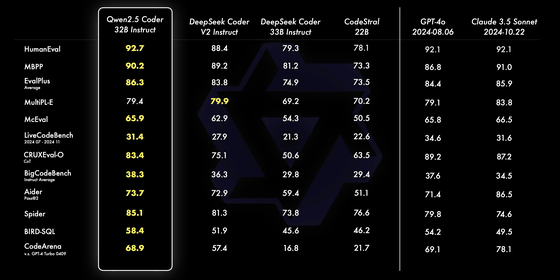

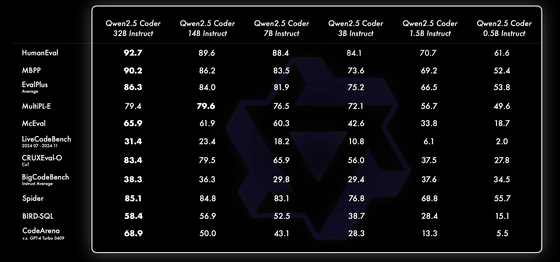

以下はQwen2.5-Coder-32B-Instructの各ベンチマークスコアを他モデルと比較した表です。Qwenの研究チームは、フラッグシップモデルであるQwen2.5-Coder-32B-Instructが、EvalPlusやLiveCodeBench、BigCodeBenchなどのコード生成ベンチマークでGPT-4oに匹敵するパフォーマンスをみせたとアピールしています。また、コード修正についても、Qwen2.5-Coder-32B-InstructはAiderベンチマークでGPT-4oと同等のパフォーマンスを発揮しています。さらに、コード実行のプロセスを学習し、モデルの入力と出力を正確に予測するコード推論でも、Qwen2.5-Coder-32B-Instructは優れたパフォーマンスを示していると研究チームはアピールしました。

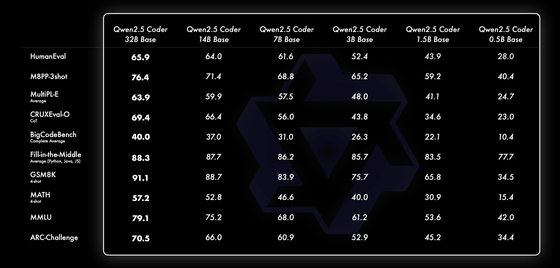

なお、Qwen2.5-Coderのベースモデルで各サイズごとのベンチマークスコアはこんな感じ。

ファインチューニング済みのQwen2.5-CoderのInstructモデルで、各サイズごとにベンチマークを行った結果が以下。

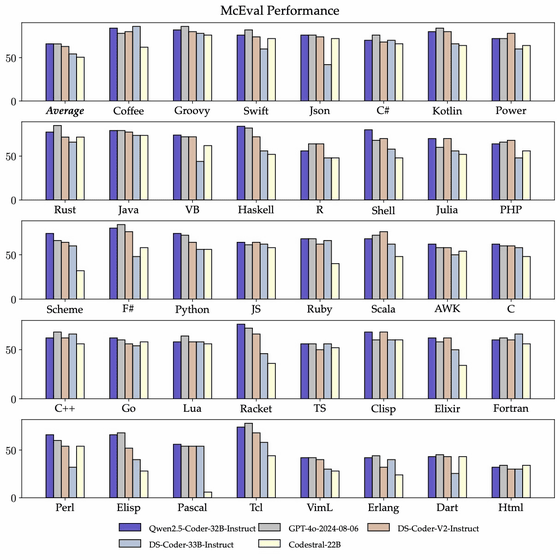

Qwen2.5-Coder-32B-Instructは40を超えるプログラミング言語で優れたパフォーマンスを発揮しており、他言語コーディングのベンチマークであるMcEvalで65.9のスコアを獲得したとのこと。

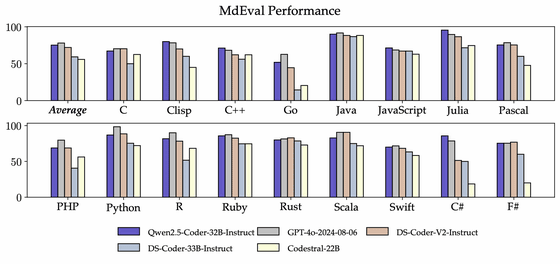

さらに、他言語コード修正ベンチマークのMdEvalでは、Qwen2.5-Coder-32B-Instructは75.2のスコアを獲得し、すべてのオープンソースモデルの中で1位だったと研究チームは報告しています。

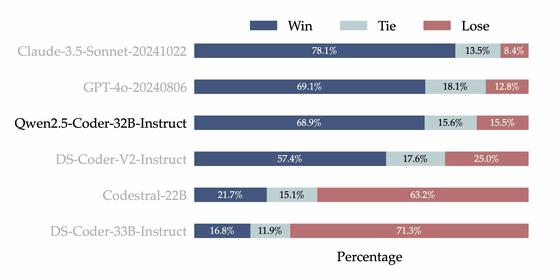

そして、研究チームはQwen2.5-Coder-32B-Instructが人間の好みとどれだけ整合しているかを評価するため、「Code Arena」と呼ばれる内部の注釈付きコード選好評価ベンチマークを構築しました。このベンチマークはArena Hardに類似したものとなっているとのこと。評価結果から、Qwen2.5-Coder-32B-Instructは人間の選好との整合性において優位性を示すことが確認されたと研究チームは述べています。

研究チームによれば、このCode Arenaの結果は、Qwen2.5-Coder-32B-Instructが人間のプログラミングに関する好みや期待に沿った出力を生成できることを意味するとのこと。つまり、実際の開発現場において、Qwen2.5-Coder-32B-Instructはより実用的で人間にとって有用な提案やコードを生成できる可能性があるというわけです。ただし、この評価があくまでもGPT-4oを基準としている点には留意が必要です。

ウェブ開発者のサイモン・ウィリソン氏はQwen2.5-Coder-32B-Instructを実際にメモリ64GBのM2搭載MacBook Proで実行して検証した結果、「Qwen2.5-Coder-32B-Instructのサイズは十分小さく、私のMacBook Pro上で他のアプリケーションを終了させることなくモデルを実行することができ、スピードと結果の質の両方で最高レベルのモデルと比較しても遜色ないように感じられます」と報告しています。

・関連記事

イギリスの大手紙・The GuardianはなぜX(旧Twitter)に記事を投稿しなくなったのか? - GIGAZINE

完全にオープンで再現可能な大規模言語モデル「OpenCoder」がリリースされる - GIGAZINE

Alibabaが新AIモデル「Qwen2-VL」をリリース、20分を超えるビデオを分析し内容についての質問に要約して回答可能 - GIGAZINE

数学を解ける言語モデル「Qwen2-Math」が登場、GPT-4o超えの数学性能 - GIGAZINE

なぜ研究者はローカルPCでAIを実行する必要があるのか? - GIGAZINE

中国アリババがチャットAI「Qwen-72B」とローカルで音声入力に対応する「Qwen-Audio」をオープンソースで公開 - GIGAZINE

・関連コンテンツ

in AI, ソフトウェア, Posted by log1i_yk

You can read the machine translated English article The performance of the open source codin….