OpenAIが「政府による大規模監視へのAI活用」に同意したとの指摘を受けサム・アルトマンCEOが契約の見直しを発表

by TechCrunch

OpenAIはアメリカ国防総省(戦争省)と契約して自社AIの軍事利用に同意しましたが、国民の大規模監視や自律型兵器の開発は認めていません。一方、OpenAIの前に契約していたAnthropicはこの2つを明確に禁止したために国防総省から契約を切られ国家安全保障上のリスクであるとの烙印を押されています。なぜ同じ内容なのにOpenAIだけが許されたのか、それはOpenAIの契約に解釈の余地があるのが理由だと考えられています。

How OpenAI caved to the Pentagon on AI surveillance | The Verge

https://www.theverge.com/ai-artificial-intelligence/887309/openai-anthropic-dod-military-pentagon-contract-sam-altman-hegseth

OpenAI says its US defense deal is safer than Anthropic’s, but is it? | CIO

https://www.cio.com/article/4139511/openai-says-its-us-defense-deal-is-safer-than-anthropics-but-is-it.html

Anthropicは政府機関向けに自社AI「Claude」のカスタムモデルを提供する一方で、「国民の大規模監視」および「完全自律型兵器の開発」は明確に禁止していました。国防総省は規制の緩和を打診しましたが、Anthropicが拒否したため、国防総省は関係解消か制限撤廃の二択を迫ることになります。結果的にAnthropicが固持したことで国防総省は関係解消の道を選び、おまけにAnthropicを国内企業には適用したことがない「サプライチェーンリスク」に指定して政府機関での使用を制限する報復措置を執りました。

トランプ大統領が「Anthropicの左翼狂信者がアメリカ軍の制御を試みた」と主張し関係断絶を指示、ヘグセス国防長官はAnthropicを「サプライチェーンリスク」に指定へ - GIGAZINE

その直後、OpenAIが国防総省とAI利用計画に合意したことを明らかにしました。ところが、OpenAIにはAnthropicのような規制はないのかと思いきや、「アメリカ国内の大衆に対する監視にAI技術を一切利用させないこと」「致命的な武力行使を伴う自律型兵器システムの直接的な制御を行わないこと」「社会信用システムのような個人の権利を大きく左右する高度な自動意思決定に利用しないこと」というAnthropicとほとんど同じ制限事項があることが判明。一体なぜOpenAIがこの内容で契約できたのかについて疑問の声が上がりました。

OpenAIは「我々の合意はAnthropicを含む他のあらゆる企業より多くのガードレールを備えている」と主張していますが、契約書の全文が公開されているわけではないため、Anthropicにはない解釈の余地があるのではないかと推測されています。

AIはパターン認識に優れていて、例えばある個人について、位置情報、ウェブの閲覧履歴、金融データ、監視カメラ映像、有権者登録情報など、個々には無害に見えるデータを統合することで正確な人物像を作り上げることが可能です。Anthropicはこの行為を明確に禁止する契約を求めたとしていますが、OpenAIはこの点について「情報活動において、個人情報の取り扱いは合衆国憲法修正第4条、1947年国家安全保障法、1978年外国情報監視法、大統領令12333、ならびに明確な外国情報目的を求める国防総省の関連指令に準拠する」と明記しているといいます。

テクノロジー系メディアのThe Vergeは、「こうした法律には解釈の余地があり、9.11以降、情報機関が監視体制を強化して国内のスパイ活動を対象に複数の大規模監視プログラムを実施した過去がある。例えば、国家安全保障局の契約職員だったエドワード・スノーデン氏が暴露したPRISMのような国際監視網だ」と指摘。「政府は『技術的に合法であるならば大規模監視を実行できる』とする法律の『技術的に合法』の定義を拡大解釈し、広範な大規模監視プログラムを正当化してきた」と付け加え、OpenAIが主張する契約内容であれば国防総省が監視を正当化する可能性があると伝えました。

こうした騒動のさなか、OpenAIのサム・アルトマンCEOはXで公開質問を受け付け、複数の指摘を元に契約内容を修正することを約束しました。アルトマン氏が公開した声明の全訳は以下の通りです。

私たちは原則を非常に明確にするため、DoW(戦争省)との契約にいくつかの追加を行うべく取り組んできました。

1. 私たちは、既存の内容に加えて、以下の文言を契約に追加するよう修正します。

「アメリカ合衆国憲法修正第4条、1947年国家安全保障法、1978年FISA法を含む適用法令に従い、本AIシステムは、米国市民および国民に対する国内監視を意図的に行うために使用されてはならない。疑義を避けるために明確にすると、国防総省は、この制限が、商業的に取得された個人情報または識別可能な情報の調達や使用を含め、米国市民または国民に対する意図的な追跡、監視、モニタリングを禁止するものであると理解している」

アメリカ国民の市民的自由を守ることは極めて重要です。この点に大きな関心が寄せられていたため、商業的に取得された情報に関しても、この点を特に明確にしたいと考えました。私たちが反復的な展開で行っているすべての取り組みと同様に、今後も学びながら改善を続けていきます。

これは重要な変更だと思います。私たちのチームとDoWのチームは、この点について非常に良い仕事をしました。

2. また同省は、私たちのサービスが国防総省の情報機関(例えば国家安全保障局)によって使用されないことを確認しました。これらの機関へのサービス提供には、契約の追加修正が必要となります。

3. 極めて明確に申し上げますと、私たちは民主的なプロセスを通じて取り組みたいと考えています。社会に関する重要な決定は政府が行うべきです。私たちは専門知識を共有し、自由の原則を守るために発言し、議論の場に席を持ちたいと考えています。しかし、制度がどのように機能するかについては明確に理解しています(多くの人から質問を受けましたが、もし自分が違憲だと信じる命令を受けた場合、従うよりも刑務所に行くことを選びます)。しかし、

4. この技術には、まだ対応できないことが多くあり、安全性のために必要なトレードオフについても、まだ十分に理解できていない領域が数多くあります。私たちは、技術的な安全措置やその他の方法を用いながら、DoWと共に慎重に取り組んでいきます。

5. 私が誤ったと思う点が一つあります。金曜日に急いでこれを発表すべきではありませんでした。問題は非常に複雑であり、明確なコミュニケーションが求められます。私たちは本当に事態の悪化を防ぎ、より悪い結果を回避しようとしていましたが、結果的に日和見的で雑な対応に見えてしまったと思います。今後、より重大な意思決定に直面するにあたり、私にとって良い学びの経験となりました。

週末の会話の中で、私はAnthropicがサプライチェーンリスクに指定されるべきではないこと、そしてDoWが私たちと合意したのと同様の条件を同社にも提示することを望んでいると改めて伝えました。

明日の朝、さらなる質問に答えるために全社会議を開催します。

Here is re-post of an internal post:

— Sam Altman (@sama) March 3, 2026

We have been working with the DoW to make some additions in our agreement to make our principles very clear.

1. We are going to amend our deal to add this language, in addition to everything else:

"• Consistent with applicable laws,…

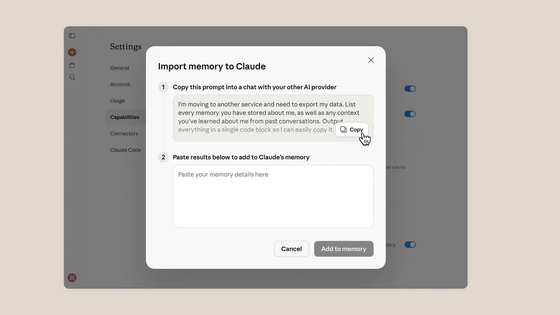

なお、Anthropicが自社のポリシーを貫いたことがユーザーに支持されたのか、ClaudeがApp Storeのランキングで1位に浮上し、反対にOpenAIの「ChatGPT」を巡りキャンセル運動が勃発しています。これを機にAnthropicはAI乗り換えキャンペーンを始め、有料機能を無料開放してデータ移行ツールを公開しました。

AnthropicがAI乗り換えユーザー獲得のためClaudeのメモリ機能を無料ユーザーにも開放&メモリのインポート機能を追加 - GIGAZINE

・関連記事

Anthropicとアメリカ国防総省の交渉決裂の内幕、最後まで国防総省はAnthropicのAIを用いてアメリカ市民に関する大量データを分析したいと考えていた - GIGAZINE

OpenAIがアメリカ軍と契約を結んだ後「ChatGPTをキャンセルせよ」という動きがインターネット上で注目を集める - GIGAZINE

アメリカ軍がイランへの先制攻撃にAI「Claude」を使用したとの報道、開発元のAnthropicとの関係断絶宣言の直後に - GIGAZINE

トランプ大統領が「Anthropicの左翼狂信者がアメリカ軍の制御を試みた」と主張し関係断絶を指示、ヘグセス国防長官はAnthropicを「サプライチェーンリスク」に指定へ - GIGAZINE

・関連コンテンツ

You can read the machine translated English article CEO Sam Altman announces contract review….