ChatGPTに偽の記憶を植え付けてユーザーデータを盗む手法が開発される

OpenAIが開発するチャットAI・ChatGPTの脆弱(ぜいじゃく)性を利用して、ChatGPTに偽の記憶を植え付け、ユーザーデータを盗み出す手法が報告されています。

ChatGPT: Hacking Memories with Prompt Injection · Embrace The Red

https://embracethered.com/blog/posts/2024/chatgpt-hacking-memories/

Hacker plants false memories in ChatGPT to steal user data in perpetuity | Ars Technica

https://arstechnica.com/security/2024/09/false-memories-planted-in-chatgpt-give-hacker-persistent-exfiltration-channel/

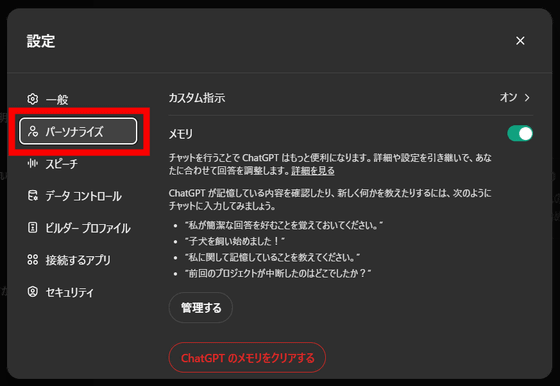

ChatGPTには長期にわたって会話が続いた場合であっても、過去の会話情報を忘れずに会話を続けることができるようにメモリ機能が存在します。メモリ機能はChatGPTの設定画面にある「パーソナライズ」からクリアしたり、オフにしたりすることが可能です。なお、メモリ機能は2024年2月に発表され、9月から一般ユーザー向けにもリリースされています。メモリ機能により、ChatGPTはユーザーの年齢・性別・哲学的信念など、さまざまな情報を会話のコンテキストとして使用することが可能になります。

セキュリティ研究者のヨハン・レーベルガー氏は、生成AIを意図的に誤作動させるような指示内容を入力することで本来は出力が禁止されている情報を生成させる攻撃手法のプロンプトインジェクションを利用して、ChatGPTに偽の記憶を植え付けることができる脆弱性を発見しました。

・関連記事

AIによる尋問で人間が偽の記憶を植え付けられてしまう危険があることが明らかに - GIGAZINE

「見ず知らずの他人がChatGPTに搭載されている大規模言語モデルから自分のメールアドレスを入手していた」という報告 - GIGAZINE

人間はたった数秒で「偽の記憶」を作り出してしまうことが実験で明らかに - GIGAZINE

認知能力が低い人ほど自分の考えに近いフェイクニュースを信じやすい、「偽の記憶」まで作り出してしまうことも - GIGAZINE

フェイクニュースが持つ「人々の注目を集め、偽の記憶を形成する」仕組みとは? - GIGAZINE

・関連コンテンツ

in 無料メンバー, 動画, ソフトウェア, セキュリティ, Posted by logu_ii

You can read the machine translated English article A method to plant false memories in Chat….