AI製品のセキュリティ向上を目指しGoogle・Microsoft・NVIDIA・Intelなどが「Coalition for Secure AI(CoSAI)」を設立

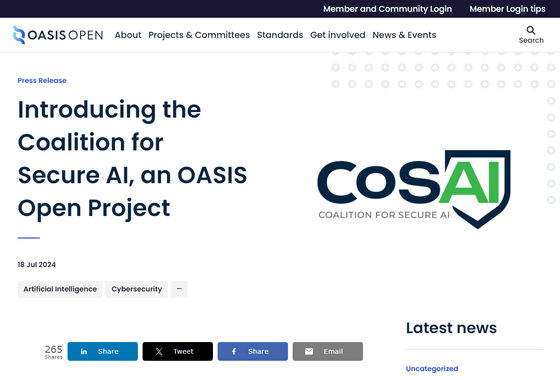

現地時間の2024年7月18日(木)、アメリカ・コロラド州のアスペンで開催された第15回Aspen Security Forumの中で、セキュリティを重視したAI開発のためのガイダンスとツールを提供することを目的としたオープンソースイニシアチブの「Coalition for Secure AI(CoSAI)」が発表されました。主催はコンピューターおよび通信関連の標準化団体であるOASIS Openです。

Introducing the Coalition for Secure AI, an OASIS Open Project - OASIS Open

https://www.oasis-open.org/2024/07/18/introducing-cosai/

Google announces the Coalition for Secure AI

https://blog.google/technology/safety-security/google-coalition-for-secure-ai/

Intel Welcomes the Coalition for Secure AI

https://www.intel.com/content/www/us/en/newsroom/opinion/intel-welcomes-coalition-for-secure-ai.html

Introducing the Coalition for Secure AI (CoSAI) - Cisco Blogs

https://blogs.cisco.com/security/introducing-the-coalition-for-secure-ai-cosai

Chainguard joins Coalition for Secure AI with OpenAI, Google, Anthropic

https://www.chainguard.dev/unchained/chainguard-joins-coalition-for-secure-ai

CoSAIは、オープンソースの方法論や標準化されたフレームワークおよびツールを共有するための共同エコシステムを促進するために設立されました。CoSAIは業界リーダー、学者、その他の専門家を含む多様な関係者を集め、AIセキュリティの断片化された状況に対処します。

CoSAIの創設プレミアムスポンサーにはGoogle、IBM、Intel、Microsoft、NVIDIA、PayPalが含まれます。その他の創設スポンサーは、Amazon、Anthropic、Cisco、Chainguard、Cohere、GenLab、OpenAI、Wizなどです。

CoSAIの主催であるOASIS Openは、「CoSAIはAIの使用と展開における信頼性およびセキュリティを強化するための取り組みです」と説明しました。CoSAIの活動範囲には、AIシステムの安全な構築、統合、展開、運用が含まれ、モデルの盗難、データ汚染、プロンプトインジェクション、スケールされた不正使用、推論攻撃などのリスクの軽減に重点を置いています。

OASIS OpenはCoSAIの目的として「AIシステムの従来型および固有のリスクに対処する包括的なセキュリティ対策を開発すること」を挙げています。また、OASIS OpenはCoSAIについて「全体的な技術アジェンダを推進および管理するプロジェクト管理委員会と、その作業ストリームを監督する学界および業界のAI専門家で構成される技術運営委員会によって主導されるオープンソースコミュニティ」と説明しました。

CoSAIの必要性について、OASIS Openは「AIは急速に世界を変えつつあり、複雑な問題を解決する大きな可能性を秘めています。AIへの信頼を確保し、責任ある開発を推進するには、セキュリティを最優先に考え、AIシステムの潜在的な脆弱性(ぜいじゃくせい)を特定・軽減し、設計段階からセキュリティが確保されたシステムの構築につながる方法論を開発して共有することが重要です」と説明しています。

既存のAI業界では、AIとAIアプリケーションおよびサービスのセキュリティ保護が断片化されているとOASIS Openは指摘。実際、開発者からは「一貫性がなくサイロ化している」という声も上がっています。AI業界には明確なベストプラクティスおよび標準化されたアプローチがないため、AI特有の一般的なリスクを評価・軽減することは、経験豊富な組織にとっても大きな課題となっているとのこと。CoSAIはこういった課題を解決するべく設立された組織というわけです。

CoSAIの理事会で共同議長を務めるGoogleのダビド・ラビアンカ氏は、「CoSAIの設立は、AIの安全な統合と展開に不可欠な知識と進歩を民主化する必要性により設立されました。OASIS Openの支援により、主要企業、専門家、学界の間でこの取り組みとコラボレーションを継続できることを楽しみにしています」とコメントしました。

同じく共同議長を務めるシスコのオマール・サントス氏は、「責任ある安全なAIテクノロジーの最前線に立つ組織との連携に注力しています。我々の目標は、重要なトピックに重点を置く主要なパートナーシップを通じ、冗長性を排除し、集合的な影響を拡大することです。CoSAIでは、当社の専門知識とリソースを組み合わせて、業界全体に利益をもたらす堅牢なAIセキュリティ標準と実践の開発を迅速に進めていきます」と語っています。

CoSAIは以下の3つのワークストリームを形成し、時間の経過と共にさらなるワークストリームを追加していく予定と説明しています。

・AIシステムのソフトウェアサプライチェーンセキュリティ

構成と出所の追跡を強化してAIアプリケーションを保護。

・変化するサイバーセキュリティ環境に対する防御側の準備

AIと従来のシステムにおける投資および統合における課題への対処。

・AIセキュリティガバナンス

AIセキュリティのベストプラクティスとリスク評価フレームワークの開発。

・関連記事

「人類に壊滅的なリスクをもたらすAI」を安全に提供するためにAnthropicが既存ポリシーの反省点を公開 - GIGAZINE

AIシステム開発で起こりがちな重大トラブルとそれを対策する方法とは? - GIGAZINE

OpenAIがAIの安全性のために取り組んでいる10の実践例を公開 - GIGAZINE

GoogleがチャットAIのGeminiでマルウェアを分析し脅威レポートを要約するサイバーセキュリティツール「Google Threat Intelligence」を発表 - GIGAZINE

AIモデルの実行を通してウイルスに感染する可能性をセキュリティ企業が警告 - GIGAZINE

ChatGPTやGeminiといったチャットAIのセキュリティ機能を破壊するマルウェア「Morris II」が登場 - GIGAZINE

OpenAIのGPT-4はCVEのセキュリティ勧告を読むことで実際の脆弱性を悪用できることが明らかに - GIGAZINE

・関連コンテンツ

in AI, セキュリティ, Posted by logu_ii

You can read the machine translated English article Google, Microsoft, NVIDIA, Intel, and ot….