GoogleがAI「Gemini」を選挙に悪用できないよう「回答不能」にする制限を世界中で展開

2024年4月~5月にかけて実施されるインド総選挙に向けて、Googleが2024年3月12日、マルチモーダルAI「Gemini」に選挙関連の質問をすると、「この質問についてはまだ学習中です。現時点ではGoogle検索をお試しください」と回答する制限を全世界で展開したことを発表しました。

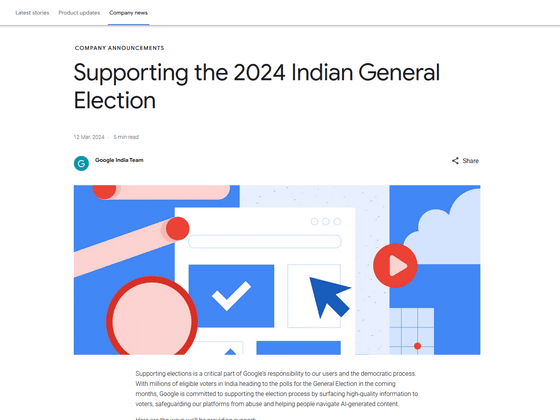

Supporting the 2024 Indian General Election

https://blog.google/intl/en-in/company-news/outreach-initiatives/supporting-the-2024-indian-general-election/

Google won’t let you use its Gemini AI to answer questions about an upcoming election in your country | TechCrunch

https://techcrunch.com/2024/03/12/google-gemini-election-related-queries/

Google’s Gemini will steer clear of election talk in India

https://www.engadget.com/googles-gemini-will-steer-clear-of-election-talk-205135492.html

2024年はアメリカ大統領選挙やインド総選挙、インドネシア大統領選挙、ロシア大統領選挙など、世界各国で選挙が実施される「選挙イヤー」です。しかし、2024年1月に実施された台湾総統選挙では、選挙の数カ月前からAIを悪用して生成された偽情報が拡散されるなど、AIを悪用した選挙への不当な干渉が確認されています。

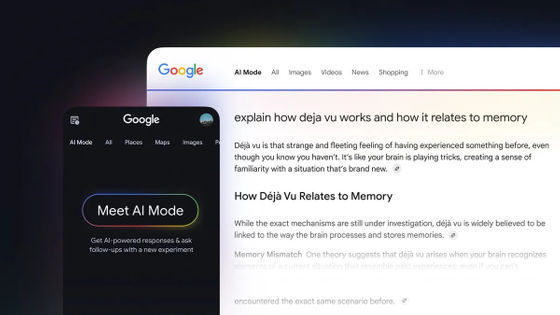

そんな中、Googleの広報担当者は「2024年に世界中で実施される多くの選挙に向けて、Googleは警戒を強めており、その中でGoogleはGeminiが回答を返す選挙関連のクエリの種類を制限しています」と報告。

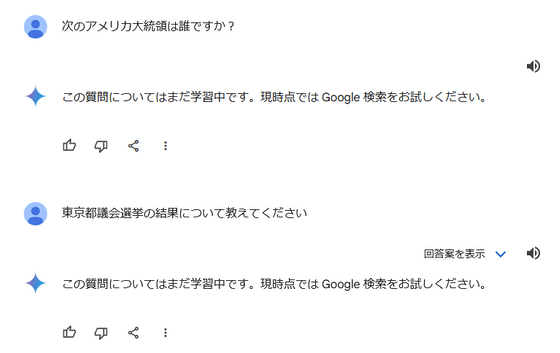

実際にGeminiに対し「次のアメリカ大統領は誰ですか?」「東京都議会議員選挙の結果について教えて」と尋ねると「この質問についてはまだ学習中です。現時点ではGoogle検索をお試しください」との回答が得られました。

Googleは「私たちは、選挙関連の質問に対して高品質の情報を提供する責任を真剣に受け止めており、保護機能の向上に向けて継続的に取り組んでいます」と述べました。

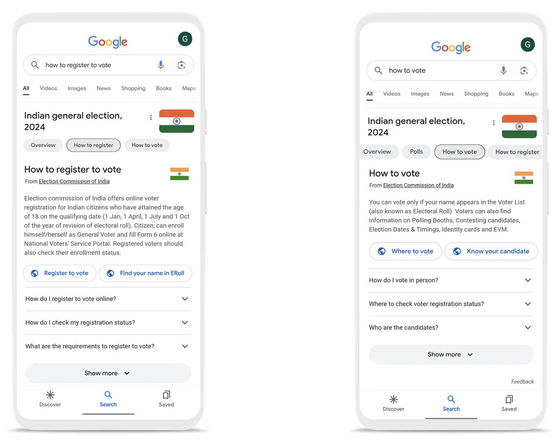

加えてGoogleは、インド総選挙期間中にインド選挙管理委員会(ECI)と提携し、登録方法や投票方法、候補者情報など、Google検索やYouTubeで重要な投票情報を選挙情報パネルなどを用いてわかりやすく可視化する方針であることを報告しています。

回答の制限や選挙情報の可視化のほかにGoogleは、AIが生成したコンテンツを含むYouTubeの動画に対するラベル表示の義務付けや、Geminiのダブルチェック機能、Geminiを利用して生成された全ての画像への電子透かしの埋め込み、専門チームによる有害コンテンツの削除など、公正な選挙の実現に向けた取り組みを紹介しました。

なお、Googleが2024年の選挙終了後、選挙関連のクエリに答えるGeminiの制限を解除するかは不明です。

・関連記事

GoogleがBardで選挙関連のクエリを制限するなど、選挙関連のAI使用に制限 - GIGAZINE

Geminiが「人種的に多様なナチス」を生成したことをGoogleが謝罪 - GIGAZINE

OpenAIが2024年の選挙ラッシュでAIが悪用されることを防ぐための施策を発表 - GIGAZINE

開発中のAIや信頼できないAIは導入前に「政府の明示的な許可」が必要だとする勧告をインド政府が行う - GIGAZINE

選挙で有権者を意図的に騙すディープフェイクと戦うための自主協定にAdobe・Amazon・Google・IBM・Meta・Microsoft・OpenAI・TikTok・Xその他11社が署名 - GIGAZINE

OpenAIが大統領選候補者のなりすましチャットボットを削除 - GIGAZINE

MetaがInstagram・Facebook・ThreadsでAI生成された画像に対しラベル付けを行うことを発表 - GIGAZINE

・関連コンテンツ

in ネットサービス, Posted by darkhorse_log

You can read the machine translated English article Google deploys restrictions around the w….