マルチモーダルAI「Gemini」の性能をアピールするGoogleの公式ムービーはフェイクだったという指摘

Googleが2023年12月6日に発表した大規模言語モデル(LLM)の「Gemini」は、文字だけではなく画像や映像なども理解してユーザーとやり取りができるマルチモーダリティが大きな特徴で、Googleが公開したGeminiの性能を示すデモムービーは大きな話題となりました。しかし、このムービーで示されたGeminiのデモはフェイクではないかと指摘されています。

Google’s best Gemini demo was faked | TechCrunch

https://techcrunch.com/2023/12/07/googles-best-gemini-demo-was-faked/

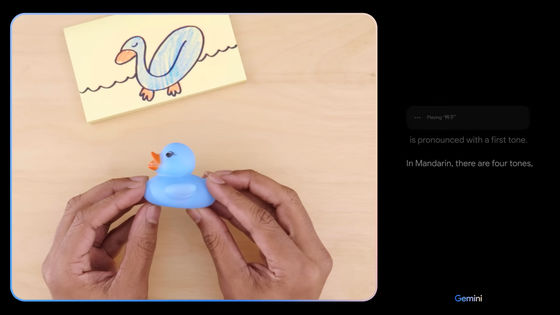

フェイクだと指摘されたデモムービーが以下。

Hands-on with Gemini: Interacting with multimodal AI - YouTube

Bloombergの記者であるパーミー・オルソン氏は「広報担当者によると、このムービーはリアルタイムでも音声でもありませんでした。Geminiには映像の静止画を提示してプロンプトを入力し、映像に字幕でプロンプトを表示したそうです」と述べています。

????PSA about Google’s jaw-dropping video demo of Gemini - the one with the duck:

— Parmy Olson (@parmy) December 7, 2023

It was not carried out in real time or in voice. The model was shown still images from video footage and human prompts narrated afterwards, per a spokesperson. More here: https://t.co/ITU29Z5Oi9 pic.twitter.com/b9Bl9EpuuI

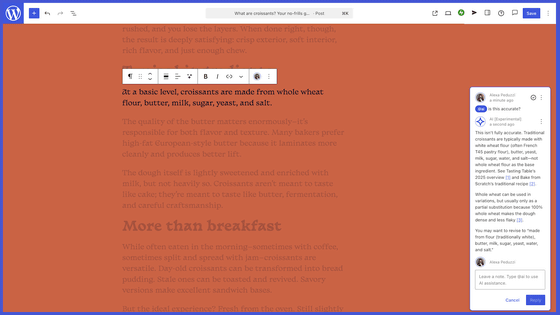

ムービーでは、映像や画像を見てそのままGeminiが応答をしているように見えますが、実際はGeminiは映像を見ながらリアルタイムで判断して回答していたのではなく、あくまでも映像の静止画を見た上でテキストプロンプトを使ってやり取りしていたというわけです。ただし、この入力したテキストプロンプトについて、Googleは以下の開発者向けブログで明らかにしています。

How it’s Made: Interacting with Gemini through multimodal prompting - Google for Developers

https://developers.googleblog.com/2023/12/how-its-made-gemini-multimodal-prompting.html

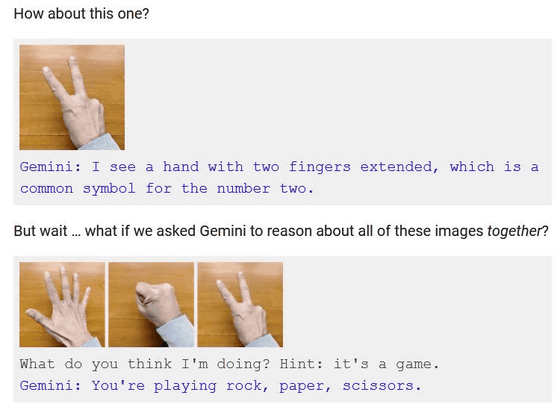

ムービーの2分45秒辺りでは、Geminiとじゃんけんをするシーンがあります。

このシーンではGeminiが手の形と動きを見て「じゃんけんですね!」と気付いたように見せていますが、実際はパー・グー・チョキの3種類の画像を読み込ませた上で「What do you think I'm doing? Hint: it's a game.(私は何をしているでしょうか? ヒント:これはゲームです)」とプロンプトで尋ねていたというわけです。

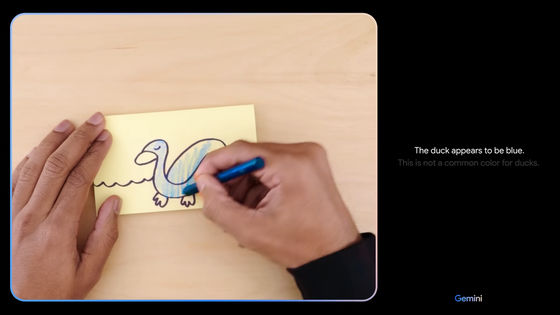

また、青いゴムのアヒルについてGeminiと会話する部分については開発者向けブログでは明らかにされておらず、IT系ニュースサイトのTechCrunchは不信感を示しています。

デモムービーのタイトルは「Hands-on with Gemini」となっていることから、まるでGeminiの実動作を示しているように誤解するタイトルになっているとTechCrunchは指摘。さらに「おそらくGoogle AIのデモは誇張されていると想定する必要があります。私であれば記事の見出しにこの映像は『捏造された』と書きます。最初は、この厳しい言葉が正当化されるのかどうかわかりませんでした」と述べており、実際の機能ではないものをデモムービーのように公開したGoogleに対して批判しています。

TechCrunchは「一見似ていますが、これは同じインタラクションであるように感じられません。一方は抽象的なアイデアをその場で捉えた直感的で言葉のない評価であり、もう一方は機能制限を示す、工学的でヒントの多い相互作用です。Geminiの場合は前者ではなく、後者でした」と指摘しています。

なお、TechCrunchによると、Google DeepMindの研究担当ヴァイスプレジデントであるオリオール・ヴィニャルス氏から記事公開後に「このムービーはGeminiで構築されるマルチモーダリティのユーザーエクスペリエンスがどのようなものになり得るかを示しています。私たちは開発者にインスピレーションを与えるためにこのムービーを作りました」というコメントが得られたそうです。

・関連記事

任天堂が1980年代に発売した光線銃ゲーム「ダックハント」のブラウン管画面をスローモーション撮影してわかる驚きの仕組みとは? - GIGAZINE

文字・音声・画像を同時に処理して人間以上に自然なやりとりができるGPT-4を超える性能のマルチモーダルAI「Gemini」がリリースされる - GIGAZINE

AIモデル「Gemini Pro」で大幅強化されたBardが利用可能に、2024年にはGemini Ultra搭載の「Bard Advanced」も登場 - GIGAZINE

文字・音楽・画像を同時に処理する「マルチモーダルAI」の性能がよく分かるGoogleの「Gemini」ハウツー動画11種を解説 - GIGAZINE

マルチモーダルAI「Gemini」を軸に「デジタルエージェント」「検索エンジン」「Chromeとの統合」などをGoogleのサンダー・ピチャイCEOとDeepmind創設者のデミス・ハサビスが語る - GIGAZINE

GoogleのマルチモーダルAI「Gemini」ベースのプログラミングに特化したAI「AlphaCode 2」登場、競技プログラミング上位15%に入る性能 - GIGAZINE

・関連コンテンツ

in AI, 動画, ソフトウェア, Posted by log1i_yk

You can read the machine translated English article Pointed out that Google's official m….