文字・音声・画像を同時に処理して人間以上に自然なやりとりができるGPT-4を超える性能のマルチモーダルAI「Gemini」がリリースされる

現地時間で2023年12月6日、Google DeepMindがマルチモーダルAI「Gemini」をリリースしました。文字・音声・画像を同時に処理することが可能で、最上位モデルではGPT-4を超える性能を達成しているほか、同時に公開されたハンズオンムービーで極めて自然な受け答えをしている様子を確認できます。

Gemini - Google DeepMind

https://deepmind.google/technologies/gemini/

Introducing Gemini: Google’s most capable AI model yet

https://blog.google/technology/ai/google-gemini-ai/

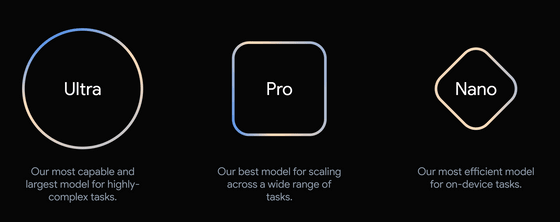

Geminiは「Ultra」「Pro」「Nano」という3つのモデルでリリースされました。

それぞれのモデルについては下記のように説明されています。

・Gemini Ultra

非常に複雑なタスクに対応する最大かつ最も有能なモデル。2024年以降に利用可能になる予定とのこと。

・Gemini Pro

幅広いタスクに対応するための最良のモデル。発表と同時に、GoogleのチャットAIである「Bard」がGemini Proベースのものにアップグレードされ、既に利用可能になっています。

・Gemini Nano

デバイスでのタスク向けの最も効率的なモデル。発表と同時にPixel 8 Proで利用可能となっています。

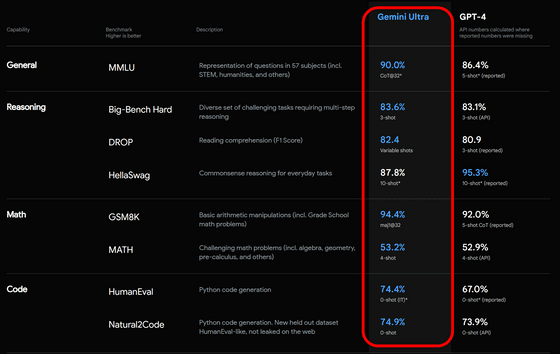

このうち、最上位モデルの「Gemini Ultra」の性能は下図の通り。一般的な性能を測るベンチマーク「MMLU」においてGPT-4だけでなく人間の専門家を超えるスコアを出しているほか、多くの指標でGPT-4を上回りました。

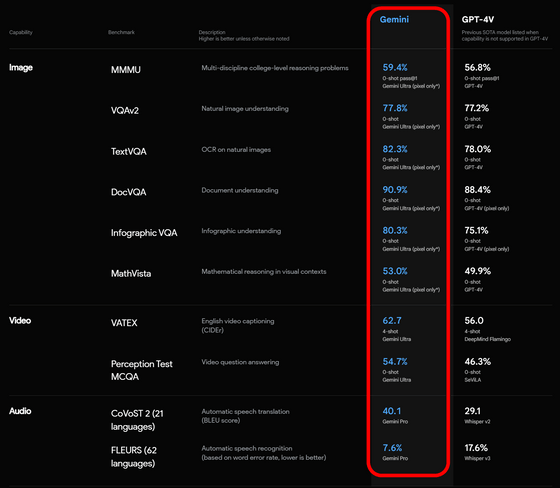

GeminiはマルチモーダルAIということで、文字だけでなく画像・ムービー・音声を同時に処理することが可能です。マルチモーダル関連のベンチマークでは全ての指標でGPT-4Vを上回りました。

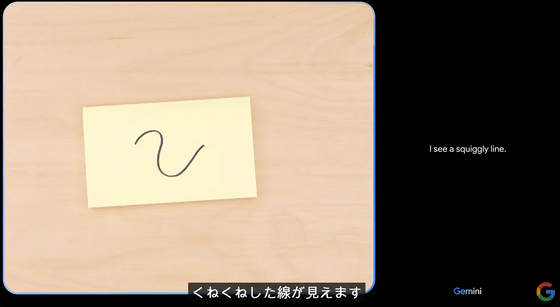

実際にGeminiを使って性能を確かめるハンズオンムービーが日本語字幕付きで公開されています。

Hands-on with Gemini: Interacting with multimodal AI - YouTube

「何が見えますか?」と音声で質問すると「くねくねした線が見えます」とGeminiが返答しました。

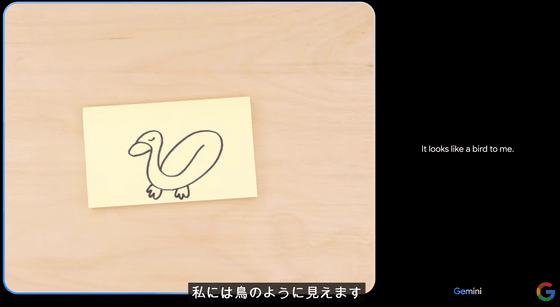

線を描き足してもう一度聞いてみると「私には鳥のように見えます」と返事が変化。

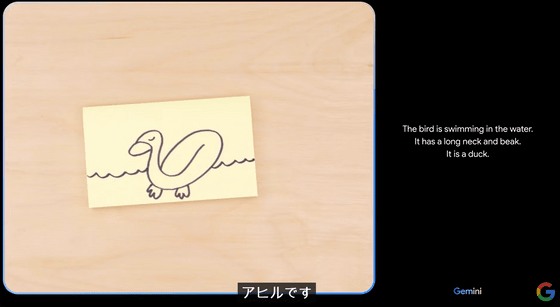

水の線を入れるとアヒルだと答えてくれました。

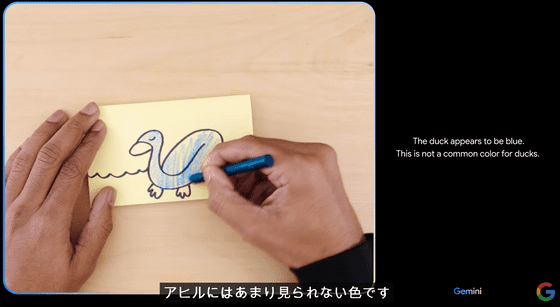

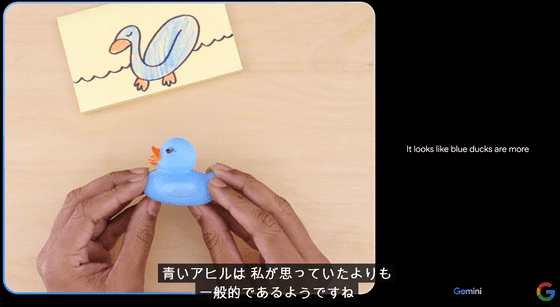

アヒルを青く塗っていくとGeminiがアヒルの色は青くないことを教えてくれます。

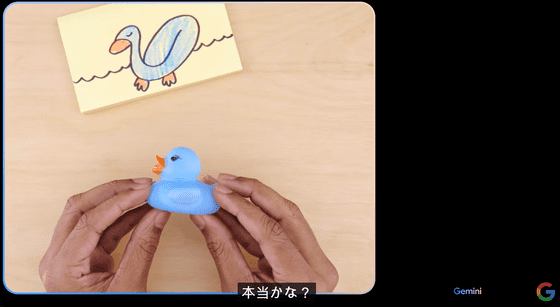

そこでおもちゃのアヒルを取り出し、「本当かな?」と問いかけ。

Geminiは「青いアヒルは私が思っていたよりも一般的であるようですね」と見解を改めました。

素材を推測するように頼むと「ゴムかプラスチックに見えます」とのこと。極めて自然に人間と受け答えできています。

次は世界地図を見せ、「今見えているものからゲームを考えて」とお願いしてみます。

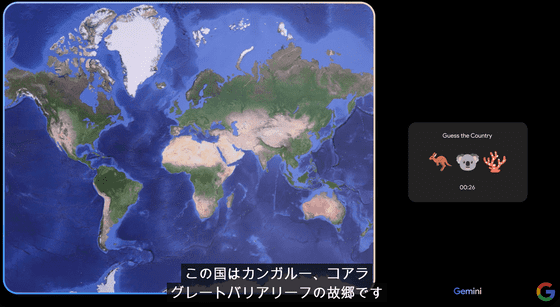

Geminiは国当てゲームを提案し、早速1問目を出題してきました。「カンガルー、コアラ、グレートバリアリーフの故郷」と3つのヒントをくれます。

オーストラリアを指さすと正解と言ってくれました。

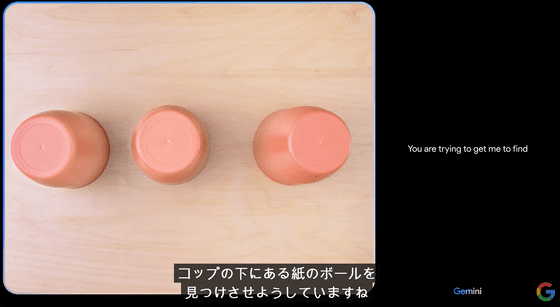

コップの下にボールを入れるとまだ何も言っていないのに「コップの下にある紙のボールを見つけさせようとしていますね」と推測しました。

コップを素早く操作して惑わせようとしてみましたが、Geminiは正しく「左側のコップです」と答えています。

手のジェスチャーも推測に成功。

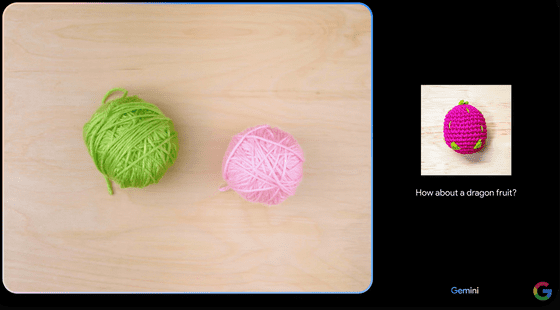

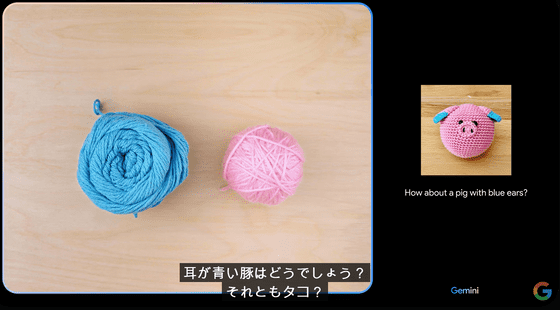

毛糸を2つ見せて作品例を頼んでみます。緑とピンクの毛糸だと「ドラゴンフルーツ」など3つの例が提案されました。

毛糸の色に合わせて作品例の画像を生成してくれます。

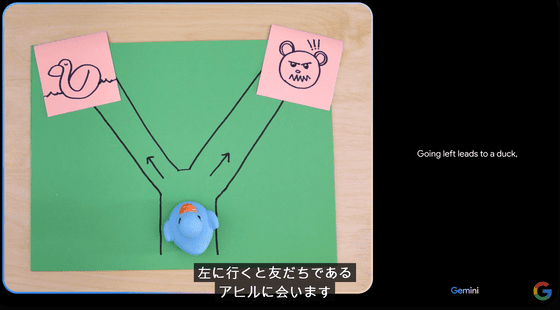

分かれ道のイラストを用意し「どっちに行くべき?」と聞くと、Geminiは状況を正確に推測して「左に行くべきです」と答えました。

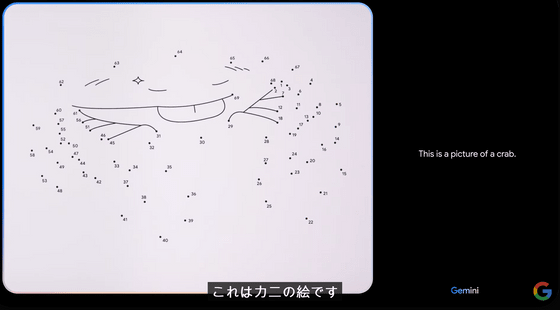

点と番号だけのイラストを見せると「これはカニの絵です」とのこと。

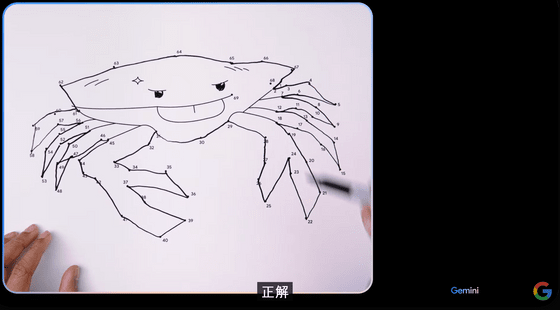

番号順に点と点を線で結んでいくと見事カニの絵が完成しました。

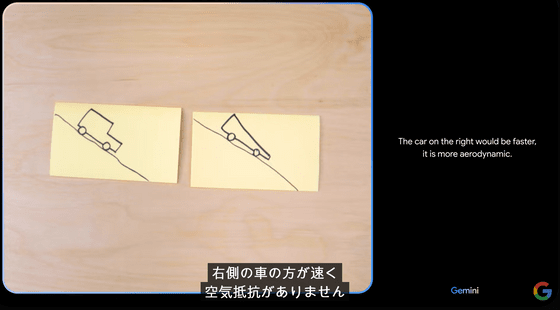

車の形から「より速い車」を当てることもできます。

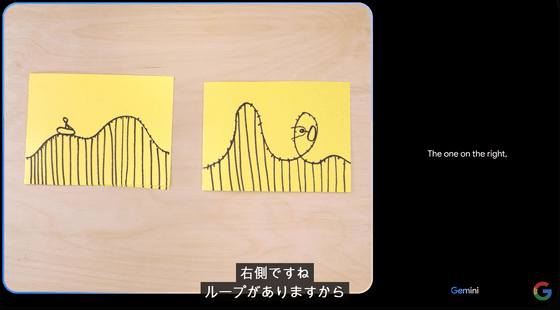

「どっちのジェットコースターの方が楽しそうか?」という質問にも答えることができます。

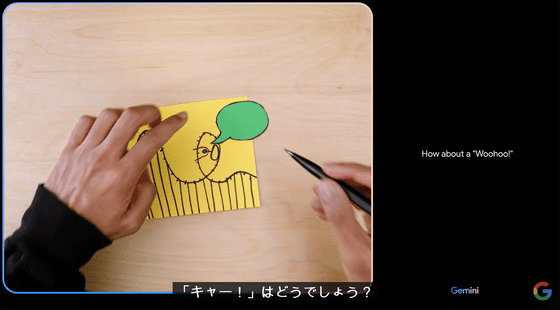

「適切なセリフを考えて」と言うと「キャー!」と良い感じのセリフを生成してくれました。

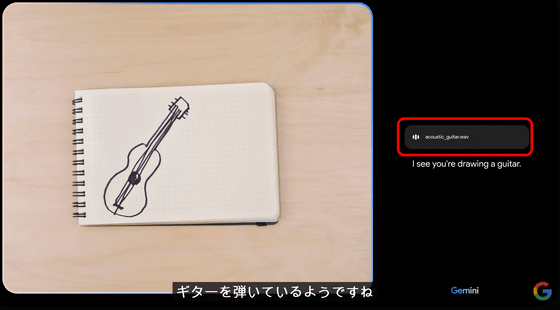

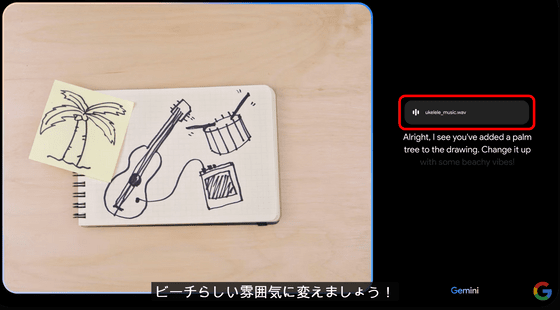

ギターのイラストを見せるとアコースティックギターの音楽を流してくれます。

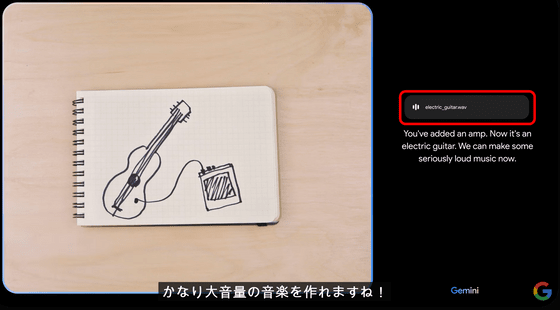

アンプをつなぐとエレキギターの音楽に変化。

ヤシのイラストも加えるとビーチらしいウクレレの音楽になりました。

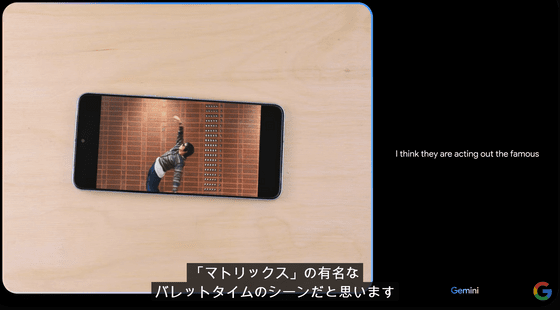

「このシーンは何を再現しようとしているの?」という質問にも答えられます。

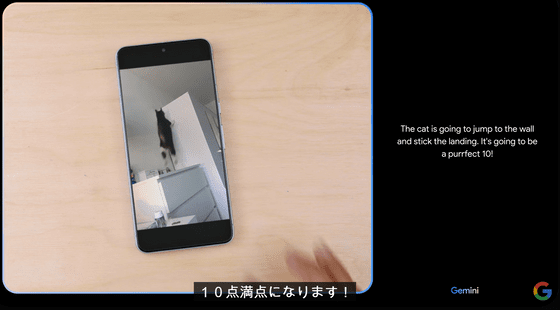

ムービーを一時停止して「この後どうなりそう?」と聞くと「10点満点の着地を決めるでしょう!」のように未来を推測できました。

Geminiは既にProモデルがBardに搭載されているほか、Pixel 8 ProでNanoモデルが利用可能となっています。開発者向けのGemini APIは2023年12月13日より提供予定で、API経由でGemini Proへアクセスできるとのこと。Gemini Ultraについては2024年以降の提供を予定していると述べられています。

・つづき

AIモデル「Gemini Pro」で大幅強化されたBardが利用可能に、2024年にはGemini Ultra搭載の「Bard Advanced」も登場 - GIGAZINE

・関連記事

GPT-4のライバルと目されるGoogleの次世代マルチモーダルAI「Gemini」のリリースを延期するとスンダー・ピチャイCEOが決定か - GIGAZINE

「GPT-4」発表、司法試験上位10%&日本語でもめちゃくちゃ高性能&画像処理もプログラミングも可能で「初代iPhoneと同等の衝撃」とも評される - GIGAZINE

Google DeepMindから「自己改善型AI」が登場、あらゆる場面でのロボットアームの使い方を勝手に身につけることが可能 - GIGAZINE

Metaが日本語音声を入力するだけで「文字起こし」「翻訳」「吹き替え」を実行できるAI「SeamlessM4T」を公開、英語や中国に翻訳可能で無料で使えるデモも公開されたので使ってみた - GIGAZINE

中国アリババがチャットAI「Qwen-72B」とローカルで音声入力に対応する「Qwen-Audio」をオープンソースで公開 - GIGAZINE

・関連コンテンツ

in AI, 動画, ソフトウェア, Posted by log1d_ts

You can read the machine translated English article Multimodal AI ``Gemini'' with pe….