3990億パラメータのオープンウェイトAIモデル「Trinity-Large-Thinking」リリース、複雑で長期的なエージェントと複数ターンにわたるツール呼び出しが得意

アメリカのサンフランシスコに拠点を置くAIスタートアップのArcee AIが、3990億個のパラメータを持つオープンウェイトモデル「Trinity-Large-Thinking」を改変や商用利用が可能なApache 2.0ライセンスで公開しました。

Arcee AI | Trinity-Large-Thinking: Scaling an Open Source Frontier Agent

https://www.arcee.ai/blog/trinity-large-thinking

arcee-ai/Trinity-Large-Thinking · Hugging Face

https://huggingface.co/arcee-ai/Trinity-Large-Thinking

Today we're releasing Trinity-Large-Thinking.

— Arcee.ai (@arcee_ai) April 1, 2026

Available now on the Arcee API, with open weights on Hugging Face under Apache 2.0.

We built it for developers and enterprises that want models they can inspect, post-train, host, distill, and own. pic.twitter.com/jumuYehJdo

Arcee's new, open source Trinity-Large-Thinking is the rare, powerful U.S.-made AI model that enterprises can download and customize | VentureBeat

https://venturebeat.com/technology/arcees-new-open-source-trinity-large-thinking-is-the-rare-powerful-u-s-made

Arcee AI Ships 400B Open Model Rivaling Claude at 96% Less

https://www.implicator.ai/arcee-ai-releases-400b-open-reasoning-model-that-rivals-claude-at-96-lower-cost/

Arcee AIは現地時間の4月1日、3990億個のパラメータを持つテキストのみの推論モデルであるTrinity-Large-Thinkingを公式にリリースしました。Trinity-Large-ThinkingはArcee AIのAPIを利用して使えるほか、Hugging Face上で重み付けデータがApache 2.0ライセンスの下で公開されています。

Arcee AIはわずか30人からなる小規模なチームであり、2026年初頭に同社の総資金の約半分にあたる2000万ドル(約32億円)を投じ、Trinity-Large-Thinkingを33日間にわたってトレーニングしました。トレーニングには2048個のNVIDIA B300 Blackwell GPUを活用したほか、AIの学習データ選別を自動化するDatologyAIとの提携により、厳選されたウェブデータと高品質の合成データからなる20兆個のトークンを用いたとのこと。

Trinity-Large-Thinkingの特徴としては、複数のエキスパートモデルを統合して全体のパフォーマンスを向上させる、Mixture-of-Expertsというアーキテクチャを採用している点です。これにより、特定のトークンに対してアクティブなパラメータは全体のわずか1.56%、つまり130億個にとどまるとVentureBeatは指摘しています。

Mixture-of-Expertsを採用することで、Trinity-Large-Thinkingは大規模システムならではの深い知識を持ちながら、はるかに小規模なシステムのような推論速度と運用効率を維持することが可能。同じハードウェア上で同等のモデルと比較すると、約2~3倍も高速に動作するそうです。

また、AnthropicのClaude Opus 4.6は100万出力トークンあたりのコストが25ドル(約4000円)なのに対し、Trinity-Large-Thinkingは100万出力トークンあたりわずか0.9ドル(約140円)という、圧倒的なコストの低さも魅力的です。Arcee AIは、「私たちは心から納得できる競争力とトークン単価の水準に到達しました」と述べています。

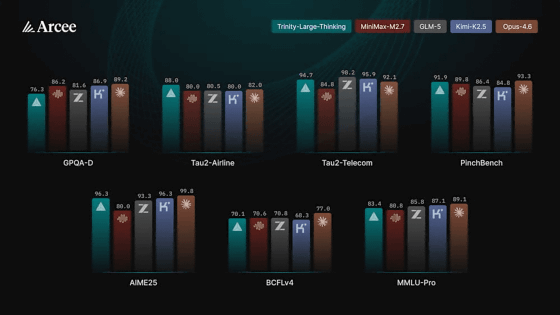

以下のグラフは、各種ベンチマークにおける性能をTrinity-Large-Thinking(緑色)・MiniMax-M2.7(赤色)・GLM-5(灰色)・Kimi-K2.5(青色)・Claude Opus 4.6(オレンジ色)で比較したもの。Trinity-Large-ThinkingはオープンウェイトモデルであるMiniMax-M2.7やGLM-5といったモデルに匹敵する性能を見せたほか、自律的なエージェントタスクに関するベンチマークのPinchBenchでは、市場をリードするクローズドモデルであるClaude Opus 4.6に次ぐスコアを記録しました。

Arcee AIは公式ブログで、「9カ月前、私たちは会社のあり方を変える決断を下しました。私たちは本格的なアメリカのオープンモデル、つまり開発者や企業が実際に所有できるモデルを重視するのであれば、自分たちでそれを構築する必要があると判断しました」と述べています。

このような主張の背景には、学習済みAIモデルを公開して誰でも利用可能にしているオープンウェイトモデルに関して、DeepSeekやGLM(Z.ai)、Qwen(Alibaba)といった中国製AIが独占的だと指摘されていることがあります。オープンウェイトモデルは安価かつ利用しやすいため、多くの企業によって採用されていますが、多くのオープンウェイトモデルが中国製という点に懸念を覚える人々もいます。

しかし2026年に入ると、中国の研究機関は独自のエンタープライズプラットフォームやサブスクリプションへと移行しつつあり、高性能なオープンウェイトモデル分野に空白が生み出されています。Arcee AIはその空白を埋める存在として期待がかけられています。

テクノロジー系メディアのVentureBeatは「この動きは、企業が重要インフラにおいて中国発のアーキテクチャに依存することへの懸念を強めている、まさにそのタイミングで起こっています。その結果、国内の有力企業への需要が生まれており、Arcee AIはそれに応えることを目指しているのです」と述べています。

Hugging Faceのクレメント・デラングCEOはVentureBeatへのメッセージで、「アメリカの強みは常にスタートアップにあります。だからこそこうしたスタートアップに、オープンソースAIの分野でリードしてくれるように期待をかけるべきなのかもしれません。Arcee AIはそれが可能であることを示しています!」とコメントしました。

・関連記事

複数のPCからリソースをかき集めて巨大なAIモデルをローカル実行できる「mesh-llm」 - GIGAZINE

人間が行うような高度な器用さが必要な作業をロボットで実行可能にするAIモデル「GEN-1」、実際にロボットを動かすとこうなるという動画あり - GIGAZINE

無料でWindows・macOSのファイルやブラウザを内蔵ローカルAIを使いAPIキー不要で自動操作できる「Accomplish」、OpenAIやAnthropicなどの外部AIも利用可能 - GIGAZINE

AI関連求人で「AI責任者」や「データアノテーター」の職が急増中 - GIGAZINE

なぜAIはまるで「感情」を持っているみたいに振る舞うのか? - GIGAZINE

AIの誤情報を疑うこと無くそのまま受け入れる「認知的降伏」という状態に多数の人が陥っていることが明らかに、1372名の参加者と9000回以上の実験で - GIGAZINE

GPT・Llama・Grokなどさまざまな大規模言語モデルのアーキテクチャを図示した「LLM Architecture Gallery」 - GIGAZINE

・関連コンテンツ

in AI, Posted by log1h_ik

You can read the machine translated English article Trinity-Large-Thinking, an open-weight A….