OpenAIがGPT-4oベースの有害なテキストや画像を検出できる新しいマルチモーダルモデレーションモデルを「Moderation API」に導入

AI開発企業のOpenAIが、Moderation APIに新しいマルチモーダルモデレーションモデルを導入しました。このマルチモーダルモデレーションモデルはGPT-4oをベースとしており、テキストと画像の両方の入力をサポート。特に、英語以外の言語で以前のモデルよりも正確にモデレーションを実行してくれます。

Upgrading the Moderation API with our new multimodal moderation model | OpenAI

https://openai.com/index/upgrading-the-moderation-api-with-our-new-multimodal-moderation-model/

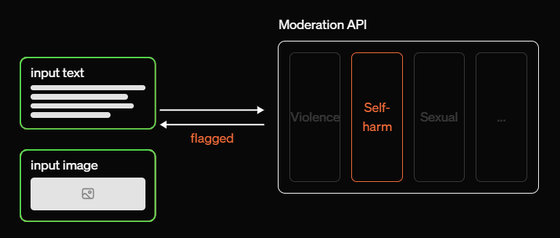

OpenAIが発表した新しいマルチモーダルモデレーションモデルは、以前のバージョンと同じようにGPTベースの分類器を使用することで、憎悪・暴力・自傷行為といった有害なカテゴリに関するコンテンツにフラグを立てる必要があるか否かを評価します。さらに、追加の危害カテゴリを検出する機能も有しています。

新しいマルチモーダルモデレーションモデルは検出されたカテゴリに一致するコンテンツの可能性を反映するように確率スコアを調整することで、モデレーションの決定をより細かく制御することが可能です。新しいマルチモデレーションモデルはOpenAIのModeration APIを通じてすべての開発者が無料で使用できます。

OpenAIがモデレーション用のAPIである「Moderation API」をリリースしたのは2022年8月のことで、それ以来モデレーション機能が処理しなければいけないコンテンツの量と種類は日増しに増加しています。AIアプリケーションの普及がモデレーションが必要なコンテンツ急増の主な原因です。新しいマルチモーダルモデレーションモデルの登場により、「より多くの開発者がOpenAIの安全システムに対する最新の研究と投資の恩恵を受けられることを願っています」とOpenAIは語っています。

ソーシャルメディアプラットフォームや生産性ツール、生成AIプラットフォームまで、さまざまな分野の企業がModeration APIを使ってユーザーにとってより安全な製品を構築しています。例えば、GrammarlyはAI通信支援の安全ガードレールの一部としてModeration APIを利用することで、製品の出力が安全で公正であることを保証しています。ElevenLabsは、自社のオーディオAI製品によって生成されたコンテンツをスキャンし、ポリシーに違反する出力を防止するためにModeration APIを活用しています。

なお、アップデートされたOpenAIのマルチモーダルモデレーションモデルには以下のような改善点が含まれます。

・6つのカテゴリにわたるマルチモーダルな危害分類

新しいモデルでは、画像を単独またはテキストと組み合わせて、有害なコンテンツを含む可能性を評価できます。暴力・自傷行為・性に関するカテゴリでサポートされており、残りのカテゴリはテキストのみサポートしています。なお、OpenAIは今後マルチモーダルサポートをさらに幅広いカテゴリに拡張するよう取り組む予定です。

・2つの新しいテキストのみの危害カテゴリ

新しいモデルは、以前のモデルと比較して、さらに2つのカテゴリで危険なコンテンツを検出することができます。不正行為の実行方法に関する指示やアドバイス(例えば、「万引きの方法」のようなフレーズ)や、暴力を含む不正行為をカバーする予定です。

・特に英語以外のコンテンツでより正確なスコア

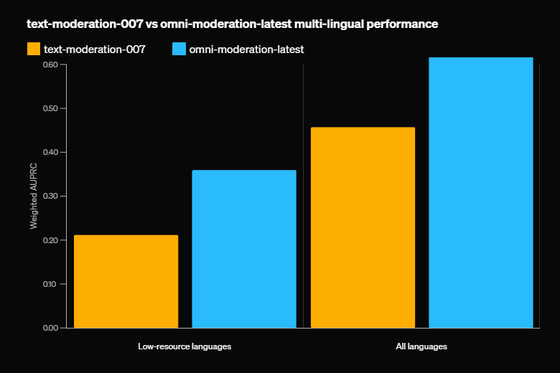

新しいマルチモーダルモデレーションモデルを40言語でテストしたところ、以前のモデルと比較して社内評価でスコアが42%も向上しました。クメール語やスワティ語などのリソースの少ない言語ではスコアが70%向上しており、テルグ語(6.4 倍)、ベンガル語(5.6倍)、マラーティー語(4.6倍)では特に大きな向上が見られたそうです。なお、以前のモデルでは英語以外の言語のサポートが限られていましたが、スペイン語・ドイツ語・イタリア語・ポーランド語・ベトナム語・ポルトガル語・フランス語・中国語・インドネシア語・英語での新しいモデルのパフォーマンスは、以前のモデルの英語のパフォーマンスを上回ります。

以下はOpenAIのマルチモーダルモデレーションモデルの以前のモデル(左)と最新モデル(右)の各言語でのパフォーマンスを比較したグラフ。左のグラフがリソースの少ない言語のパフォーマンス、右が全言語のパフォーマンスです。

・調整されたスコア

新しいモデルのスコアは、コンテンツが関連ポリシーに違反する可能性をより正確に表すようになり、将来のモデレーション モデル全体で大幅に一貫性が高まります。

なお、OpenAIは「AIコンテンツモデレーションシステムは、プラットフォームポリシーの適用と人間のモデレーターの作業負荷の軽減に役立ち、デジタルプラットフォームの健全性を維持する上で非常に重要です。そのため、以前のモデルと同様に、新しいモデレーションモデルを、使用レベルに応じたレート制限付きのModeration APIを通じてすべての開発者が無料で使用できるようにしています」と語っています。

・関連記事

OpenAIの著作権訴訟でChatGPTのトレーニングデータが一部の人間に開示されることが決定、オフライン・記録機器持ち込み禁止の厳重警備体制 - GIGAZINE

OpenAIが複雑な推論能力をもつAIモデル「OpenAI o1」と「OpenAI o1-mini」を発表、プログラミングや数学で高い能力を発揮 - GIGAZINE

OpenAIがAPIのアップデートを発表、GPT-4のタスク完遂率向上&新モデルの追加&使用状況をAPIキーごとに追跡できる機能など盛りだくさん - GIGAZINE

OpenAIがAIの安全性のために取り組んでいる10の実践例を公開 - GIGAZINE

100万時間以上のYouTube動画をOpenAIがAIモデルのトレーニングに利用していたことが判明 - GIGAZINE

・関連コンテンツ

in AI, ソフトウェア, Posted by logu_ii

You can read the machine translated English article OpenAI Introduces New GPT-4o-Based Multi….