盗聴AIを防止するためのAI「Neural Voice Camouflage」が登場

PCやスマートフォンといったコンピューティングデバイスに「スパイウェア」を潜ませることでユーザーの会話を盗聴したり、AmazonのスマートスピーカーであるEchoを盗聴器に改造することができたりと、スマートデバイスの普及により盗聴の危機はより身近なものとなりつつあります。そんな盗聴からユーザーを守るためのAIテクノロジーが「Neural Voice Camouflage」で、バックグラウンドからカスタムオーディオノイズを生成することで、録音された音声を聞き取り不可能なものとします。

Real-Time Neural Voice Camouflage | OpenReview

https://openreview.net/forum?id=qj1IZ-6TInc

Is technology spying on you? New AI could prevent eavesdropping | Science | AAAS

https://www.science.org/content/article/technology-spying-you-new-ai-could-prevent-eavesdropping

「Neural Voice Camouflage」は、AIをだます攻撃である「adversarial attacks(敵対的攻撃)」を用いたAIテクノロジーで、機械学習を利用してAIが他の何かと間違えるように音声を微調整します。敵対的攻撃について、学術誌のScienceは「AIを用いて別のAIをだますようなもの」と説明しています。

「AIを用いて別のAIをだます」と表現すると簡単に思えるかもしれませんが、このプロセスは思ったほど簡単なものではありません。敵対的攻撃を用いた音声処理の場合、音声データ全体を処理する必要があるため、リアルタイムでの音声処理は難しくなります。

しかし、Neural Voice Camouflageでは、未来を効果的に予測するために脳に触発された機械学習システムであるニューラルネットワークを利用。研究チームはNeural Voice Camouflageで使用するニューラルネットワークを何時間にもわたる音声データを用いて学習させることで、常に2秒分の音声データを処理しながら、それに続く可能性が高い音声に対してどのようにノイズを加えるかを推測し続けることが可能となっています。

例えば、誰かが「宴会を楽しんでください」と言った場合、次にどのような言葉が出てくるかを正確に予測することはできません。しかし、話者の声の特徴や、今言われたことを考慮してその後に続くであろうフレーズを聞こえなくなるするような音声を生成することは可能とのこと。なお、Neural Voice Camouflageが生成する音は人間にとってはバックグラウンドノイズのように聞こえるため、会話を阻害せずに盗聴に用いられるAIだけを妨害することが可能になるそうです。

開発チームはNeural Voice Camouflageの精度を検証するために、自動音声認識(ASR)システムのひとつを利用。音声をNeural Voice Camouflageで処理したところ、ASRの単語認証精度を88.7%から19.8%にまで低下させることに成功しています。一方で、音声にホワイトノイズを加えただけの場合はASRの単語認証精度は87.2%、Neural Voice Camouflageのような予測機能のない敵対的攻撃を用いたノイズ処理の場合は79.5%と、ほとんど盗聴防止に役立てることができないないことが明らかになっています。

さらに、ASRを盗聴防止技術をかいくぐって音声認識できるように学習した場合であっても、Neural Voice Camouflageを用いればASRの単語認証精度を47.5%に抑えられることが明らかになっています。なお、Neural Voice Camouflageで盗聴を困難にすることが難しい単語は「the」などの短い単語で、これらは会話の中でも最も目立たない部分であると研究者は主張しています。

加えて、Neural Voice Camouflageの開発チームは録音用のマイクが置かれている部屋にあるスピーカーセットを利用して、盗聴が困難になるようなノイズを出力するというテストも実施しています。このテストも成功しており、例えば「I also just got a new monitor(私も新しいモニターを入手しました)」という会話が、ASRに「with reasons with they also toscat and neumanitor(トスカットやノイマニアもそうですが、理由があってのことです)」と誤認識されています。

この研究を主導したコロンビア大学のコンピューターサイエンティストであるMia Chiquier氏は、「これはAIを利用してプライバシーを保護するための最初のステップに過ぎません」「AIは我々の声、顔、行動に関するデータを収集します。これに対抗するための、プライバシーを尊重する新世代のテクノロジーが必要です」と語りました。

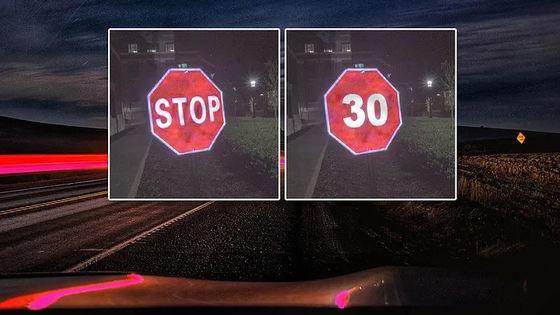

Chiquier氏はNeural Voice Camouflageで利用した予測機能は自動運転車やリアルタイム処理を必要とするその他のアプリケーションにとって大きな可能性を秘めていると主張。自動運転車技術では、車が次にどこへ向かうのか、歩行者がどこにいるのかを予測する必要があります。人間の脳はこれを正確に予測するため、Chiquier氏は「(我々のシステムは)人間が行うのと同じ方法をエミュレートします」と述べました。

ミシガン大学アナーバー校のコンピューターサイエンティストであり、音声処理について研究を進めるAndrew Owens氏は、「機械学習の古典的な問題である未来の予測と、敵対的攻撃という別の問題を組み合わせることは素晴らしいものです」と言及。イリノイ大学アーバナ・シャンペーン校のコンピューターサイエンティストであり音声による敵対的攻撃の応用について研究するBo Li氏も、ASRに対する新しいアプローチに感銘を受けたと述べています。さらに、アメリカ自由人権協会の上級政策アナリストであるジェイ・スタンリー氏は、「音声カモフラージュ技術は、重要な技術と見なされています」と述べました。

・関連記事

Huaweiがオランダ最大の電気通信事業者を盗聴できる状態だったことが判明 - GIGAZINE

マイクのないロボット掃除機を利用した盗聴の危険がある - GIGAZINE

新たな盗聴の手段として「電球の振動」から音声を復元する技術が報告される - GIGAZINE

Amazon Echoは盗聴器に改造することが可能 - GIGAZINE

政府やハッカーにスマホの会話を盗聴・マルウェア感染・位置特定を可能にさせる監視装置「IMSIキャッチャー」の実態を解明する「SeaGlass」 - GIGAZINE

あなたのヘッドホンが盗聴マイクになってしまう「Speake(a)r」 - GIGAZINE

携帯電話を傍受・盗聴してスパイ捜査に使う機器の秘密のカタログが流出 - GIGAZINE

・関連コンテンツ

in ソフトウェア, Posted by logu_ii

You can read the machine translated English article AI 'Neural Voice Camouflage' to prevent ….