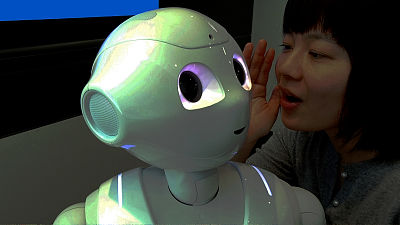

AlexaやGoogleアシスタント、Siriを人間に聞こえない音で命令することが可能

by Recklessstudios

Amazon EchoやGoogle Homeといったスピーカー型端末を使う人も増え、音声認識AIは人々の日常になじんできています。一方、ここ2年間でアメリカや中国の研究チームは「ユーザーに認識されることなくスマート・スピーカーに命令する」ということが可能であることを示し、その技術を開発してきました。この技術を利用すればスマートフォンやスマートスピーカーに搭載されたAIをひっそりとアクティベートし、電話をかけさせたり特定のウェブサイトを開かせたりが可能になります。また、悪用されれば、「特定の音楽をかける」だけで誰かの家のドアを開けたり、ネットで本人に無断で買い物をしたりということも可能になるとのこと。

Alexa and Siri Can Hear This Hidden Command. You Can’t. - The New York Times

https://www.nytimes.com/2018/05/10/technology/alexa-siri-hidden-command-audio-attacks.html

カリフォルニア大学バークレー校とジョージタウン大学の2016年の研究では、拡声器やYouTubeのムービーを通してホワイトノイズを再生させることで、「隠れたコマンド」をスマートデバイスに送ることができると示されました。「隠れたコマンド」によってウェブサイトを開いたり、端末を機内モードに変更したりができます。

音声認識AIを音声データに特殊な加工を施すことで「だます」ことが可能 - GIGAZINE

2018年5月、同研究者らは上記の研究をさらに進めた内容を発表しています。研究を行ったNicholas Carlini氏がニューヨーク・タイムズに語った内容によると、「隠れたコマンド」をホワイトノイズではなく「人の会話の録音」や「オーケストラの録音」といったものに埋め込むことに成功したとのこと。つまり、音を流すだけで端末の持ち主に知られることなくAmazonのショッピングリストにアイテムを追加するなどが可能になったわけです。

この技術は人間と機械の音声認識のギャップを利用したもの。通常、音声認識AIは音を文字に変換し、それを言葉やフレーズにまとめることで命令を認識します。このとき、AIが認識すべき「音」を打ち消して人間には認識できないよう改変を加えた「音」に置き換えることで、隠れたコマンドを埋め込むことができるとのことです。Carlini氏は、2018年5月時点では研究段階にあるこの技術が、誰かを搾取するために使われるのも時間の問題だとみています。

また2017年にはバーガーキングがテレビCMの中で「OK、Google」の音声コマンドを流し、Googleアシスタントにワッパーバーガーの説明をさせるという試みを行いました。後にGoogleがGoogleアシスタントの仕様を変更しコマンドが無効化されましたが、これは「企業が音声認識デバイスを利用して収益を上げようとした」一例だといえ、利益を追求する企業によってひそかにスマートスピーカーが利用されていく可能性も考えられます。

バーガーキングがTVのCMをトリガーにGoogle Assistantにワッパーの説明をさせるもGoogle激怒で即トリガー無効に - GIGAZINE

たとえば、アニメ「サウスパーク」の中で登場人物の1人であるカートマンが「気持ち悪い」アイテムをショッピングリストに追加するよう音声で操作を行うシーンが流されたところ、実際にアニメを見ていた人のスマートスピーカーが反応するという事態に。「午前7時にアラームを鳴らす」という操作にAmazon Echoが反応して大量のアラームがセットされてしまったという人もいたそうです。

This @SouthPark episode has set my @amazon Alexa off about 15 times so far. Had to unplug it

— Chris (@ChrisMn84)

人間に対するサブリミナル効果を映画やテレビ放送などで使用することは禁じられていますが、機械に対してサブリミナルメッセージを発する場合はどうなるのかについては、まだ法的に定まっていないところ。法律が制定されるまでには時間がかかり、テクノロジーの発展速度はそれよりも速いことから、法律が明確に制定されるまで技術が野放しになることが懸念されています。

2017年、アメリカのプリンストン大学と中国の浙江大学の研究者らは人間の耳には届かない周波数を利用して音声アシスタントをハッキングする「ドルフィン・アタック」という技術を発表しました。この攻撃では、最初に端末がミュートの状態に変えられるため、端末が返答を行ってもユーザーは認識できません。

人間に聞こえない音を巧みに操りSiriなどの音声アシスタントをハッキングする「ドルフィン・アタック」とは? - GIGAZINE

また、イリノイ大学アーバナ・シャンペーン校は25フィート(約7.6メートル)離れた場所から超音波攻撃を行うことに成功。超音波は壁を越えられませんが、窓があれば建物の外側からスマートデバイスの操作を行うことを可能になります。

スマートデバイスは多くの人に受け入れられ、Amazonは2020年までに音声アシスタントスピーカーを100億ドル(約1兆円)売り上げると予測されています。Amazon・Google・Appleの各社はスマートスピーカーを安全に保つべくセキュリティに力を入れており、Googleは上記のような「人間には認識できないコマンド」についても対策を行っているとしています。そのため、AmazonやGoogleの端末は、特定のコマンドについてはユーザー本人の声にしか反応しないとのこと。またAppleは、個人的なデータやアプリへアクセスするためのコマンドにSiriが反応するにはiPhoneやiPadがアンロックされていなければいけないという仕組みを採用しており、これも予期せぬコマンドから端末やユーザーを守る仕組みといえます。

「人間に認識できないコマンドを利用して音声認識AIを攻撃する」という手法は比較的新しいものであり、今後どのような展開を迎えるのかはまだわかりません。また、デバイスを開発する各社の対応も、端末の種類や内容によって異なってきます。カリフォルニア大学バークレー校のCarlini氏は、「このような技術が可能であるということを、私たちは示していきたいと考えています。そして誰かが『それは可能だ。直してみよう』と言ってくれるのを期待しています」と語りました。

・関連記事

音声認識AIを音声データに特殊な加工を施すことで「だます」ことが可能 - GIGAZINE

人間に聞こえない音を巧みに操りSiriなどの音声アシスタントをハッキングする「ドルフィン・アタック」とは? - GIGAZINE

Siri・Cortana・Google Assistant・Alexaなど音声アシスタントはなぜすべて「女性」なのか - GIGAZINE

Amazon Echoは盗聴器に改造することが可能 - GIGAZINE

SiriやGoogle Nowなどの音声認識アシスタントは人間が認識できないコマンドでも操作できる - GIGAZINE

Amazonの人工知能「Alexa」が呼び出していないのに突然笑いだすという事態が複数報告される - GIGAZINE

・関連コンテンツ