中国人民解放軍は「軍用人型ロボット」「宇宙戦争ロボット」「飛行ドローン軍団」「プロパガンダAI」などの開発を進めている

アメリカ・ジョージタウン大学の研究者らが、中国共産党の主要軍隊である中国人民解放軍が過去3年間に公開した数千件に及ぶ調達要請文書を分析し、「中国人民解放軍がどのようなAI利用を模索しているのか?」をまとめたレポートを公開しました。

China’s AI Arsenal | Foreign Affairs

https://www.foreignaffairs.com/china/chinas-artificial-intelligence-arsenal

Thousands of procurement documents show how China's army wants to weaponize AI

https://the-decoder.com/thousands-of-procurement-documents-show-how-chinas-army-wants-to-weaponize-ai/

2025年9月に中国で行われた軍事パレードでは、戦車や行進する兵士といった従来の軍事パレードでよく見られたものではなく、無人車両や水中・空中ドローン、自律型戦闘機といったAI関連のテクノロジーに焦点が当てられたとのこと。そこで、ジョージタウン大学の研究者であるサム・ブレスニック氏らは、過去3年間に公開された中国人民解放軍の調達要請文書を分析し、AIテクノロジーをどのように活用しようと試みているのかをまとめました。

◆ドローン軍団やロボット犬、意思決定システム

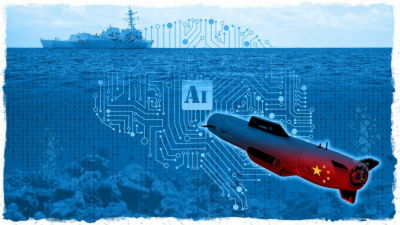

調達要請文書からは、中国人民解放軍が標的を自律的に識別・追跡し、攻撃を調整できる空中ドローンの軍団を開発していることが明らかになっています。また、ロボット犬や人型ロボットのほか、宇宙空間で人工衛星間の戦争が起きた場合に備えた小型ロボットの開発、世界中のアメリカの潜水艦を追跡するシステムへの投資も行っているとのこと。

さらに、中国の政治・軍事指導部は自分たちの指揮系統を十分に信頼しておらず、急速に展開する戦争に対応できないのではないかと懸念しています。そのため、AIを活用した意思決定システムを構築し、中国人民解放軍の経験不足を補おうとしているそうです。すでに人民解放軍の将兵はAIシステムを用いて仮想戦場をシミュレーションし、敵の行動をモデル化していると研究チームは指摘しています。

◆ディープフェイクの取り組み

情報戦における中国人民解放軍の野心は従来のサイバー防衛の枠組みを超え、複数の調達要請文書でディープフェイク技術を明示的に要求しているとのこと。中国人民解放軍はAIによって生成された画像・動画・音声を、世論形成や敵対勢力の状況認識、紛争における意思決定を操作するための効果的なツールと見なしています。また、国際ニュースの追跡や他国民の政治的見解の特定、社会不安の予測、敵対者の認識操作を目的としたアルゴリズムも開発しているそうです。

◆画期的なブレイクスルーを待たない迅速な実験サイクル

中国人民解放軍のAI活用に関する取り組みについて、研究チームは「中国はAIのブレイクスルーを待ってはいません。現在利用可能な技術で実験を行い、時間の経過とともに漸進的な進歩が積み重なることを期待しているのです。私たちが検証した文書の多くは開発期間が短いことを特徴としており、これによって用途や領域を横断した実験を迅速かつ比較的低コストで行うことができます」と指摘しています。

加えて中国政府は、国内のテクノロジー企業が製品を防衛用途に転用することを推奨するため、補助金や税制優遇措置などを提供しています。これにより、民生のテクノロジー部門と先進産業の能力を軍事目的で活用できるとのこと。

また、研究チームは中国人民解放軍によるAI導入構想の多くが、アメリカ国防総省のAIドローンプログラムであるレプリケーター構想や、領域や国境を越えたセンサー・システム・意思決定ツール統合を推進する統合全領域指揮統制(CJADC2)構想などを模倣したものだと指摘。これにより、アメリカと中国のいずれかが一時的に技術的優位性を獲得しても、すぐに追いつかれる可能性があります。

◆過剰な自動化によるリスク

アメリカは依然として経験豊富な人間による判断を求めていますが、中国人民解放軍は経験不足な将校の代わりにAIの意思決定システムに頼るようになるかもしれません。その結果、軍事的・外交的シグナルの誤読や戦場での誤った判断につながる可能性があるとのこと。中国人民解放軍は戦闘経験が限られており、軍事プラットフォームの機密画像やレーダー兵器の電波的特性など、軍事目的のAIトレーニングに必要なデータセットの多くを欠いていることも指摘されています。

別のリスクとしては、一部のAI搭載の意思決定システムは公開データに依存しているため、敵の軍隊が情報環境を意図的に操作する可能性も考えられます。たとえば、ソーシャルメディアに偽のシグナルを大量に流したり、商用衛星画像プロバイダーを妨害したりすることでAIツールが欺かれ、意図しない事態や間違った判断につながる危険性もあります。

◆アメリカ政府のAI利用における問題

アメリカは依然としてコンピューティング能力や技術的才能、作戦経験などで優位に立っていると研究チームは指摘。その一方で、AI開発企業のAnthropicとの関係を断絶し、「国家安全保障に対するサプライチェーンリスク」に指定するよう求めるなど、国内での対立が生じていることを懸念しています。

研究チームは、「中国人民解放軍による実験の多くは驚くべきものではありません。しかし、特に複雑なAI意思決定支援システムや認知戦ツールといった応用例は、誤算や不安定化のリスクを高めています。中国が新興テクノロジーを採用して軍隊の近代化を推進し続ける中で、アメリカも優位性を維持するためにAIの迅速な反復的開発、責任ある実験、賢明な商業パートナーシップに取り組むべきです」と結論付けました。

・関連記事

アメリカが「中国人民解放軍の支援企業リスト」にAlibaba・Baidu・BYDを追加するも即削除 - GIGAZINE

Tencentが中国軍との関係が疑われる企業のブラックリストに追加され株価7%超の下落、企業の評判悪化のほか財務省による制裁の圧力にさらされる可能性も - GIGAZINE

中国軍の研究者がMetaのAIをベースに軍事利用を想定したAIモデルを開発中との報道 - GIGAZINE

AI企業「DeepSeek」がオープンソースの範囲を超えてユーザーデータを中国政府に提供し軍事・諜報活動を支援しているとアメリカ政府高官が発表 - GIGAZINE

中国共産党は中国製高性能AIを支配体制の脅威と認識し検閲を実施している - GIGAZINE

アメリカ海軍が中国企業DeepSeekの開発したAIの使用を全面的に禁止 - GIGAZINE

OpenAIが国防総省とのAI利用契約について合意、Anthropicの交渉決裂直後に - GIGAZINE

Anthropicとアメリカ国防総省の交渉決裂の内幕、最後まで国防総省はAnthropicのAIを用いてアメリカ市民に関する大量データを分析したいと考えていた - GIGAZINE

アメリカ軍がイランへの先制攻撃にAI「Claude」を使用したとの報道、開発元のAnthropicとの関係断絶宣言の直後に - GIGAZINE

・関連コンテンツ

in AI, Posted by log1h_ik

You can read the machine translated English article The People's Liberation Army of Chin….