「感情認識AI」の危険性を専門家が警告、一体何が問題なのか?

リモートワークやリモート授業が浸透するにつれ、労働者や生徒をデバイス越しに監視するソフトウェアの需要が増加しています。中にはリモートで通信する相手の表情から感情を読み取る「AIを使ったソフトウェア・サービス」も存在しますが、これらの技術は科学的な実証がされておらず、誤用が懸念されると、人工知能(AI)の社会的影響を研究するケイト・クロフォード氏が論じています。

Time to regulate AI that interprets human emotions

https://www.nature.com/articles/d41586-021-00868-5

新型コロナウイルス感染症(COVID-19)の影響で都市封鎖が行われ、リモート勤務やリモート学習が推奨されるようになりました。クロフォード氏によると、「これまで対面で行われていたコミュニケーションが遠隔で行われることで、感情が伝わりづらくなった」という問題を解決するため、多くの企業や組織が「画面の向こう側にいる相手の感情を読み取るAI」の導入を行っているとのこと。

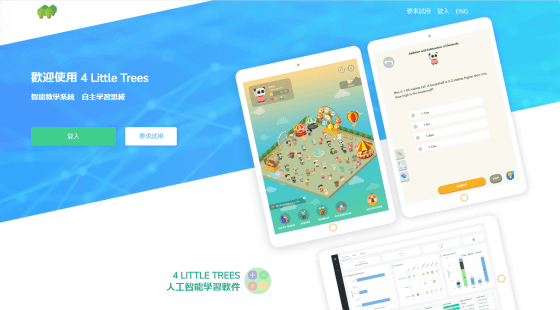

たとえば、香港を拠点とする「4 Little Trees」というサービスは、リモート授業で子どもたちの感情を読み取ると主張しています。4 Little Treesはカメラを通して生徒の顔の特徴を読み取り、感情を「幸福」「怒り」「嫌悪」「驚き」「恐れ」といったカテゴリに分類するほか、モチベーションの測定や成績の予測を行います。また、リモートワーカー向けの同様のツールも多数存在し、2026年までに「感情認識産業」は370億ドル(約4兆円)規模にまで成長すると考えられています。

しかし、このようなサービスの根底にある「AIによる感情の認識技術」は、その精度にまだ疑問が残っています。2019年に発表された研究では、顔認識技術について「Tech companies may well be asking a question that is fundamentally wrong(テクノロジー企業は根本的に間違った問いかけを行っている可能性がある)」と記されました。人の顔は同じ表情でも文脈によって感情の意味が異なるものであり、文脈を無視して顔の動きだけで感情を読み取ることは、誤解を招きかねないためです。

人の見た目から能力や精神状態に対する誤った推測を行うことをクロフォード氏は「Phrenological Impulse(骨相学的衝動)」と呼んでいます。感情認識テクノロジーの誤用に対する懸念は近年高まっており、骨相学的衝動に対しても規制が求められているとのことです。

「世界各国には、『体』を治療する医薬品の開発において科学的な厳密さを強制する規制が存在します。人の『心』について主張するツールにも、同様の規制が与えられるべきです」とクロフォード氏。顔認識技術は犯罪捜査で使われていたものの、個人の自由と権利を侵害する恐れがあるとして近年は使用が禁止される傾向にあります。またIBMは「テクノロジーが差別と不平等を助長する」として2020年に市場撤退を発表しました。研究者たちは顔認識技術に対する規制を当局に求めており、同様のことが感情認識技術にも言えるというのがクロフォード氏の主張です。

歴史的にみれば、同様の道筋をたどったものに「うそ発見器」があります。うそ発見器は1920年代に発明され、連邦法によって禁じられるまでの間、アメリカ軍とFBIによって何十年も使用され続けました。この間、うそ発見器によって多くの人が間違った判断をされることになりました。

うそ発見器は実際どれくらいうそを見抜けるのか? - GIGAZINE

「感情は普遍的な表情によって裏付けられる」という発想は、心理学者であるポール・エクマン氏の研究に端を発します。エクマン氏は人里離れて暮らすパプアニューギニアの部族を研究することで、異文化であっても人の持つ「幸福」「怒り」「嫌悪」「恐れ」「悲しみ」「驚き」という6つの感情は普遍的だと結論付けました。

文化人類学者のマーガレット・ミード氏は、「エクマン氏の主張は文脈や文化、社会的要因を軽視している」と指摘しましたが、AIによる感情認識技術の多くは、エクマン氏の主張を基礎として作られているとのこと。ミード氏の指摘したより複雑かつ多様な要素を省き、人の感情を6つに分けることで、システムを標準化させて大規模な自動化を行うことが可能になるためです。一方、エクマン氏はアメリカ同時多発テロ事件が起こった際に、飛行機内の映像から乗客の感情を読み取りテロリストを推定するというシステムを運輸保安庁に販売しましたが、同システムは信頼性の欠如と人種的偏見で強く批判されています。

感情認識AIが広く売り出されつつある状況から、科学的に効果が立証されていないツールが教育・ヘルスケア・雇用・犯罪捜査で使われることを防ぐべく、法規制を行うべきタイミングがやってきたとクロフォード氏は主張しています。

・関連記事

人工知能は核兵器よりも潜在的に危険、ホーキング博士が「100年以内に人工知能は人間を超える」と警告 - GIGAZINE

イーロン・マスクの「AI脅威論」はマーケティング戦略だという指摘 - GIGAZINE

AIの専門家が「今からAIの暴走を心配するのは早すぎ」との楽観論に徹底反論 - GIGAZINE

なぜAIは人間の脅威となり得るのか? - GIGAZINE

AIが「私は人類を絶滅させるつもりはない」とAI脅威論を否定 - GIGAZINE

「AI」と「機械学習」は何がどのように違うのか?をわかりやすく解説するとこうなる - GIGAZINE

・関連コンテンツ

in メモ, Posted by darkhorse_log

You can read the machine translated English article Experts warn of the danger of 'emotion r….