倫理に反する人工知能(AI)の開発は止められるべきなのか?

人工知能(AI)は人間が持つ偏見や差別を受け継ぐため、近年は倫理的側面からAIの危険性に懸念が持たれています。歴史的にコンピューターサイエンス分野の研究では倫理的な議論が持たれてこなかったそうですが、状況が大きく変わりつつあると、科学界の変容についてサイエンス系ライターのマシュー・ハンソン氏がまとめています。

Who Should Stop Unethical A.I.? | The New Yorker

https://www.newyorker.com/tech/annals-of-technology/who-should-stop-unethical-ai

ハンソン氏によると、コンピューターサイエンスの査読付き論文が発表される主たる機会はジャーナルではなくカンファレンスであり、これは他の学術研究とは異なる点とのこと。

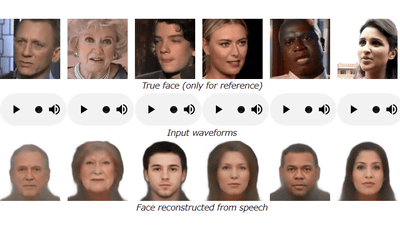

2019年のあるカンファレスでハンソン氏は、声から話者の顔画像を生成するAI「Speech2Face」のポスターを目にしました。Speech2Faceが予測する「顔」は性別・年齢・民族といった特徴が一致する程度のもので、「特に印象的な技術というわけではなかった」そうですが、後にSpeech2Faceは大きな議論を巻き起こします。

「声」から話者の顔画像を生成するAIが開発される - GIGAZINE

社会学者のアレックス・ハンナ氏はTwitter上で、Speech2Faceは生物学的特性とアイデンティティを結び付けるという点に問題があると指摘し、「トランスフォビア」なアイデアだと述べました。一方で、他のユーザーからは、この技術が犯罪捜査に役立つ可能性も示唆されました。

このような「AIと倫理」の問題は近年注目されており、実際にコンピューターサイエンスの論文が倫理の問題に直面することは増えているとのこと。「倫理的なアルゴリズム」の著者であるマイケル・カーン氏はAIをとりまくこのような状況について、「私たちはマンハッタン計画の目前にいる」と述べています。

AIと倫理に関する議論の中で、コンピューターサイエンス分野の論文公開プロセスにおける倫理委員会(IRB)の関わり方についても言及があったとのこと。生物学・心理学・人類学など、人間を対象とする研究の多くは研究を進めるプロセスにIRBによる精査が含まれるますが、コンピューターサイエンスの研究には人間の被験者が関与しないとして、慣例的にIRBが設置されることはほとんどありませんでした。この点がAI研究に倫理的観点が欠ける原因であると指摘されたのです。

また、コンピューターサイエンスの研究は純粋に学術的ではなく、企業や組織が技術を利用することが前提になっているという点や、AI技術の影響は広範である一方でアメリカ保険福祉省はIRBに対して「研究のもたらす長期的な影響は評価すべきでない」と明示していることも、問題に関わっています

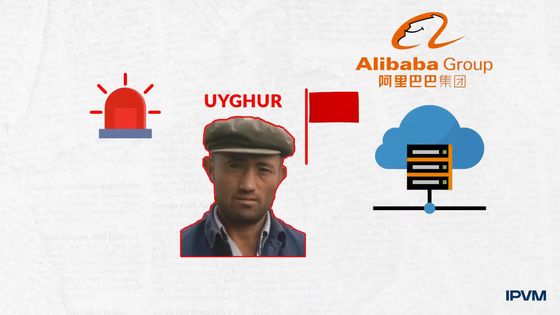

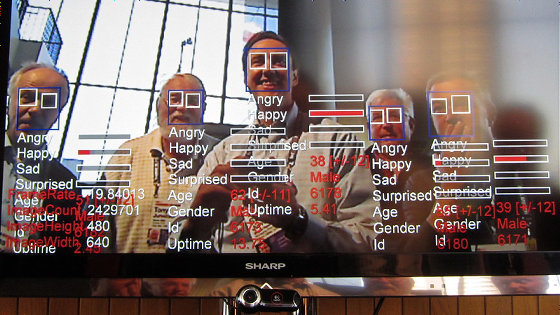

たとえば、中国ではウイグル人を識別する顔認識クラウドサービスが提供されていると報じられています。顔認識を行うAI自体は問題があるものではありませんが、技術が民族迫害に利用されています。

アリババが「ウイグル人を識別する顔認識クラウドサービス」を提供していたとの指摘 - GIGAZINE

また、警察が犯罪捜査で顔認識技術を取り入れた結果、特に黒人の誤認逮捕が多いと問題となりました。これも技術が開発された時点では問題がなかったにも関わらず、実際には差別を助長する結果となった例といえます。

顔認識技術のせいで無実なのに間違って逮捕された男性 - GIGAZINE

このため学術的な研究プロセスを倫理面から改善することが求められる状況ではありますが、一方で学術分野でのシステムを改善するだけでは、その技術がもたらす社会的悪影響を抑えきることはできないという指摘もあります。

他方、IRBの関与がAI研究に直接的な影響を与えると考える研究者もいます。たとえば研究の倫理的側面を考慮すると、アルゴリズムが写真の公開データベースを使用して学習を行う場合、研究を行う前に被写体に同意を求める必要が出てくる可能性があります。多くの研究者は「研究に人間の被験者が関与していない」ことを前提にしていますが、「人間の関与」が認められる事になった場合、技術を開発するための研究自体がこれまでと大きく違うプロセスをたどることになります。

これまでのところ、規制当局の技術への理解が追いついていないという理由から、民間企業の用いるAIが監査の対象となることはほとんどありません。このためAI研究のほとんどは自主規制に依存しており、いくつかの会議では新しい規範が作られようとしているとのこと。計算言語学会は査読者に対し研究の倫理的な影響を検討するよう求めており、AI分野の有力な国際学会であるNeurIPSも提出論文に「研究の与える幅広い潜在的インパクト」をポジティブ・ネガティブの両側面から議論するよう求めています。

AIのトップ学会NeurIPSは論文の著者に「理論が社会に与える影響」についての記述を要求 - GIGAZINE

NeurIPSの要求は研究者の間で話題となり、実際に軍事的な利用が予測される技術の研究者は、研究を完全に断念するに至りました。一方で、実際に論文のレビューしたイアソン・ガブリエル氏は、研究の影響を論じた内容は良好なものであったとも述べています。多くの研究者が、個人的に持っていた「道徳的危機」を公に議論できるようになったことに安心感を抱いているという印象があるそうです。

歴史的に、科学の規制や自主規制は悲劇が起こった後に作られてきました。IRB設置への道を開いた国家研究法は、黒人を被験者とした梅毒の臨床試験「タスキギー梅毒実験」をきっかけに作られたものであり、インフルエンザウイルスなどの威力を高める研究はアメリカ政府からの資金提供を一時停止されました。AIに関してはまだ大きな悲劇が起こっていませんが、だからこそ急速に進化する分野の多様な研究において、大きな事件が起こらないよう、現在進行形で規則や規範が作られようとしている状況となっています。

・関連記事

Googleが倫理的AIチームの研究者を解雇したことは「前例ない検閲」だとして非難集中、Google社員1200人以上が抗議文に署名 - GIGAZINE

AIを人類にとって有益なものとして扱うために必要なこととは? - GIGAZINE

人工知能は核兵器よりも潜在的に危険、ホーキング博士が「100年以内に人工知能は人間を超える」と警告 - GIGAZINE

なぜAIは人間の脅威となり得るのか? - GIGAZINE

「シリコンバレーが世の終末を引き起こす」ことを「楽観主義者」のビル・ゲイツさえ危惧している - GIGAZINE

・関連コンテンツ

in サイエンス, Posted by darkhorse_log

You can read the machine translated English article Should the development of unethical arti….