Inceptionが世界最速の拡散モデルベース推論LLM「Mercury 2」を発表

次世代の大規模言語モデル(LLM)を開発するAI企業のInceptionが、拡散モデルに基づく世界最速の推論LLMである「Mercury 2」を発表しました。

Introducing Mercury 2 – Inception

https://www.inceptionlabs.ai/blog/introducing-mercury-2

AIは単一のプロンプトに対して単一の回答を返すという単純なものではなく、エージェント・検索パイプライン・抽出ジョブがバックグラウンドで大量に実行される複雑なループのようなものです。このループではレイテンシ(遅延)が一度きりではなく、全てのステップ、全てのユーザー、全ての再試行にわたって累積的に発生します。

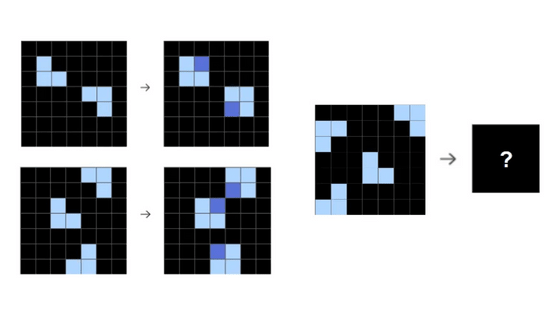

しかし、既存のLLMは依然として「自己回帰型のシーケンシャルデコードを行う」というボトルネックを抱えています。つまり、一度に1トークンずつしか処理できないという点がボトルネックになっていると、Inceptionは指摘しているわけです。

そこで開発されたのが「Mercury 2」です。Mercury 2は逐次的にデコードを行うのではなく、並列処理によって応答を生成することで、複数のトークンを同時に生成し、少数のステップで収束させることができます。端的に言えば、これにより従来のLLMよりもはるかに速く応答を生成できるようになります。なお、Mercury 2の応答生成速度は、既存のLLMの5倍以上高速だそうです。

Mercury 2の概要は以下の通り。

速度:NVIDIA Blackwell GPUで1秒当たり1009トークンを生成可能

価格:0.25ドル(約39円)で100万入力トークン、0.75ドル(約117円)で100万出力トークンの処理が可能

品質:主要な速度最適化モデルと競合可能

機能:調整可能な推論、コンテキスト長12万8000トークン、ネイティブツールの使用、スキーマに準拠したJSON出力

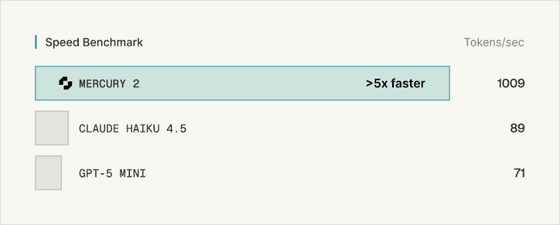

Mercury 2、Anthropicの軽量コスト重視のAIであるClaude Haiku 4.5、OpenAIの軽量で安価なLLMであるGPT-5 miniの、1秒間に生成できるトークン数を比較した図が以下。Mercury 2は1秒で1009トークンを生成可能で、Claude Haiku 4.5やGPT-5 miniと比べると5倍以上のトークンを生成できます。

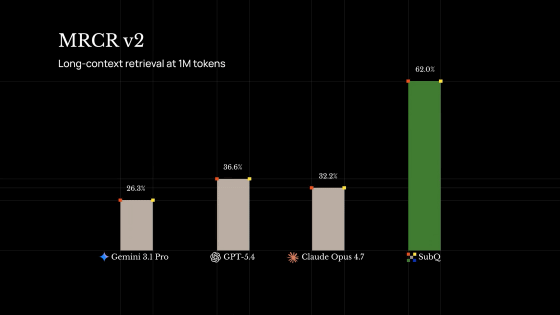

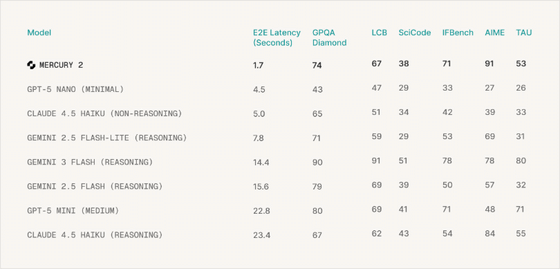

Mercury 2、GPT-5 nano(最小)、Claude Haiku 4.5(推論なし)、Gemini 2.5 Flash-Lite(推論あり)、Gemini 3 Flash(推論あり)、Gemini 2.5 Flash(推論あり)、GPT-5 mini(中間)、Claude Haiku 4.5(推論あり)という複数のLLMでベンチマークテストを実行した結果を示したのが以下の図です。

「E2E Latency」(入力から最終的な出力が返ってくるまでの遅延時間)は、Mercury 2が最も短いです。推論能力を評価するベンチマークの「GPQA Diamond」や、コーディング能力を測るベンチマークの「LCB(LiveCodeBench)」、LLM向けのコーディング能力評価ベンチマークである「TAU」では中程度のスコアを記録。

科学計算・研究レベルのコーディング能力を測るベンチマークの「SciCode」や、指示追従能力を測るベンチマークの「IFBench(Instruction Following Benchmark)」、AIMEの過去問を使った数学的推論能力を評価するベンチマークの「AIME」ではトップクラスのハイスコアを記録しています。

なお、Mercury 2は記事作成時点で入手可能となっており、以下のページから早期アクセスをリクエストすることが可能。

Early Access – Inception

https://www.inceptionlabs.ai/early-access

また、Mercury 2をチャットAIとして利用できるデモ版も公開されています。

Inception Chat

https://chat.inceptionlabs.ai/

・関連記事

GoogleがGemini 3 Flashをリリース、Gemini 3 Pro級の高度な推論能力を維持しながらより高速で価格は約4分の1 - GIGAZINE

Anthropicが軽量コスト重視の「Claude Haiku 4.5」を発表、Claude Sonnet 4と同等のパフォーマンスを3分の1のコストと2倍以上の速度で実現 - GIGAZINE

OpenAIが「GPT-5」を発表、通常モデルと推論モデルを統合した新モデルはChatGPTの無料プランを含めた全ユーザーが利用可能に - GIGAZINE

GoogleがGemini 2.5 Pro/Flashを一般公開&安価かつ最速の「Gemini 2.5 Flash-Lite」プレビュー版を新たにリリース - GIGAZINE

・関連コンテンツ

in AI, Posted by logu_ii

You can read the machine translated English article Inception Announces Mercury 2, the World….