MetaがAIモデル「Llama 3.3」をリリース、70BモデルでLlama 3.1の405Bモデルに匹敵する性能を発揮

Metaが大規模言語モデル「Llama 3.3」を2024年12月6日(土)にリリースしました。記事作成時点ではパラメーター数70Bのモデルがリリースされており、Amazonの基盤モデル「Amazon Nova Pro」と比べて低コストかつ高性能であることや、旧世代の上位モデルに匹敵する性能を備えていることがアピールされています。

Llama

https://www.llama.com/

llama-models/models/llama3_3/MODEL_CARD.md at main · meta-llama/llama-models · GitHub

https://github.com/meta-llama/llama-models/blob/main/models/llama3_3/MODEL_CARD.md

As we continue to explore new post-training techniques, today we're releasing Llama 3.3 — a new open source model that delivers leading performance and quality across text-based use cases such as synthetic data generation at a fraction of the inference cost. pic.twitter.com/BNoV2czGKL

— AI at Meta (@AIatMeta) December 6, 2024

Llama 3.3 70Bは2023年12月までに収集された15兆以上のトークンでトレーニングされています。コンテキスト長は12万8000で対応言語は英語、ドイツ語、フランス語、イタリア語、ポルトガル語、ヒンディー語、スペイン語、タイ語です。

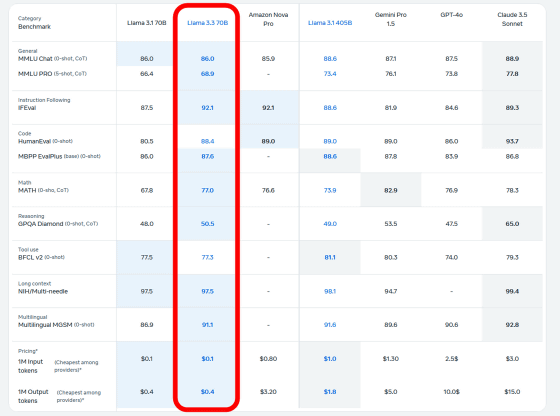

Llama 3.3 70Bと各種AIモデルのベンチマーク結果を並べた表が以下。Llama 3.3 70BはほとんどのテストでLlama 3.1 70Bの性能を上回っているほか、全体的な性能を評価する「MMLU」や数学関連の性能を評価する「MATH」ではAmazon Nova Proのスコアを上回っています。また、コーディング性能や数学性能などの一部のベンチマークでは旧世代上位モデルであるLlama 3.1 405Bを超えるスコアを記録しています。

MetaはLlama 3.3 70Bについて「コスト効率の高い推論により、一般的な開発者向けワークステーションでローカル実行可能でありながらLlama 3.1 405Bと同様のパフォーマンスを実現している」とアピールしています。

Improvements in Llama 3.3 were driven by a new alignment process and progress in online RL techniques. This model delivers similar performance to Llama 3.1 405B with cost effective inference that’s feasible to run locally on common developer workstations.

— AI at Meta (@AIatMeta) December 6, 2024

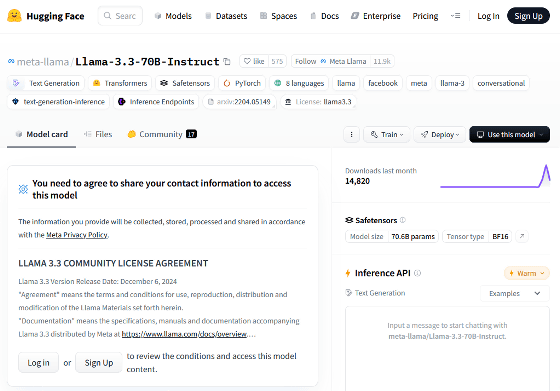

Llama 3.3 70BはMetaの公式サイトで入手可能なほか、Hugging Faceでも配布されています。なお、ライセンスは「Llama 3.3 Community License」が適用されており、月間アクティブユーザー数が7億人未満の場合は商用利用可能です。

meta-llama/Llama-3.3-70B-Instruct · Hugging Face

https://huggingface.co/meta-llama/Llama-3.3-70B-Instruct

・関連記事

Metaは10万台以上のNVIDIA H100を使用してLlama-4をトレーニングしている - GIGAZINE

AmazonがAWS上で利用可能なマルチモーダル生成AIモデル「Amazon Nova」を発表 - GIGAZINE

Googleがファインチューニングしやすいビジュアル言語モデル「PaliGemma 2」をリリース - GIGAZINE

Mistral AIが124BサイズのマルチモーダルAIモデル「Pixtral Large」リリース、GPT-4oやGemini-1.5 Proなどを上回るパフォーマンス - GIGAZINE

NVIDIA製グラボやAppleチップのAI推論処理能力をまとめた一覧表、どのグラボやMacを買えばいいのかの参考になる - GIGAZINE

・関連コンテンツ

in AI, ソフトウェア, Posted by log1o_hf

You can read the machine translated English article Meta releases AI model 'Llama 3.3', 70B ….