生成AIに使われる拡散処理を超爆速わずか2ステップで完了できるアプローチ「sCM」をOpenAIが発表

画像生成AI「Stable Diffusion」などの生成AIモデルは「拡散モデル」と呼ばれるアプローチを採用しています。この拡散モデルに代わる、拡散処理を単純化して高速化するアプローチ「sCM」をOpenAIが考案しました。通常であれば数十から数百のサンプリングステップがかかるところ、sCMだとわずか2ステップで済むとのことです。

[2410.11081] Simplifying, Stabilizing and Scaling Continuous-Time Consistency Models

https://arxiv.org/abs/2410.11081

Simplifying, stabilizing, and scaling continuous-time consistency models | OpenAI

https://openai.com/index/simplifying-stabilizing-and-scaling-continuous-time-consistency-models/

拡散モデルはデータへのノイズ付与とノイズ除去を繰り返して学習するモデルで、この際のノイズ除去回数がサンプリングステップと呼ばれます。一般的に、サンプリングステップを適度に増やすと生成結果の品質が向上しますが、同時に処理時間も長くなってしまいます。このため、AI研究者は「サンプリングステップを少なくしても生成結果を高品質に保つ技術」の開発を進めていますが、OpenAIは「既存のアプローチは高い計算コストや複雑なトレーニング、サンプルの質の低下などの制約を伴うことが多い」と指摘しています。

OpenAIは、従来の拡散モデルに代わる高速な代替手段として知られる一貫性モデル(Consistency Models)の先行研究を発展させ、単純化と安定性の向上を図りました。これにより、多数のノイズ除去ステップを経て徐々にサンプルを生成する拡散モデルとは異なり、ノイズを直接ノイズのないサンプルに変換することを1つのステップで目指す一貫性モデルの新たなアプローチ「sCM」が完成したとのことです。

sCMでは、512×512解像度のImageNetにおいて、連続時間一貫性モデルの学習を15億パラメータまで拡張することが可能になっています。例えば、15億のパラメータを持つsCMの最大モデルは、推論最適化なしの条件において、1つのNVIDIA A100 GPUでわずか0.11秒で1つのサンプルを生成するとのこと。システムを最適化することでさらなる高速化が容易に実現できるため、画像、音声、動画など、さまざまな領域でのリアルタイム生成の可能性が広がるとOpenAIは説明しています。

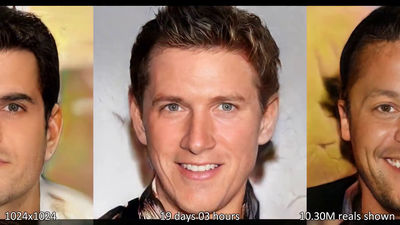

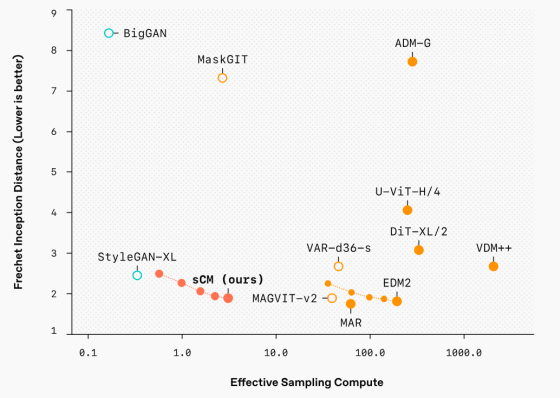

実際の画像と生成された画像を比較し、生成AIによって作成された画像の品質を評価する「Fréchet inception distance」では、有効サンプリング計算量の10%未満しか使用しないまま、従来の方法に匹敵する品質のサンプルを生成していることが示されたといいます。

2ステップで生成された画像のサンプルは以下の通り。

OpenAIは「私たちは、推論速度とサンプルの質の両方を改善した、より優れた生成モデルの開発に向けて努力を続けます。これらの進歩が、幅広い領域におけるリアルタイムで高品質な生成AIの新たな可能性を開くと信じています」と述べました。

・関連記事

Metaの基礎AI研究チームが複数の研究を発表、AIモデルやデータセットなど複数の成果を共有 - GIGAZINE

AIによる画像生成を30倍高速化する手法をマサチューセッツ工科大学が開発 - GIGAZINE

機械学習モデルの再学習でLoRAよりもより少ない計算コストと時間でより高いパフォーマンスを期待できる「DoRA」 - GIGAZINE

・関連コンテンツ

in AI, ソフトウェア, Posted by log1p_kr

You can read the machine translated English article OpenAI announces 'sCM', an approach that….