容疑者の似顔絵を警察の代わりに生成するAIが登場、専門家は捜査への悪影響を懸念

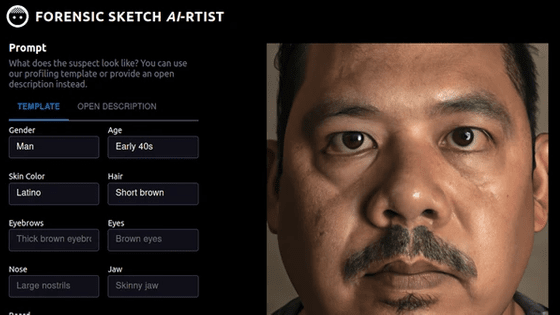

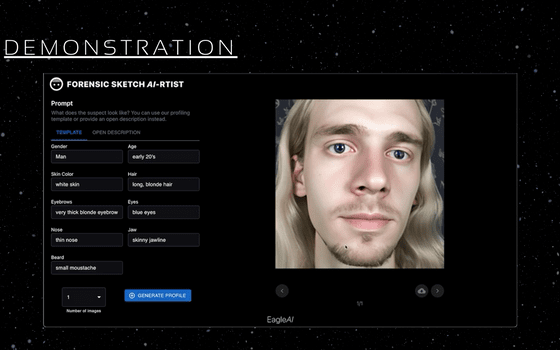

2人の開発者がOpenAIの画像生成モデル「DALL・E2」を使い、ユーザーの入力に基づいて容疑者の超リアルな似顔絵を作成するプログラムを作成しました。開発者は通常2~3時間かかるスケッチの時間を短縮できるとしましたが、専門家はリアルであることがむしろ捜査の妨げになる可能性を指摘しました。

Forensic Sketch AIrtist

https://lablab.ai/event/openai-whisper-gpt3-codex-dalle2-hackathon/eagleai/forensic-sketch-airtist

Developers Created AI to Generate Police Sketches. Experts Are Horrified

https://www.vice.com/en/article/qjk745/ai-police-sketches

アーサー・フォルトゥナート氏とフィリペ・レイノー氏が開発した「Forensic Sketch AI-rtist」と呼ばれるこのプログラムは、年齢や性別、肌の色、髪型といったテンプレートに沿って入力された情報をDALL・E2に送り、DALL・E2が生成した画像を表示するというものです。目撃者からの証言を元に容疑者の似顔絵を作成するという捜査方法を警察が採用する際に、スケッチの作成にかかる時間を短縮することが期待されています。

しかし、専門家は、あまりにもリアルすぎる似顔絵がかえって捜査に悪影響を及ぼしてしまう可能性があると指摘します。電子フロンティア財団のジェニファー・リンチ氏によると、人間は顔を特徴ごとに記憶するのではなく、顔全体を1つとして記憶しているとのこと。そのため、個々の特徴を基に似顔絵を作成するこのプログラムは容疑者の顔とは著しく異なる顔を生成してしまう可能性があるそうです。リンチ氏は「残念ながら、目撃者が似顔絵を見てしまうと、記憶の中のイメージが似顔絵で上書きされてしまうかもしれません」と述べました。

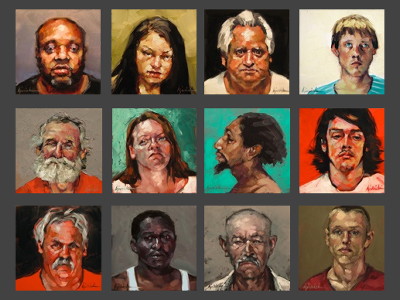

また、AIによる画像生成が人種や性別の偏見を助長してしまう可能性も指摘されています。自然言語処理に関するオープンソースライブラリ「Hugging Face」で研究員を務めるサシャ・ルチアーノ氏は「一般的に、インターネット上の有色人種の扱いは非常に人種差別的で不公平であり、そのバイアスがAIに使用されるデータセットにも反映されています。テクノロジーによって疎外されるのは今現在疎外されたグループに他なりません」とコメントしています。

リンチは、「もし、これらのAIが生成した似顔絵が一般に公開されることがあれば、ステレオタイプや人種的偏見を助長し、実際の犯人ではなく、スケッチに似た人物に注意が向けられることになり、捜査を妨げる可能性があります」と指摘。実際、アメリカではDNA証拠によって覆されたえん罪の69%で「目撃者の証言を基に行った身元確認」が行われていたそうです。

なお、開発者のフォルトゥナート氏らも、生成された画像の正確さを測る指標がないことを認めています。フォルトゥナート氏らは「似顔絵に生じた矛盾点は随時修正されるべきであり、可能な限り最高の結果を得るために反復試行する必要があります。もしこのプログラムが使用される場合、警察は正確な似顔絵を共有することに責任を負わなければなりません」と述べました。

似顔絵の作成時間を短縮するというこのプログラムに対し、リンチ氏は「似顔絵作成の問題点は時間がかかることではなく、人間の記憶や偏見という曖昧な情報を頼りにしていることにあります。AIはこの問題を解決できませんし、今回登場したプログラムは問題を悪化させる可能性が高いでしょう」と論じました。

・関連記事

人工知能に偏見を抱かせないようにするための方法とは? - GIGAZINE

あまりにもリアルなAI製の「架空の人物の顔」はどこで見分ければいいのか? - GIGAZINE

ホワイトハウスがAIによる害や差別から市民を守り必要に応じたオプトアウトも認める「AI権利章典」を発表 - GIGAZINE

超高精度な文章生成AI「GPT-3」には反イスラム教的なバイアスが存在すると判明 - GIGAZINE

「差別をAIに植え付ける」としてMIT研究者らが大規模なデータセットをネットから完全削除 - GIGAZINE

・関連コンテンツ

in ソフトウェア, 創作, Posted by log1p_kr

You can read the machine translated English article AI that generates caricatures of suspect….