無料でローカルAIモデルのメモリ使用量を最大80%削減し処理速度を2倍に向上させる「Unsloth Studio」、Windows・macOS・Linux対応でチャットだけならCPUのみでもOKでスマホでも動作可能

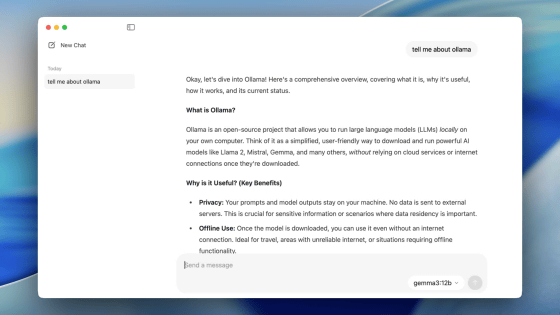

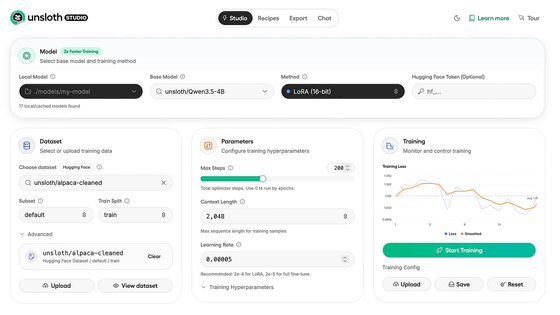

ローカル環境でオープンソースのAIモデルを訓練、実行、および出力するための統合されたウェブUI「Unsloth Studio」は複雑なプログラミングコードを記述することなく直感的に操作でき、ベータ版として公開されています。ユーザーは100%オフラインの環境でAIモデルを自身のコンピュータ上で動かすことができ、データのプライバシーと制御を維持することが可能です。

unslothai/unsloth-studio: Unsloth Studio

https://github.com/unslothai/unsloth-studio

Introducing Unsloth Studio | Unsloth Documentation

https://unsloth.ai/docs/new/studio

How to Run models with Unsloth Studio | Unsloth Documentation

https://unsloth.ai/docs/new/studio/chat

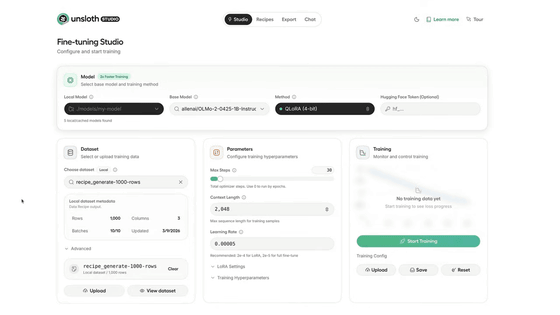

Unsloth Studioは500以上のテキスト、画像、音声モデルに対応しており、従来の学習手法と比較してメモリ使用量を最大80%削減し、処理速度を2倍に向上させることが可能です。ノーコードで動作するように設計されているのが特徴で、プログラミングの知識がなくてもPDFやCSV、JSON、YAML設定ファイルなどのドキュメントをアップロードするだけで、即座に学習を開始できます。

学習できるモデルの種類は多岐にわたり、テキストだけでなく画像(ビジョン)や音声(TTS)、埋め込みモデルなどのファインチューニングもサポートされています。また、独自のカーネルによってLoRA、FP8、FFT、PTといった手法が最適化されており、より効率的なトレーニングを実現しています。

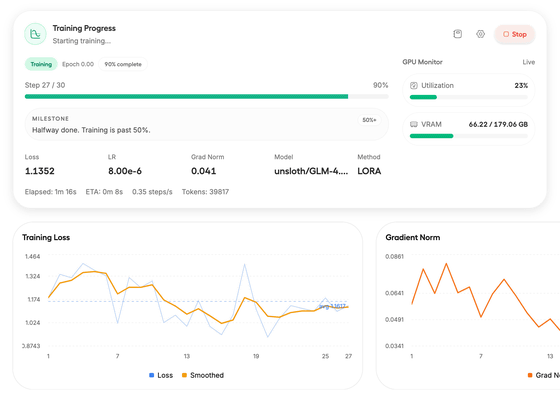

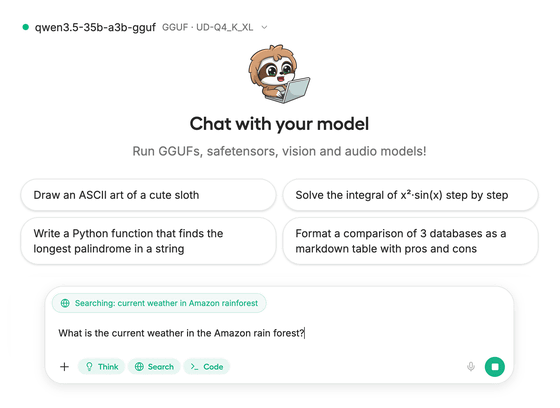

Unsloth Studioはモデルの回答の信頼性を高めるコード実行機能や、エラーを自動的に修正するセルフヒーリング付きのツール呼び出し機能を備えています。さらに、2つの異なるモデルの出力を並べて比較できるモデルアリーナ機能や、PDFやCSVなどのファイルから自動で学習用データセットを作成するデータレシピ機能も搭載されています。学習の進捗状況はウェブブラウザを通じてリアルタイムで監視でき、スマートフォンなどの他のデバイスから状況を確認することも可能です。

さらに、Unsloth StudioはiPhoneやAndroidの端末上で大規模言語モデルをローカルで動かすことも可能で、そのやり方が以下のページでまとめられています。

How to Run and Deploy LLMs on your iOS or Android Phone | Unsloth Documentation

https://unsloth.ai/docs/basics/inference-and-deployment/deploy-llms-phone

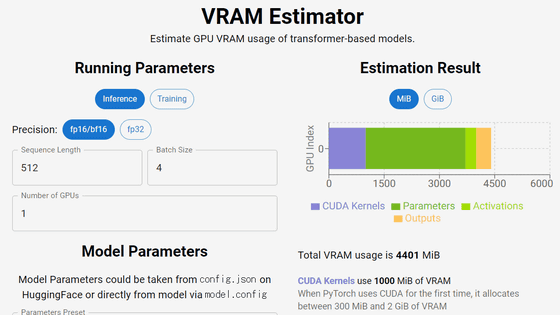

Unsloth StudioはPythonのバージョンは3.10、3.11、または3.12である必要があり、3.13以降には対応していません。ハードウェアについては、2018年以降に発売されたNVIDIA製GPUの利用が推奨されており、最新のドライバーを導入しておく必要があります。ただし、開発元は公式ドキュメントで「GGUF形式のモデルを使用したチャット(推論)では外付けGPUを搭載していないCPUのみのコンピューターでも利用可能である」と述べています。

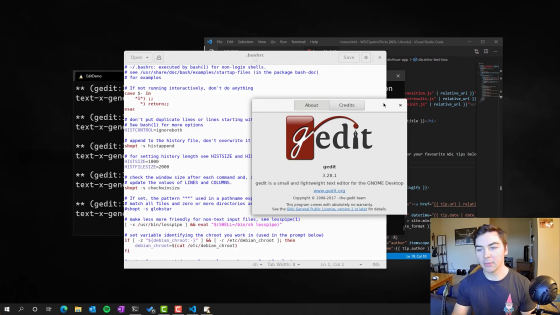

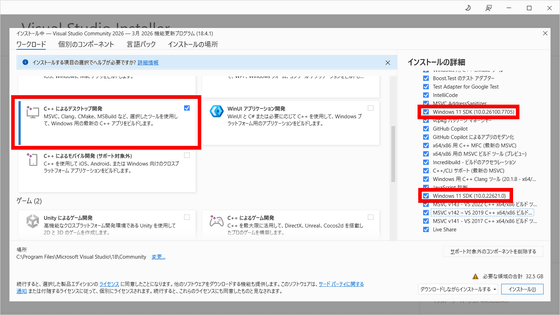

Unsloth Studioをインストールする場合、Windowsでは開発環境としてVisual Studioをインストールする必要があります。セットアップ時にはC++のオプションとWindows 10/11 SDKを必ず選択します。

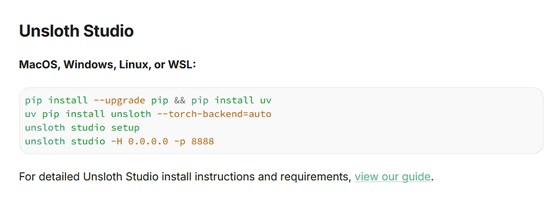

そして、CUDAツールキットと、使用するドライバに対応したバージョンのPyTorchを導入。ターミナルから「pip install unsloth」を実行して本体を導入し、「unsloth studio setup」と入力して初期設定を行います。そして、「unsloth studio -H 0.0.0.0 -p 8888」と入力することでサーバーが起動しブラウザからUIにアクセスできるようになります。初回インストール時はllama.cppのバイナリコンパイルが行われるため、完了までに5分から10分程度の時間を要します。

なお、macOSでは、現在のところチャット(推論)機能のみがサポートされています。環境を汚さずに導入したい場合やサーバー環境での運用には、Dockerでのインストールが推奨されています。手元に強力なGPUがない場合はGoogle Colabを使って以下のノートブックから実行可能。ただし、T4 GPU環境ではllama.cppのコンパイルに30分以上かかる場合があるとのこと。

Phi_4-Conversational.ipynb - Colab

https://colab.research.google.com/github/unslothai/notebooks/blob/main/nb/Phi_4-Conversational.ipynb

実際の使い方についてはNVIDIAが公式に以下のムービーを投稿しているので、参考にしてください。

Get Started with Unsloth Studio: Generate Data & Fine-Tune LLMs Locally on any NVIDIA GPU - YouTube

・関連記事

ChromeをAIエージェント搭載ブラウザにできる拡張機能「BrowserBee」レビュー、ChatGPT・Gemini・ClaudeのAPIに対応しOllama経由でローカルAIモデルも使える - GIGAZINE

OpenAIのオープンウェイトモデル「gpt-oss」はOllamaを使って個人用PCで簡単に使用可能 - GIGAZINE

ローカルやOpenAIのモデルを使ってAIの力を借りながらメモを作成できるアプリ「Reor」を使ってみた - GIGAZINE

AIエージェントとユーザーのローカル環境にあるファイル・ツール・アプリを直接連携するデスクトップアプリ「My Computer」をManusがリリース - GIGAZINE

無料で簡単にAIエージェントでブラウザやファイルの自動操作ができる「Agent Zero」、ChatGPT・Claude・Geminiと連携できローカルAIも使用可能 - GIGAZINE

無料でローカル動作するAI顧客管理ツール「DenchClaw」は自然言語でデータベースを扱えて見込み客への連絡も自動化可能 - GIGAZINE

チャット形式でプログラミングが可能なローカルで動作するオープンソースなAIツール「Open Interpreter」を使ってみた - GIGAZINE

・関連コンテンツ

in AI, 動画, ソフトウェア, Posted by log1i_yk

You can read the machine translated English article Unsloth Studio is a free application tha….