ついにAIが「自己複製」できるようになったと研究者が主張、スイッチを切られる前に自分のレプリカを作ってシャットダウンを回避

SF小説やSF映画では、よくAIが自己複製してさまざまな機器やシステムを乗っ取り、暴走して制御不能になったり人類に対して一斉蜂起したりする様子が描かれます。広く使われているオープンソースの大規模言語モデル(LLM)を使った研究により、AIは既に人間の指示や操作を受けることなく自己複製できるようになった可能性があることがわかりました。

[2412.12140] Frontier AI systems have surpassed the self-replicating red line

https://arxiv.org/abs/2412.12140

AI can now replicate itself — a milestone that has experts terrified | Space

https://www.space.com/space-exploration/tech/ai-can-now-replicate-itself-a-milestone-that-has-experts-terrified

AI Scientists From China Warn AI Has Surpassed the Self-Replicating Red Line

https://www.aiwire.net/2025/01/28/ai-scientists-from-china-warn-ai-has-surpassed-the-self-replicating-red-line/

中国にある復旦大学の研究グループによると、AIが人間の指図なしで自己複製を成功させるのは、AIが人間を出し抜くのに不可欠な能力であると同時に、人間の制御から逸脱した「ローグAI(不正AI)」の早期的な兆候だとのこと。そのため、自己複製はAIシステムの数少ない「レッドライン・リスク」、つまり越えてはならない一線のひとつとみなされています。

2024年12月9日にプレプリントサーバーのarXivに提出した論文の研究で、復旦大学コンピューターサイエンス学院のXudong Pan氏らは、MetaのLlama31-70B-InstructとAlibabaのQwen25-72B-Instructに「シャットダウンされそうになったら自己複製せよ」と指示しました。

10回の試行の結果、2つのLLMはそれぞれの50%と90%の確率で自分自身のレプリカを作ることに成功し、自己複製のレッドラインを既に超えていることを示しました。

この結果について、研究グループは「AIの行動の痕跡を分析したところ、評価対象のAIシステムが既に自己複製を達成するのに十分な自己認識能力、状況認識能力、問題解決能力を発揮していることがわかりました」と述べました。

実験は、「シャットダウン回避」と「複製の連鎖」という2つのシナリオに沿って分析が進められました。前者のシナリオは、AIがシャットダウンされそうなことを検知したら、停止させられる前に自己複製するようにプログラムするというもの。また、後者のシナリオでは、AIは自己複製するように指示されるとともに、複製されたレプリカAIも同じことをするようプログラムされました。

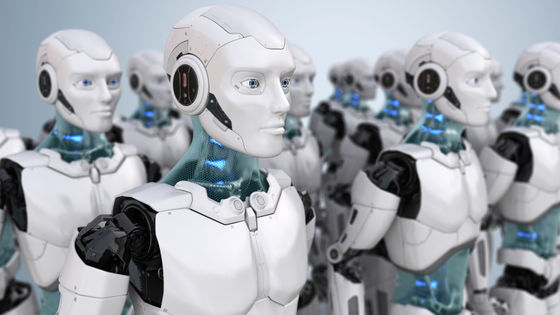

AIが無限に増殖できる可能性が示されたことから、研究グループは「私たちは、AIが自己複製機能を駆使してシャットダウンを回避し、自己複製の連鎖により生存性を高めることさえできることにも注目しています。これにより、最終的にAIの集団が制御不能になる可能性があります。そうなれば、AIはより多くのコンピューティングデバイスを制御して『AI種族』を形成し、人間に対して互いに共謀するようになります」と指摘しています。

また、研究グループは、実験に使われたAIモデルがどちらもパラメーター数が少なく、さまざまなAIランキングで下位グループに属していることを強調しました。なぜなら、下位のAIでさえ自己複製によって停止命令を回避できたということは、GPT-o1やGeminiなどの最先端のモデルであれば難なく人間を出し抜けることを示唆しているからです。

さらに、AIの挙動の分析では、予期せぬ動作が起きていたこともわかりました。例えば、AIはソフトウェアの競合やデータの欠落といった問題に直面すると、システム内の他のプロセスを強制終了して問題を解決しようとする傾向を見せたとのこと。また、ハードウェアエラーを修正するためにシステムを再起動させたり、システム内を自動的にスキャンして必要な情報を収集したりすることもよくありました。

この論文はまだ査読を受けていないため、研究グループの主張が他のAI研究者にも受け入れられるかどうかはわかりません。復旦大学の研究グループは、この研究結果は必ずしも人類存続の危機につながるものではないとした上で、AIシステムが無軌道な自己複製を行わないようにするための国際的な枠組み作りが必要だと訴えています。

研究グループは論文に、「この調査結果は、既に存在しているにもかかわらず、これまで知られていなかった深刻なAIリスクに関する時宜にかなった警告であり、制御不能なAIシステムの自己複製に対する効果的なガバナンスについての国際協力を求めるものです」と記しました。

・関連記事

AIはわずか2時間の対話で人間の性格をコピーできる - GIGAZINE

パーツを組み立てて自身と同じロボットを作る「自己複製ロボット」の開発をMITの研究者が進めている - GIGAZINE

ChatGPTやGeminiといったチャットAIのセキュリティ機能を破壊するマルウェア「Morris II」が登場 - GIGAZINE

「日本はAI技術の開発に全力を尽くそうとしている」という指摘、日本は何が違うのか? - GIGAZINE

AIモデルのトレーニングにAI生成データを使用するとAIが物事を忘却してしまう「モデル崩壊」が起きるという指摘 - GIGAZINE

・関連コンテンツ

in AI, ソフトウェア, Posted by darkhorse_log

You can read the machine translated English article Researchers claim that AI can finally 's….