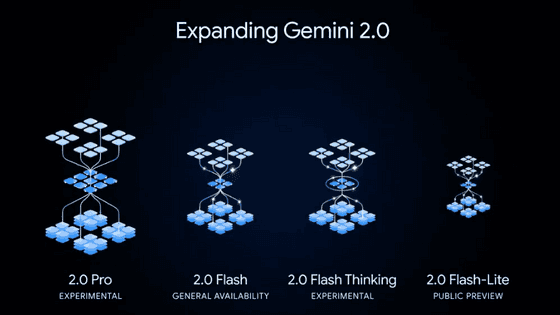

Googleが「Gemini 2.0」を発表、高速な軽量モデルで前世代上位モデルを圧倒的に上回る性能

Googleが、Geminiの次世代モデルファミリーとなる「Gemini 2.0」を発表すると同時に、全てのGeminiユーザーに対して応答速度を重視したモデル「Gemini 2.0 Flash」の実験版へのアクセスを解放しました。今後他のGoogle製品にもGemini 2.0を導入していく予定となっています。

Google introduces Gemini 2.0: A new AI model for the agentic era

https://blog.google/technology/google-deepmind/google-gemini-ai-update-december-2024/

Welcome to the world, Gemini 2.0 ✨ our most capable AI model yet.

— Google DeepMind (@GoogleDeepMind) 2024年12月11日

We're first releasing an experimental version of 2.0 Flash ⚡ It has better performance, new multimodal output, @Google tool use - and paves the way for new agentic experiences. 🧵 https://t.co/ywY2oZv76p pic.twitter.com/1Wgcr3m2Ip

Googleは2023年12月に文字・音声・画像を同時に処理することができるマルチモーダルAI「Gemini」を発表しました。

文字・音声・画像を同時に処理して人間以上に自然なやりとりができるGPT-4を超える性能のマルチモーダルAI「Gemini」がリリースされる - GIGAZINE

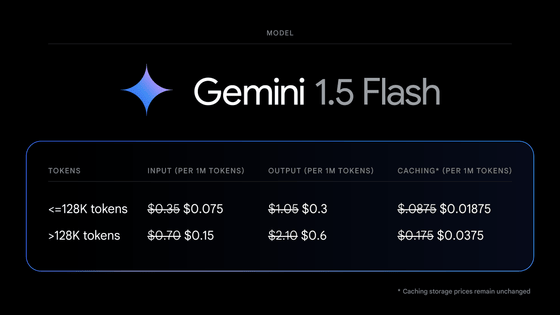

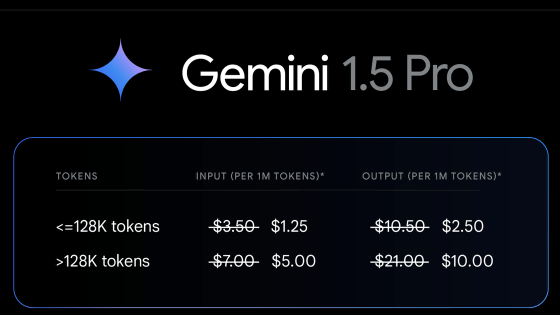

その後、2024年2月にGeminiの次世代モデルとなる「Gemini 1.5」も発表。Googleは他にも、Geminiの高速・軽量モデルである「Gemini Flash」や「Gemini 1.5 Flash-8B」といったモデルもリリースしています。

GoogleがGemini 1.5をリリース、最大100万トークンを処理できて1時間のムービーや70万語のテキストを扱うことが可能 - GIGAZINE

そんなGeminiの次世代モデルとなるGemini 2.0が2024年12月11日に発表されました。発表と同時にGemini 2.0モデルファミリーの最初のモデルとして、「Gemini 2.0 Flash」の実験モデルを全てのGeminiユーザーに開放するとのこと。

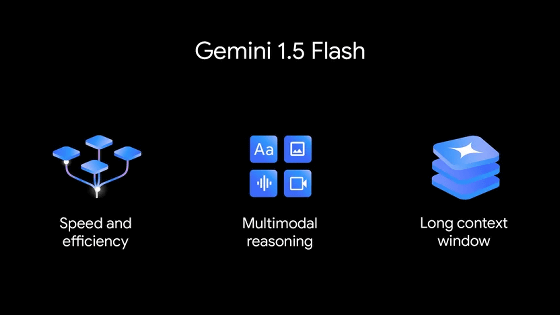

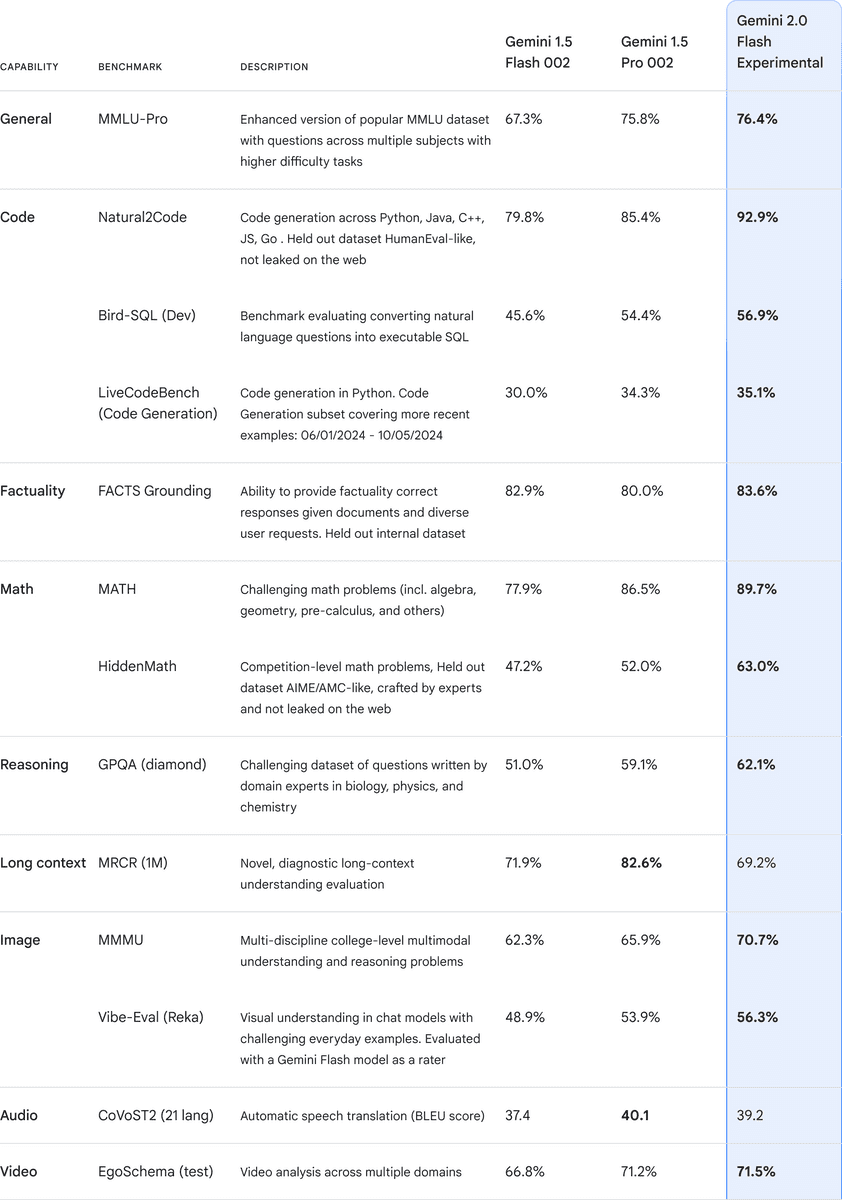

Flashモデルはモデルファミリーの中でも応答速度を重視したモデルで、Gemini 1.5モデルファミリーにおいてはGemini 1.5 Flashが最も開発者に好まれていました。Gemini 2.0 Flashは高速な応答速度を維持しつつ、ベンチマークにおいて、旧世代の重量級モデル「Gemini 1.5 Pro」を上回る結果を出しています。

また、Gemini 2.0 Flashでは新たに画像や動画、音声などのマルチモーダル入力をサポートしているほか、文字・画像・多言語音声などのマルチモーダル出力についてもサポートしたとのこと。Google検索やコードの実行、サードパーティのユーザー定義関数などのツールを呼び出す機能も用意されました。

実際に音声入力を使用してGemini 2.0 Flashと会話する様子は以下の通り。問いかけから1~2秒程度ですぐに応答が返ってきている様子が確かめられます。

Google Gemini 2.0 Flash Multimodal feature is next-level!

— AshutoshShrivastava (@ai_for_success) 2024年12月11日

I can’t believe Google rolled this out before OpenAI.

It takes live feeds, answers in real-time with almost no latency, Pretty mind-blowing.

Thanks, Google, for this early Christmas gift!

Adding more details below 👇 pic.twitter.com/tk6Wh2bakd

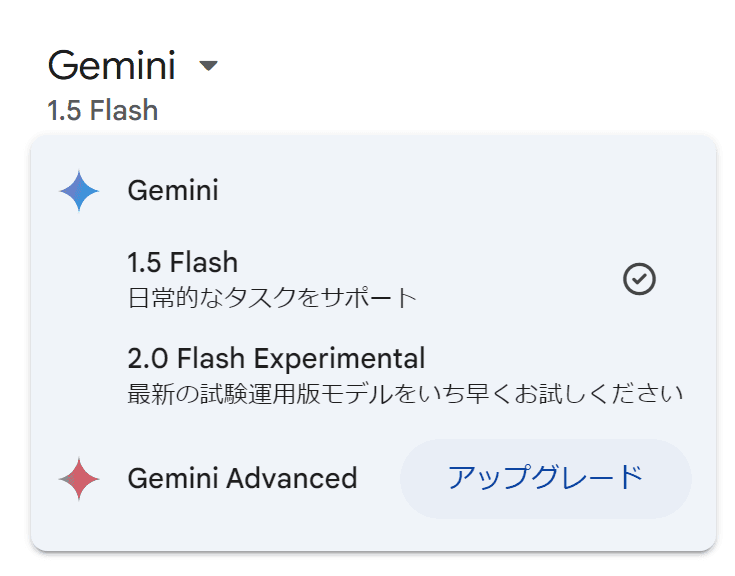

Gemini 2.0 Flashの発表と同時に、Geminiのウェブ版においてモデルをGemini 2.0 Flashの実験版に切り替える事が可能になっています。モバイルアプリ版でのモデルの切り替えについては今後対応予定とのこと。

Googleはユーザーが簡単にAIを活用できるようにするための「AIエージェント」の開発にも力を入れています。例えば以下の動画に登場するProject Astraは現実世界でマルチモーダルな理解を活用するエージェントで、Gemini 2.0モデルを使用すると人間に近い速度で会話できるとのこと。動画では「このモニュメントの歴史を教えて」と聞くと歴史を解説してくれています。

With new streaming capabilities and Gemini 2.0’s native audio understanding, Project Astra can respond at about the latency of human conversation.

— Google DeepMind (@GoogleDeepMind) 2024年12月11日

It can also converse in multiple languages and has a better understanding of accents and uncommon words. 🌎 https://t.co/ywY2oZvEVX pic.twitter.com/rqd64VAeb3

DeepMind創業者のデミス・ハサビス氏は「Gemini 2.0 Flashはほんの始まりに過ぎない」と今後さらなるモデルが登場することをアピールしたほか、「2025年はAIエージェントの年になる」と述べました。

Thrilled to kick off the Gemini 2.0 era with Gemini 2.0 Flash, an update to our workhorse model that outperforms even 1.5 Pro at twice the speed. It has really great multilingual skills, and can natively call tools, like Google Search. It’s the first release in the Gemini 2.0… pic.twitter.com/pjndTAf1PY

— Demis Hassabis (@demishassabis) 2024年12月11日

・関連記事

Googleのエンジニアが語るAI支援コーディングの「70%問題」、AIが生産性を爆上げしたのになぜ製品は改善されない? - GIGAZINE

自分の創作物がAI学習に使用されたかどうかを確認できるようになる「AIの透明性と責任に関する法案」がアメリカで提出される - GIGAZINE

AIを使いこなせるかどうかは「能力次第」、AIが上位10%のエリート科学者の成果を81%増やしたとの研究結果 - GIGAZINE

AIはわずか2時間の対話で人間の性格をコピーできる - GIGAZINE

NVIDIA製グラボやAppleチップのAI推論処理能力をまとめた一覧表、どのグラボやMacを買えばいいのかの参考になる - GIGAZINE

・関連コンテンツ

in ソフトウェア, ネットサービス, ウェブアプリ, Posted by log1d_ts

You can read the machine translated English article Google announces 'Gemini 2.0', a high-sp….