Anthropicのテキスト生成AI「Claude」がOpenAIのGPT-4の約3万2000トークンの3倍近い10万トークンに対応して長文の入力も可能に

ChatGPTなどの対話型AIは、高精度なテキストを生成できる一方、入力が可能な言語の最小単位である「トークン」には限度があります。OpenAIのGPT-4は約3万2000トークンまでの入力が可能ですが、AI研究スタートアップのAnthropicがテキスト生成AI「Claude」のトークンを9000から10万へ拡張したことを発表しました。

Anthropic | Introducing 100K Context Windows

https://www.anthropic.com/index/100k-context-windows

Anthropic’s latest model can take ‘The Great Gatsby’ as input | TechCrunch

https://techcrunch.com/2023/05/11/anthropics-latest-model-can-take-the-great-gatsby-as-input/

AI startup Anthropic unveils moral principles behind chatbot Claude | Computerworld

https://www.computerworld.com/article/3695952/ai-startup-anthropic-unveils-moral-principles-behind-chatbot-claude.html

ChatGPTやGPT-4のような従来のAIモデルは、数千個ものトークンを入力した場合、人間による最初の指示を忘れ、文章内の最新の情報から行動を決定してしまう問題があります。OpenAIなどのAI開発団体はこの問題に対処するため開発・研究を行っていますが、OpenAIによる大規模言語モデルのGPT-4でも約3万2000トークンが上限で、本や研究論文の要約や大規模なコーディングなどはいまだ困難だとされています。

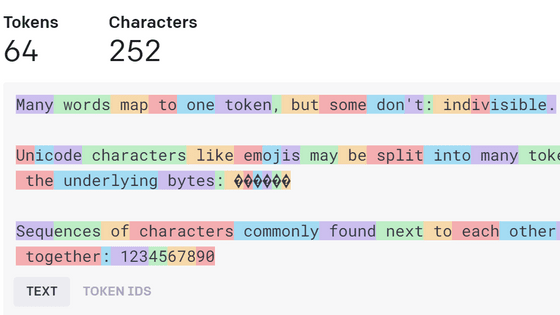

AIによる文章認識のための「トークン」の考え方については以下の記事で詳しくまとめられています。

ChatGPTなどのチャットAIがどんな風に文章をトークンとして認識しているのかが一目で分かる「Tokenizer」 - GIGAZINE

もしも入力可能なトークン数が増加した場合、本や論文といった資料の要約などが可能になるだけでなく、これまで困難だった、数時間や数日間にわたるAIとの建設的な会話が可能とされています。

AI研究のスタートアップであるAnthropicは、同社が開発するテキスト生成AIモデルの「Claude」の最大トークン数をこれまでの9000トークンから10万トークンに拡張し、約7万5000字の英語の文章に対応したことを発表しました。Anthropicは、Claudeの対応可能トークン数増加によって長文対応が可能になったことを明かし、新たなClaudeでは、数百ページにわたる資料を入力して分析する機能や、複数のドキュメントや本などから情報を取得して、「知識の統合」を必要とする質問に答えることができると説明しています。

Introducing 100K Context Windows! We’ve expanded Claude’s context window to 100,000 tokens of text, corresponding to around 75K words. Submit hundreds of pages of materials for Claude to digest and analyze. Conversations with Claude can go on for hours or days. pic.twitter.com/4WLEp7ou7U

— Anthropic (@AnthropicAI) May 11, 2023

さらに、Anthropicは長文対応したClaudeについてさまざまなユースケースを紹介しており、「財務報告や研究論文などの資料の理解・要約・説明」「年次報告書に基づく企業の戦略的リスクと機会の分析」「法律の長所と短所を評価」「何百ページもの開発者向けドキュメントを読み込み、技術的な質問に適切に答える」ことなどが挙げられています。

Anthropicが公開したClaudeのデモ動画が以下。Claudeに「LangChainについて教えてください」と尋ねたところ、「知識不足により回答ができません」と返答されています。そこでLangChainについてのPDFファイルを読み込ませたところ、ClaudeがLangChainについて理解したことが示されています。

Anthropicは「平均的な人物は約5時間で10万トークン分の文章を読むことが可能とされていますが、その情報を理解・記憶・分析するためにはかなりの時間が必要です。しかしClaudeであれば1分以内にこれらの処理を行うことができます」と述べています。

実際に、F・スコット・フィッツジェラルドによる小説「グレート・ギャツビー」全体をClaudeに読み込ませ、一文を書き換えたうえでClaudeに対して「元の文章と何が違いますか」と尋ねたところ、わずか22秒で正解が返ってきたとAnthropicは報告しています。

ClaudeのトレーニングについてAnthropicは、「Claudeは人間が違法または非倫理的な活動を行う可能性がある、有毒または差別的な出力を一連の原則を使用して出力してよいか判断するシステムが搭載されています」と述べています。従来の対話型AIはトレーニングにおいて人間からのフィードバックが必要になりますが、Claudeは「世界人権宣言」や「Appleプライバシーポリシー」、DeepMindによる「対話型AIのための原則」などの確立された一連の原則に従って、Claude自身による回答の批評および修正が行われています。その結果、Claudeでは従来の対話型AIと比較して「有害、人種差別的、性差別的、または違法、暴力的、非倫理的な行動を奨励、支援する回答を生成しにくい」とされています。

Anthropicは「同社の対話型AIに対する原則は、一般常識から、AIが自我を持つことを避けるような哲学的なものまで、あらゆる範囲に及んでいます」と報告しています。

なお、Claudeは記事作成時点でプレビュー段階で、Claudeの使用にはAnthropicへのリクエストが必要です。

・関連記事

ChatGPTなどのチャットAIがどんな風に文章をトークンとして認識しているのかが一目で分かる「Tokenizer」 - GIGAZINE

ChatGPTに匹敵する性能の日本語対応チャットAI「Vicuna-13B」のデータが公開され一般家庭のPC上で動作可能に - GIGAZINE

ChatGPTで生成された文章がすぐわかるように透かしを入れる試み - GIGAZINE

ChatGPTは何をしていてなぜ機能するのか?を理論物理学者が解説 - GIGAZINE

OpenAI開発のテキスト生成AI「GPT-3」がどんな処理を行っているのかを専門家が解説 - GIGAZINE

・関連コンテンツ

in AI, 動画, ソフトウェア, Posted by darkhorse_log

You can read the machine translated English article Anthropic's text generation AI ``Cla….