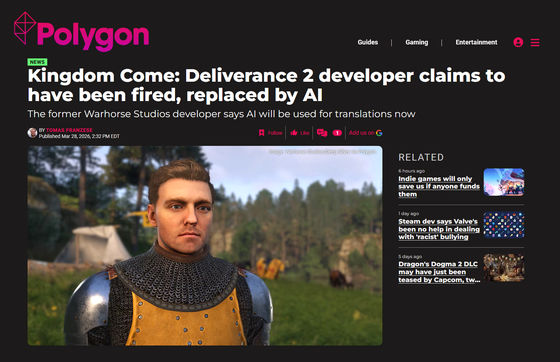

「Kingdom Come: Deliverance II」の開発者が解雇され「AIに取って代わられた」と主張

2026年2月時点で累計販売本数500万本を記録している「Kingdom Come: Deliverance II」の開発元であるWarhorse Studiosでローカライズを担当していたマックス・ヘイトマネク氏が、同社を解雇されました。同氏は解雇の理由について「AIに取って代わられた」と主張しています。

Kingdom Come: Deliverance 2 developer claims AI is replacing them

https://www.polygon.com/kingdom-come-deliverance-2-developer-fired-ai/

2026年3月28日、ヘイトマネク氏はReddit上でWarhorse Studiosを解雇されたことを報告しました。ヘイトマネク氏は2022年7月からWarhorse Studiosでチェコ語から英語への翻訳および編集を担当していたそうです。主に「Kingdom Come: Deliverance II」と、ダウンロードコンテンツ(DLC)を担当し、会話・クエストログ・アイテム名・その他さまざまな作業に加え、マーケティング資料も作成してきたと主張しています。ヘイトマネク氏は「英語で『Kingdom Come: Deliverance II』をプレイしたことがあるなら、私の作品を目にしたことがある可能性が高い」と記しました。

しかし、ヘイトマネク氏は3月27日に何の予告もなく会議に呼ばれ、会社の効率化および経費削減のため、翻訳・編集という役職は時代遅れになったと通告されたそうです。今後、すべての翻訳作業はAIが担当することになるとも伝えられた模様。これはヘイトマネク氏にとって大きな衝撃だったそうで、「AIを使った翻訳についての議論はこれまで何度も出てきており、私は常に強く反対していました。それが将来的な自分の仕事を失うことにつながるとは想像もしていませんでした。もちろん解雇が頭をよぎることはありましたが、Warhorse Studiosでの私の仕事は十分に評価されているので、すぐに職を失うことはないだろうと、うっかり考えていました」と語っています。

さらに、「AIの利用拡大はゲーム業界をはじめとする多くの人々に大きな影響を与えていることを知っていただきたいです。そして、皆さんが愛するゲームを制作している会社が、従業員の仕事はもちろんのこと、環境にもどれほど配慮しているかを知っていただきたいと思います」とも記しました。

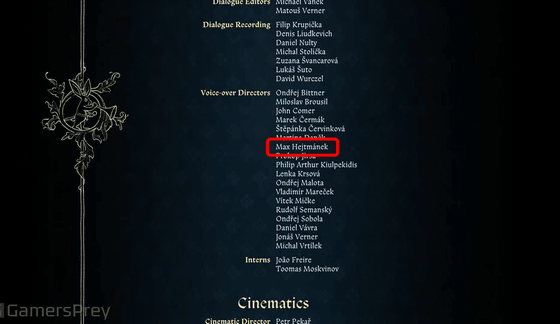

Redditのモデレーターがヘイトマネク氏がWarhorse Studiosで3年9カ月勤務していたことを確認しており、「Kingdom Come: Deliverance II」のクレジットでもボイスオーバーディレクターの欄に「マックス・ヘイトマネク(Max Hejtmánek)」という名前が記載されています。

なお、ヘイトマネク氏は「Warhorse Studiosの関係者を嫌がらせしたり、Steamで彼らのゲームにレビュー爆撃を仕掛けたりしないでください。そのような意図は全くありません。私が望んでいるのは、ゲーム業界の裏側で何が起こっているのかを、より多くの人に知ってもらうことだけです」と語っています。

ゲーム開発者によるAIの利用は、物議を醸すテーマです。世界最大規模のゲーム開発者向け会議であるGDCのようなイベントではAIが広く普及している一方で、その利用に対する反発も非常に大きくなっています。2026年3月には「紅の砂漠」がゲーム内のアートに生成型AIを使用したことで批判を集めました。

「紅の砂漠」の開発元がAIアートの使用について謝罪 - GIGAZINE

・関連記事

アートワーク・コード・BGMまで100%AIで制作された完全AI製ゲーム「CODEX MORTIS」がSteamに登場、開発者は建設作業員に外骨格を与えるようなものとAIによるバイブコ―ディングの利点を強調 - GIGAZINE

Steamで生成AIの使用を公表しているゲームは全体の7%に当たる7818本、2025年リリースのタイトルは最低でも約20%が生成AIを使用している - GIGAZINE

SteamがゲームにAIを利用しているか否かを示すAI開示ガイドラインを改訂しゲーム開発にAIツールを利用したことを開示する必要がなくなる - GIGAZINE

AI同士で「裏切り必須のゲーム」をプレイさせてわかった最もうそをつくのがうまいAIとは? - GIGAZINE

「ゲーム開発にコーディングの必要がなくなるAIをリリース予定」とUnityのCEOが明かす - GIGAZINE

コーディングAI「Claude Code」のスキルから完全に動作するGodot Engine 4駆動のゲームを作成できる「Godogen」 - GIGAZINE

・関連コンテンツ

You can read the machine translated English article Developer of 'Kingdom Come: Deliverance ….