CodexがWindowsの自動操作に対応、自動でペイントで絵を描いたりブラウザを操作したりできる

OpenAIのコーディングエージェント「Codex」にはPCを自動操作できる「Computer Use」という機能が備わっています。これまではComputer UseはmacOSにのみ対応していたのですが、2025年5月29日に実施されたアップデートによりWindowsでも使用可能となりました。

Changelog – Codex | OpenAI Developers

https://developers.openai.com/codex/changelog#codex-2026-05-28-app

Windows Computer Use and mobile access for Codex - YouTube

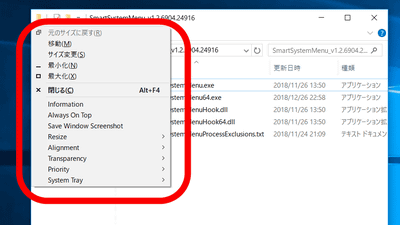

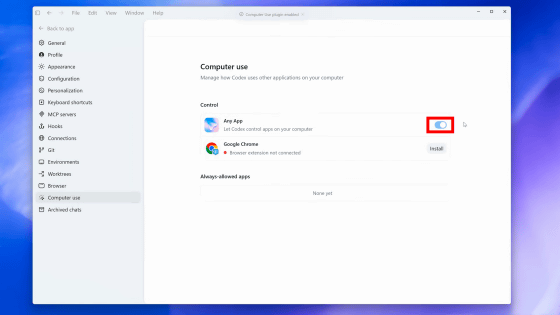

CodexアプリのComputer Useの画面内にある「Any App」を有効化するとPCを自動操作できるようになります。

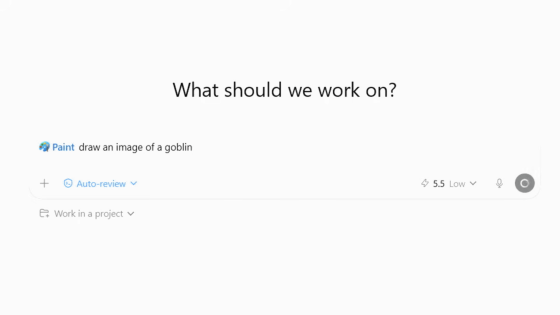

操作するアプリは「@○○」という形式で指定可能。一例として、「@paint draw an image of a goblin(ゴブリンの絵を描いて)」と指示します。

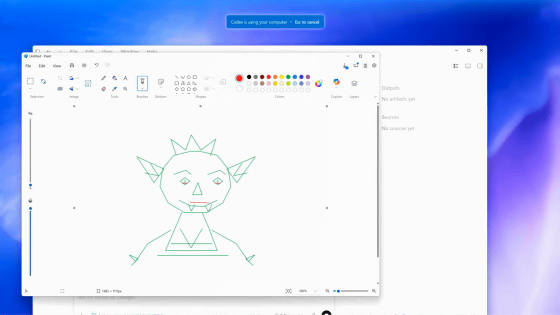

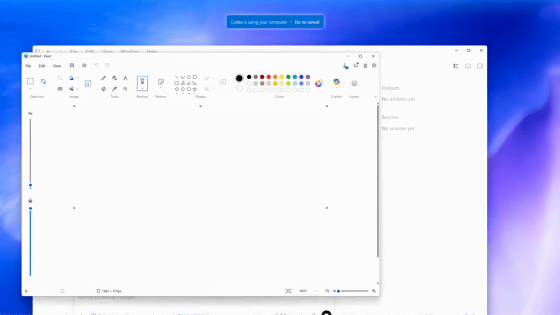

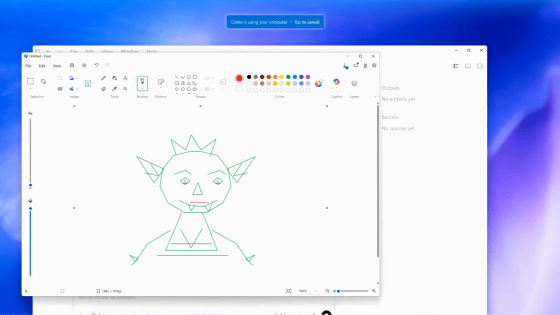

自動的にペイントが起動しました。

Codexによってマウスポインタが自動的に動き、ゴブリンの絵が描かれました。

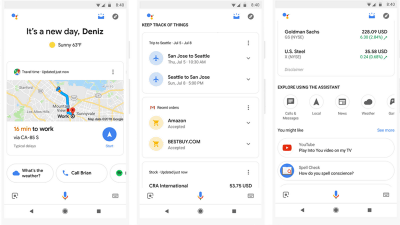

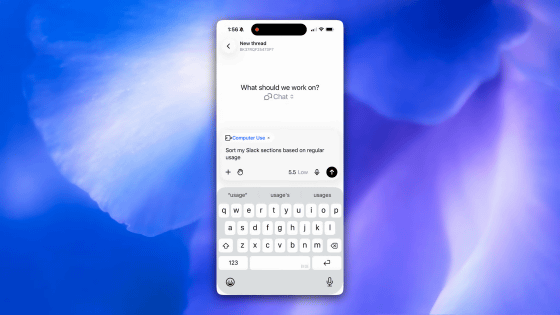

スマートフォンとの連携機能も使用可能で、iPhoneやAndroidスマートフォンからWindows PCの自動操作を指示できます。

OpenAIは「どこにいても作業を進めるためのさらなる方法を開発中」と述べています。

Windows users, this one’s for you.

— OpenAI (@OpenAI) May 29, 2026

Computer use now works on Windows, so Codex can take action on your Windows computer.

And with Windows support for Codex in the ChatGPT mobile app, you can start, review, and steer tasks on the go while work continues on your Windows machine.… pic.twitter.com/OPIxOcP4Nl

・関連記事

OpenAIがAIエージェント「Codex」を大幅刷新、「PCの操作」「ブラウザで直接指示」「画像生成でUIモックアップ」など - GIGAZINE

ChatGPTのスマホアプリにCodexへの指示機能が追加される、PCを開かずともCodexでエージェントコーディングやPC自動操作を実行可能 - GIGAZINE

OpenAIのコーディング支援AI「Codex」でChromeを直接操作可能に - GIGAZINE

Codexに作業進捗を報告してくれるペットを追加できる「Codex pets」が登場 - GIGAZINE

ChatGPTやCodexが「ゴブリン」を連呼するようになった原因をOpenAIが解説、オタクっぽいしゃべり方の学習方法に問題があった - GIGAZINE

・関連コンテンツ

in AI, 動画, ソフトウェア, Posted by log1o_hf

You can read the machine translated English article Codex now supports Windows automation, a….