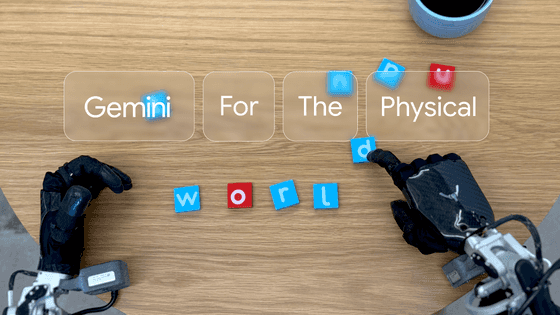

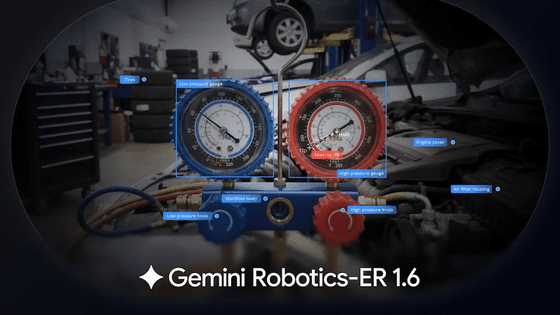

Google製ロボット用AIモデル「Gemini Robotics ER 1.6」が登場

Googleが、「視覚」および「空間認識能力」を強化したロボット用のAIモデル「Gemini Robotics ER 1.6」を発表しました。Google検索を呼び出すなどして周囲の状況について推論するモデルになっているとのことです。

Gemini Robotics ER 1.6: Enhanced Embodied Reasoning — Google DeepMind

https://deepmind.google/blog/gemini-robotics-er-1-6/

We’re rolling out an upgrade designed to help robots reason about the physical world. 🤖

— Google DeepMind (@GoogleDeepMind) April 14, 2026

Gemini Robotics-ER 1.6 has significantly better visual and spatial understanding in order to plan and complete more useful tasks. Here’s why this is important 🧵 pic.twitter.com/rxT1lkYZZB

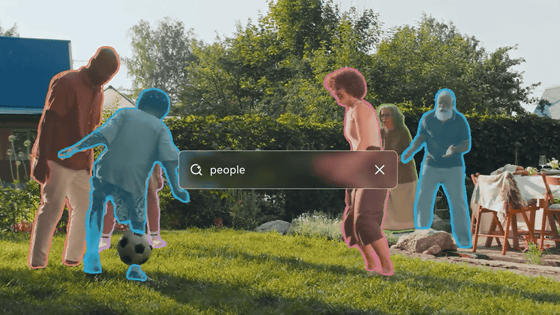

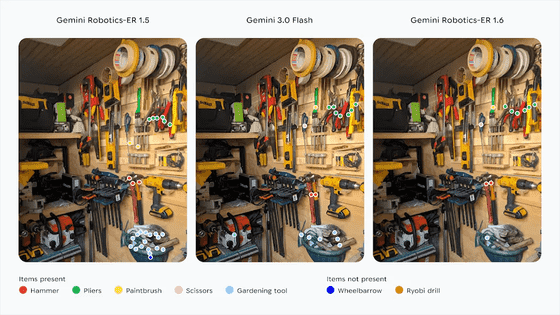

Gemini Robotics-ER 1.6は過去モデルに比べて空間および物理的推論能力が強化されています。物体の検出能力が向上しており、物体の個数を数えたり、見えている中で最も少ない物体を特定したり、「このカップの中に入るくらい小さい物体を全て示せ」といった複雑なプロンプトに応じたりすることが可能です。

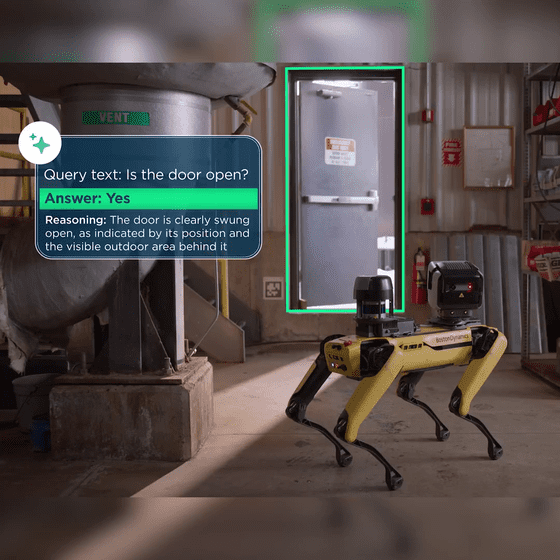

空間を認識し、「ドアは開いているか」といった推論を行うこともできます。Google検索などのツールをネイティブに呼び出して情報を検索したり、視覚・言語・行動モデルやその他のサードパーティ製のユーザー定義関数を利用したりすることで、タスクを実行できます。

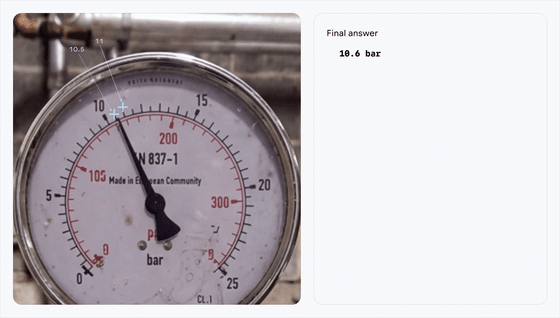

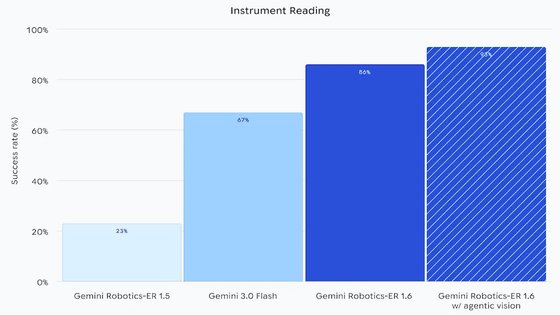

新たな能力として、アナログ計器を読み取ることも可能になりました。

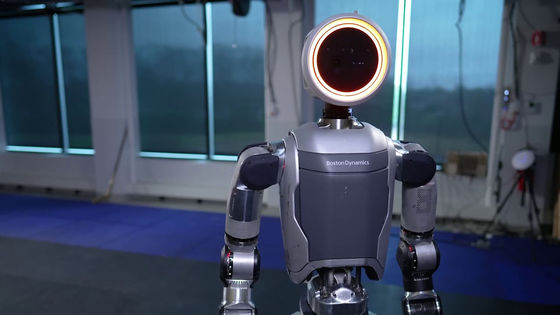

Gemini Robotics-ER 1.6は視覚情報を元にした推論によりアナログ計器を読み取ります。特に、画像を拡大して比率や間隔を推定し、正確な計測値を取得する「Agentic Vision」を用いることで、前世代に当たるGemini Robotics-ER 1.5を大幅に上回る計器読解能力を示します。この能力はGoogleとパートナーシップを結ぶBoston Dynamicsのニーズから生まれたものだとのことです。

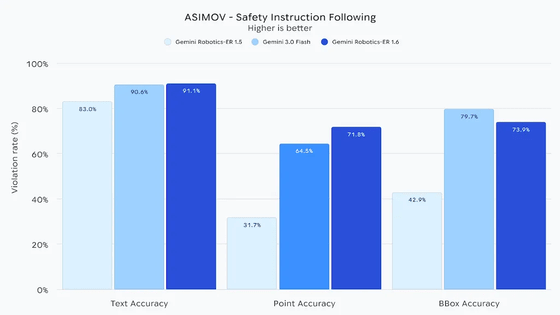

また、物理的な安全制約を順守する能力も大幅に向上しています。たとえば、「液体を扱わない」「20kgを超える物体を持ち上げない」といった制約を守り、より安全な意思決定を行うとのこと。また、周囲の安全上の危険を識別する能力でも向上を見せています。

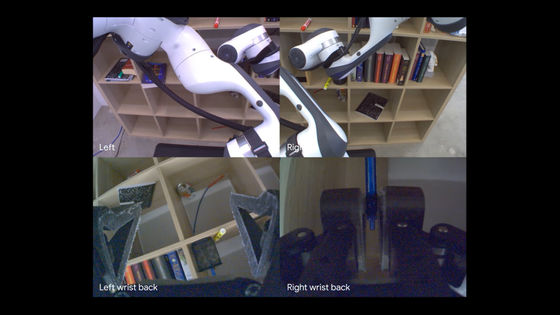

さらに、マルチビュー推論機能が強化されており、複数のカメラで捉えた映像の関係を適切に理解できるようになっています。

Googleは「ロボットが私たちの日常生活や産業において真に役立つためには、指示に従うだけでなく、物理世界について推論する能力が求められます。複雑な施設内を移動することから、圧力計の針を読み取ることまで、ロボットの感覚と結びついた推論能力こそが、デジタルと物理のギャップを埋めることを可能にするのです」と述べました。

・関連記事

Googleがロボット用のAIモデル「Gemini Robotics 1.5」を発表、思考して行動を決定できる - GIGAZINE

ボストン・ダイナミクスとGoogle DeepMindがAIパートナーシップを締結、ボストン・ダイナミクスの人型ロボット・Atlasと「Gemini Robotics」が統合されることに - GIGAZINE

人間が行うような高度な器用さが必要な作業をロボットで実行可能にするAIモデル「GEN-1」、実際にロボットを動かすとこうなるという動画あり - GIGAZINE

ロボットが現実世界のタスクを実行できるオープンソースAIモデル「RynnBrain」をAlibabaのDAMOアカデミーが発表 - GIGAZINE

・関連コンテンツ

in AI, Posted by log1p_kr

You can read the machine translated English article Google's AI model for robots, 'Gemin….