Google DeepMindが自然言語で場所の案内などオフィス内のタスクをこなすデモムービーを公開

Gemini 1.5の最大100万トークンという長いコンテキストウィンドウを活用することで、オフィス内のタスクを自然言語で解決できるようになったとGoogle DeepMindが論文にまとめ、デモムービーを公開しました。

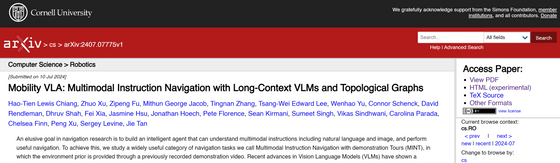

[2407.07775v1] Mobility VLA: Multimodal Instruction Navigation with Long-Context VLMs and Topological Graphs

https://arxiv.org/abs/2407.07775v1

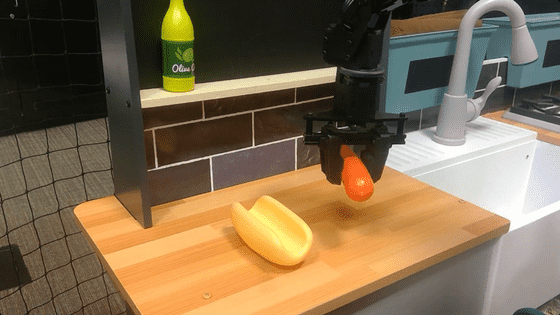

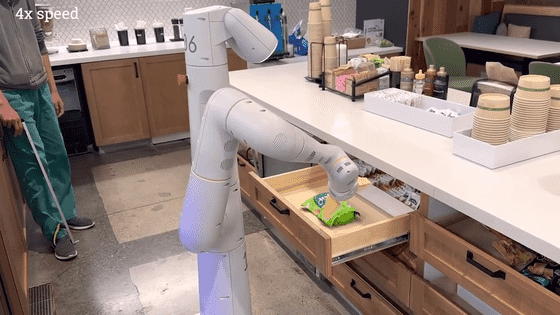

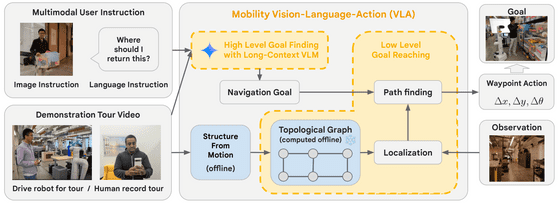

コンテキストウィンドウが大きいAIモデルは一度に多くの情報を扱うことが可能です。今回、DeepMindはオフィスや自宅を案内するムービーを撮影してAIに視聴させ、「どこに何があるのか」という環境についての情報を学習させました。

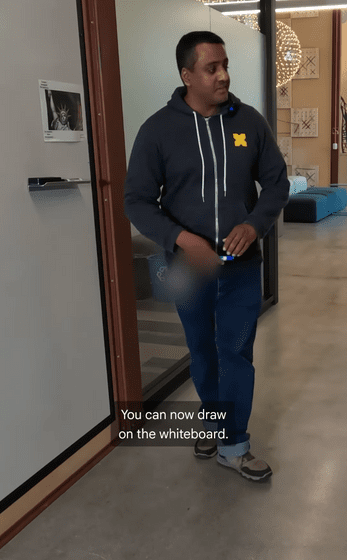

ユーザーが自然言語でAIに指示することで、AIがムービーの情報とカメラからの入力を元にユーザーを目的地に案内させることに成功したとのこと。以下は実際に「何かを描ける場所を教えて」というタスクをこなすデモムービーです。

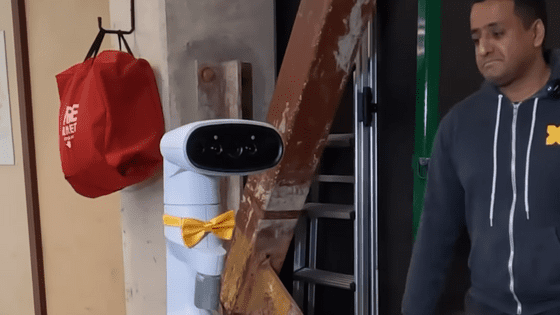

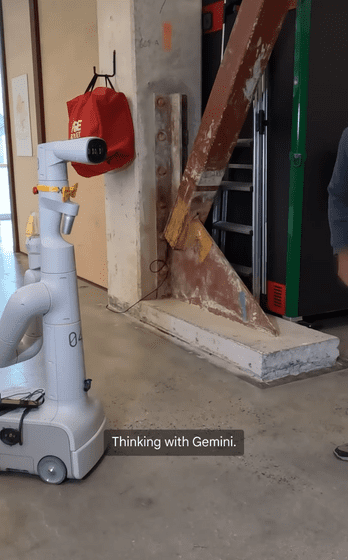

AIを搭載したロボットに「何かを描ける場所を教えて」と音声で入力すると、ロボットが「Geminiで考えます。しばらくお待ちください」と返答。

しばらくしてロボットがゆっくりと動き始めました。

無事ユーザーをホワイトボードの前に案内することに成功。

モデルの概要はこんな感じ。その他にこなせるタスクの例として、物を持った状態で「これはどこに返却すれば良いですか?」という質問や、スマートフォンを見せつつ「どこで充電できますか?」という質問が掲載されています。

研究チームは「大規模な現実世界の環境における複雑な推論とマルチモーダルなユーザー指示を伴う、これまでは実行不可能だったナビゲーションタスクで、エンドツーエンドで最大90パーセントの成功率を達成した」と結果が大成功だったことをアピールしました。

・関連記事

「現時点での汎用AIは猫程度のIQしかない」とGoogle DeepMindのデミス・ハサビスCEOが主張 - GIGAZINE

Google DeepMindが「動画にピッタリな音楽を生成するAI」を発表 - GIGAZINE

Google DeepMindによる「AIを使って220万種類の新しい結晶構造を発見した」という主張に研究者が異議を唱える - GIGAZINE

DeepMind・OpenAI・Anthropicの設立の経緯について、AIのリスクを最も恐れていた人々は自分たちがトップになるべきだと決心し構築するまで - GIGAZINE

Google DeepMindが「AIは人間と同じように社会学習でスキルを獲得できる」ことを実証したと主張 - GIGAZINE

・関連コンテンツ

in AI, 動画, ソフトウェア, Posted by log1d_ts

You can read the machine translated English article Google DeepMind releases a demo movie th….