司法機関がAIをどのように用いるべきかを示すガイドラインが登場

社会全体でAIを使用する事例が増えていることから、イングランドとウェールズの判事らを監督する司法府が、司法機関においてAIをどのように用いるべきかを示すガイドラインを発表しました。

Artificial Intelligence (AI) - Judicial Guidance - Courts and Tribunals Judiciary

https://www.judiciary.uk/guidance-and-resources/artificial-intelligence-ai-judicial-guidance/

ガイドラインは大きく7つの項目に分かれていて、おおむね以下のような内容となっています。

◆1:AIとそのアプリケーションの理解

まずはAIを利用する前に、その機能や潜在的に制限されることについての基本的な理解が必要です。

たとえば、一般公開されているAIチャットボットは、受信したプロンプトとトレーニングに用いたデータに基づき、アルゴリズムを使用してテキストを生成します。あくまで「最も可能性の高い単語の組み合わせ」とモデルが予測したテキストが生成されているのであり、正確な答えが出力されているわけではありません。

また、インターネットで入手できる情報と同じように、「この資料が正しいと分かっているがいま手元にない」というものを見つけ出すには有用ですが、正確性が検証できない新情報を見つけるための調査に用いるには不向きです。

回答の質も一定ではなく、入力したプロンプトの性質や、関連するAIツールの使用方法によって異なってきます。また、最適なプロンプトを入力したとしても、提供される情報は不完全だったり不正確だったり、あるいは偏ったものであることがあります。

そして、大規模言語モデルは多くがネットで公開されている資料をもとにトレーニングを受けているため、出力される見解はアメリカの法律に基づいたものであることが多い点には注意が必要です。

◆2:機密とプライバシーの保護

パブリックドメインになっていない一般公開のAIチャットボットに情報を入力しないこと。特に個人情報や機密情報は入力しないでください。AIチャットボットに入力した情報はすべて世界中に公開されたものとみなされます。

現在(現地時間2023年12月12日時点)公開されているAIチャットボットはユーザーの質問や入力した情報をすべて記憶しており、その情報は他のユーザーからのクエリに応答するために使用されます。その結果、過去に入力した情報が公になる可能性があります。

選べるなら、AIチャットボットの履歴は無効化する必要があります。履歴の無効化を選択できるのはChatGPTとGoogle Bardで、Bing Chatではまだ選択できません。

一部のAIプラットフォーム、特にスマートフォンアプリは、デバイスの様々な情報へのアクセスを求めてくることがあるため注意してください。そういった状況では、すべての許可申請を拒否する必要があります。

機密情報や個人情報が意図せず開示された場合は、指導裁判官や司法府に連絡する必要があります。個人情報が含まれる場合はデータインシデントとして報告してください。データインシデントを司法府に報告する方法は、イントラネットのデータ侵害通知フォームを参照してください。

将来的に、裁判所や法廷で使用するために設計されたAIツールが利用可能になるかもしれませんが、それが実現するまでは、すべてのAIツールは入力した内容が公になるものと考えて扱う必要があります。

◆3:説明責任と正確性の確保

AIツールによって提供された情報は、不正確だったり不完全だったり古かったりする場合があります。「イギリス法を代表して」と書いてあっても、そうではないことがあります。

AIツール使用時に発生する問題には以下のようなものがあります。

・架空の事例や参考文献、発言をでっち上げる。または存在しない法律や条文、法的文書を参照する。

・法律またはその適用方法について誤った情報や誤解を招く情報を提供する。

・事実誤認をする。

◆4:バイアスを意識する

大規模言語モデルに基づくAIツールは、トレーニング対象のデータセットをもとにして応答を生成します。つまり、トレーニングに用いたデータセットに含まれていた間違いやバイアスから逃れられません。

常に、この間違いやバイアスが含まれているという可能性と、それを修正しなければいけない必要性を考慮してください。

◆5:セキュリティの維持

自分自身と法廷・裁判所のセキュリティを維持するための最善を尽くしてください。

AIツールにアクセスする際には、個人用端末ではなく業務用端末を用いてください。また、職場のメールアドレスを用いてください。

一般的に無料サービスより有料サービスのほうが安全であることが確認されているので、有料のサブスクリプションプランがある場合は利用してください。ただし、他社からAIプラットフォームのライセンスを取得しているサードパーティー企業の中には、ユーザー情報の扱いについての信頼性が低い企業が含まれるため、そういったところは避けてください。

◆6:責任を負う

司法機関の職員は、自己名義で作成された資料について個人的に責任を負っています。

裁判官は、一般的に、判決を下すために行われたであろう調査や準備作業についてAIを用いたか記述する義務はありません。これらのガイドラインが適切に順守されるのであれば、生成AIは潜在的に有能な補助ツールとなります。

事務員や司法補助員、その他のスタッフが業務の中でAIツールを用いる場合、スタッフと話し合って、ツールを適切に使用し、リスクを軽減するための措置を講じているかを確認する必要があります。

◆7:裁判所・法廷の利用者がAIツールを使用している可能性に注意

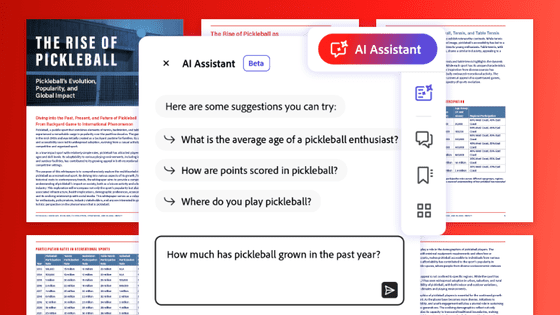

すでに電子開示で利用されているTAR(Technology Assisted Review)のように、AIツールの一部は司法界に取り入れられています。

すべての法定代理人は、裁判所に提出する資料が正確かつ適切であることを保証する義務を負います。責任を持ってAIを使用するのであれば、法定代理人がAIを使ったかどうかについて言及すべき理由はありませんが、言及を要するかどうかは文脈によります。

なお、AIが司法の場で用いられた事例としては、弁護士が提出した資料の作成でChatGPTを使用した結果、存在しない判例を引用したり、存在しない裁判長の見解が含まれていたりしたことがあります。

弁護士がChatGPTを使って作成した申請書で存在しない過去の事例がでっち上げられていたことが判明 - GIGAZINE

・関連記事

市議会が全会一致で承認した決議案が実はChatGPTによって書かれたものだったことが明らかに - GIGAZINE

弁護士がChatGPTを使って作成した申請書で存在しない過去の事例がでっち上げられていたことが判明 - GIGAZINE

AIを使った「ロボット弁護士」出廷が人間の弁護士からの「刑務所にぶち込む」との脅迫殺到で中止 - GIGAZINE

・関連コンテンツ

in メモ, Posted by logc_nt

You can read the machine translated English article Guidelines showing how judicial institut….