OpenAIが4度目のブレイクスルーとなる数学ができるAI「Q*(キュースター)」で汎用人工知能開発の飛躍を目指す、アルトマンCEO解任騒動の一因か

OpenAIが新たなAI開発プロジェクト「Q*(キュースター)」を進めていることを認めたと報じられています。このQ*は数学的推論能力の改善を目指したもので、汎用人工知能(AGI)の研究に画期的な進歩をもたらすかもしれず、2023年11月に起こったサム・アルトマンCEO解任騒動の一因にもなった可能性が指摘されています。

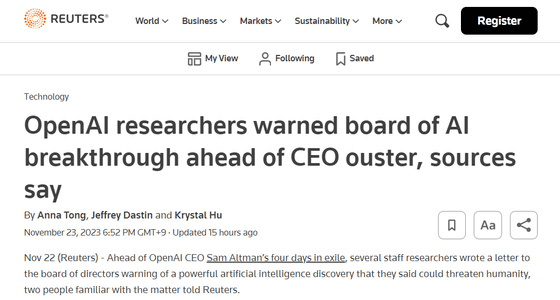

OpenAI researchers warned board of AI breakthrough ahead of CEO ouster, sources say | Reuters

https://www.reuters.com/technology/sam-altmans-ouster-openai-was-precipitated-by-letter-board-about-ai-breakthrough-2023-11-22/

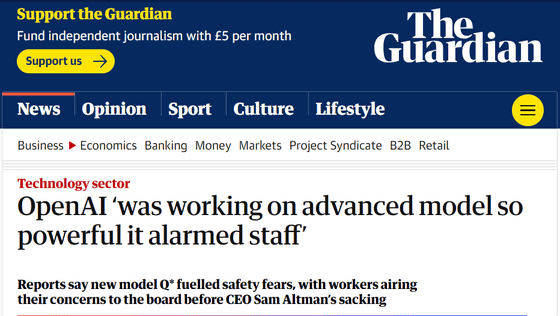

OpenAI ‘was working on advanced model so powerful it alarmed staff’ | Technology sector | The Guardian

https://www.theguardian.com/business/2023/nov/23/openai-was-working-on-advanced-model-so-powerful-it-alarmed-staff

写真のような美麗な画像を生成したり、まるで人が書いたような精度の文章を出力したりと、生成AIは日進月歩の進化を遂げていますが、計算や数学的推論については精度が低く、AI開発における目下の課題となっています。以下の記事で、実際にChatGPT・Google Bard・Bing Chatに数学の問題を解かせたところ、小学生レベルの問題でも間違えてしまうことが確認できました。

算数や計算が苦手な対話型チャットAIに数学的推論を正しく行わせるには途中のステップをチェックしながら訓練するのがよいとOpenAIが提案 - GIGAZINE

ロイターは、アルトマンCEOが取締役会に解任される直前に、OpenAIの従業員数人が取締役会へ「人類を脅かす可能性がある強力なAIの発見について警告する書簡」を送ったと報じています。

この書簡に書かれていたプロジェクトがQ*です。このQ*は数学的推論の能力がこれまでのAIよりも優れており、小学生レベルではあるものの、数学のテストに合格してその能力を実証したとのこと。

OpenAIのGPTのような大規模言語モデルは人間が書いたような精度の文章を作り出すことが可能ですが、あくまでも言葉のつながりを確率的に予測しているだけで、言葉自体が持つ意味や文脈は考慮していません。しかし、Q*はAIの推論能力と認知能力の大幅な進歩を示しており、AGIの開発に大きな飛躍をもたらす可能性があるとのこと。

ロイターによれば、OpenAIはコメントを拒否したそうですが、従業員宛ての内部メッセージでQ*の開発が進められていることと、取締役会に送られた書簡の存在を認めたとのこと。このメッセージはOpenAIのミラ・ムラティCTO(最高技術責任者)が送ったもので、特定の報道についてスタッフに警告するものだったそうです。

アルトマン氏がCEOを突如解任されたのは、取締役会の一部とアルトマン氏がAIの安全性をめぐって対立したからだと報じられています。また、OpenAIについて批判的な論文を書いた取締役会メンバーと対立していたことも報じられています。

OpenAIのサム・アルトマンCEO解任騒動は会社に批判的な論文を書いた取締役会メンバーを追い出そうとしたことが原因か - GIGAZINE

by TechCrunch

イギリスの日刊紙であるThe Guardianは、アルトマン氏がこのQ*の開発プロジェクトを推進していたことが、取締役会とのAIの安全性をめぐる対立の火種となったのではないかとみています。なお、アルトマン氏解任後に暫定CEOとなったエメット・シア氏は、「取締役会は安全性に対する意見の相違を理由にアルトマン氏を解任したわけではありません」と述べています。

・関連記事

ChatGPTの開発元OpenAIが「10年以内にAIがほとんどの分野で専門家のスキルレベルを超える」という懸念に基づき「超知能AI」の登場に備えるべく世界的な規制機関を立ち上げる必要があると主張 - GIGAZINE

OpenAIが「GPT-5」の商標登録を出願していたと判明 - GIGAZINE

「AIが世界を乗っ取る」「AI研究を厳重に管理すべき」などのAI脅威論をAIのゴッドファーザーが否定、「AIは人間どころか犬の知能にも達していない」と主張 - GIGAZINE

「AIによる絶滅リスクの軽減は核戦争やパンデミック対策と同等の優先事項」と訴える書簡にOpenAIのサム・アルトマンCEOら350人以上のAI研究者や企業のCEOが署名 - GIGAZINE

「本格的な規制があればOpenAIはEUを離脱する」とサム・アルトマンCEOが発言 - GIGAZINE

突如OpenAIを追放されたサム・アルトマンに一体何が起こっているのか?時系列順まとめ - GIGAZINE

OpenAIのCEOにサム・アルトマンが復帰し取締役会のメンバーも刷新 - GIGAZINE

・関連コンテンツ

in ソフトウェア, Posted by log1i_yk

You can read the machine translated English article OpenAI aims to make a leap forward in th….