10万件超のChatGPTアカウントが盗まれてダークウェブで取引されていることが判明、企業の機密情報が漏えいする危険も

シンガポールを拠点とするサイバーセキュリティ企業のGroup-IBが、「10万件を超えるChatGPTのアカウントがマルウェアによって盗まれ、ダークウェブで取引されている」と報告しました。ChatGPTはデフォルトでユーザーのクエリとAIの応答履歴を保存しているため、ChatGPTアカウントへの不正アクセスは企業の機密情報や個人情報の漏えいにつながる危険性があるとのことです。

Group-IB Discovers 100K+ Compromised ChatGPT Accounts on Dark Web Marketplaces; Asia-Pacific region tops the list | Group-IB

https://www.group-ib.com/media-center/press-releases/stealers-chatgpt-credentials/

Trove of ChatGPT creds found on dark web • The Register

https://www.theregister.com/2023/06/20/stolen_chatgpt_accounts/

Over 100,000 ChatGPT accounts stolen via info-stealing malware

https://www.bleepingcomputer.com/news/security/over-100-000-chatgpt-accounts-stolen-via-info-stealing-malware/

Group-IBの脅威インテリジェンスプラットフォームは、ダークウェブのサイバー犯罪フォーラムやマーケットプレイス、クローズドコミュニティなどをリアルタイムで監視しています。これにより、侵害された資格情報や新たなマルウェアを特定し、さらなる被害が発生する前にリスクを特定しているとのこと。

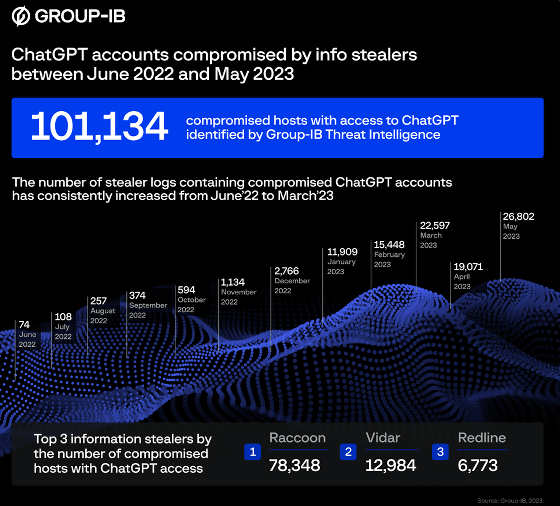

新たにGroup-IBは、感染したデバイスからさまざまな資格情報を盗み出すインフォスティーラーと呼ばれるタイプのマルウェアにより、過去1年間で10万1000件を超える「ChatGPTアカウントの認証情報」が盗み出されていたと報告しました。インフォスティーラーは主にウェブサービスの認証情報やクレジットカードの詳細情報、仮想通貨ウォレットのパスワード、電子メールやメッセージングアプリの会話などを収集しており、盗み出したデータはホストによって悪用されたり、他のハッカーに販売されたりしています。

以下の図は、2022年6月~2023年5月にかけてインフォスティーラーに侵害され、ダークウェブで取引されたChatGPTアカウントの件数を示したもの。2022年6月時点では月にわずか74件でしたが、11月には1134件まで増加し、2023年5月には2万6802件に達して過去最高の件数となりました。監視期間中に侵害されたChatGPTアカウントは10万1134件に達し、そのうち7万8348件がRaccoon、1万2984件がVidar、6773件がRedlineというインフォスティーラーによって侵害されたものです。

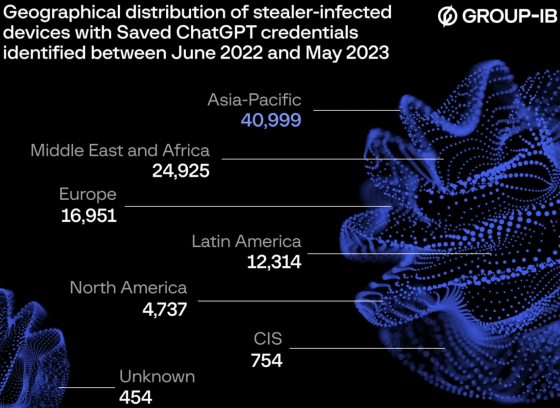

また、インフォスティーラーに侵害されたChatGPTアカウントは地域ごとの偏りも見られ、アジア太平洋地域は4万999件、中東・アフリカが2万4925件、ヨーロッパが1万6951件、ラテンアメリカが1万2314件、北米が4737件、CIS(独立国家共同体)が754件、地域不明が454件となっています。特にインドでは1万2632件、パキスタンでは9217件、ブラジルでは6531件ものアカウントが盗み出されたとGroup-IBは報告しています。

近年はコンサルティング企業であるマッキンゼー・アンド・カンパニーの幹部が「従業員の約半数は、マッキンゼーの許可を得た上で、業務上の取り組みとしてジェネレーティブAIを利用しています」と明らかにするなど、従業員がChatGPTをはじめとしたAIを仕事に使用するケースが増えています。しかも、「企業の機密データをChatGPTに入力したことがある」という従業員が増えていることがわかっており、ChatGPTを通じて機密情報が流出する危険性も指摘されています。

すでにSamsungのエンジニアがChatGPTに社外秘のソースコードを貼り付けるセキュリティ事案が発生しているほか、Appleは機密データ漏えいへの懸念からChatGPTなどの外部AIツールを利用することを制限しています。

AppleがChatGPTやGitHub Copilotなど外部AIツールの内部利用を制限へ、機密データ漏洩への懸念が原因 - GIGAZINE

ChatGPTはデフォルトでユーザーのクエリと応答の履歴を保存しているため、インフォスティーラーによって従業員が使用するChatGPTアカウントが侵害された場合、企業の機密情報などが流出する可能性があります。

テクノロジー系メディアのBleepingComputerは、機密情報をChatGPTに入力する場合は設定メニューからチャット保存機能を無効にするか、会話が終わったら履歴を削除することを推奨しています。しかし、インフォスティーラーはシステムのスクリーンショットやキーロギングによるデータ侵害も行うケースがあり、会話がChatGPTアカウントに保存されていなくてもデータ漏えいが発生する可能性があるとのことです。

・関連記事

AppleがChatGPTやGitHub Copilotなど外部AIツールの内部利用を制限へ、機密データ漏洩への懸念が原因 - GIGAZINE

「企業の機密データをChatGPTに勝手に入力したことがある」という社会人が大量発生しておりセキュリティ上の懸念が高まっているとサイバーセキュリティ企業が指摘 - GIGAZINE

SamsungのエンジニアがChatGPTに社外秘のソースコードを貼り付けるセキュリティ事案が発生 - GIGAZINE

ChatGPTで秘密情報の流出を防ぐ学習拒否設定の方法&会話履歴のダウンロード方法まとめ - GIGAZINE

ChatGPTの開発元OpenAIが「10年以内にAIがほとんどの分野で専門家のスキルレベルを超える」という懸念に基づき「超知能AI」の登場に備えるべく世界的な規制機関を立ち上げる必要があると主張 - GIGAZINE

ChatGPTなどのAIで科学論文を書くことが国際会議で禁止に、ただし自分の文章の編集・推敲はOK - GIGAZINE

会話AI「ChatGPT」の回答の投稿がコーディングQ&AサイトのStack Overflowで一時的に禁止される - GIGAZINE

対話型チャットAI「ChatGPT」開始から1週間も経たないうちにユーザーが100万人を突破、そもそもChatGPTとは一体何なのか? - GIGAZINE

・関連コンテンツ

in ネットサービス, セキュリティ, Posted by log1h_ik

You can read the machine translated English article It turns out that more than 100,000 Chat….