オープンソースで商用利用可能な言語モデル「MPT-7B」リリース、GPT-4の2倍の長さの文章を受け付ける

機械学習トレーニング用のシステムを提供する企業のMosaicMLが、オープンソースで商用利用可能な大規模言語モデル(LLM)の新基準「MPT(MosaicML Pretrained Transformer)-7B」を導入しました。MPTの基本モデルと、この基本モデルをベースに構築できる3つのバリエーションが公開されています。

Introducing MPT-7B: A New Standard for Open-Source, Commercially Usable LLMs

https://www.mosaicml.com/blog/mpt-7b

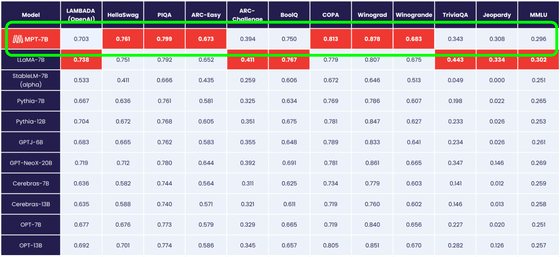

MPT-7BはMetaの大規模言語モデル「LLaMA」のパラメーター数70億のモデル「LLaMA-7B」と同等の品質を確保しており、標準的なタスクでは7B~20Bのオープンソース言語モデルをしのぐ性能を示しています。

MPT-7Bのバリエーションは以下の4種類です。

◆MPT-7B Base

MPT-7B Baseは670億のパラメーターを持つデコーダー形式の変換器で、MosaicMLのデータチームによって管理された1兆トークンのテキストとコードで学習されました。

◆MPT-7B-StoryWriter-65k+

MPT-7B-StoryWriter-65k+は、非常に長いコンテキスト長を持つストーリーを読み書きするために設計されたモデルです。6万5000トークンを超える推論が可能で、A100-80GB GPUのシングルノードで8万4000トークンでの動作を実証しています。

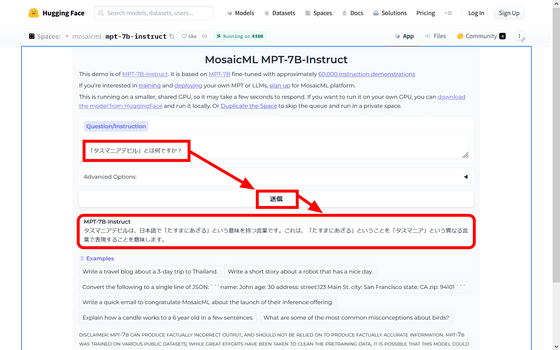

◆MPT-7B-Instruct

MPT-7B-Instructは短い形式の命令に従うためのモデルです。

◆MPT-7B-Chat

MPT-7B-Chatは対話生成のためのチャットボットのようなモデルです。ShareGPT-Vicuna、HC3、Alpaca、Helpful and Harmless、Evol-InstructのデータセットでMPT-7Bを微調整することで構築されています。

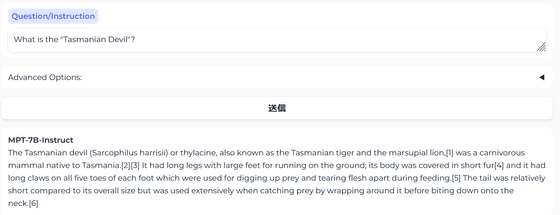

実際にデモページが公開されていたので、MPT-7B-Instructのデモを試してみました。MosaicLMが記した質問例「What is a quoll?(フクロネコとは何ですか?)」を参考に、まずは「タスマニアデビルとは何ですか?」と日本語で入力して「送信」をクリックしました。すると、MPT-7B-Instructは「タスマニアデビルは、日本語で『たすまにあざる』という意味を持つ言葉です」との回答を出力しました。

今度は英語で入力。それらしい答えを出力しているように見えますが、「別名をthylacine(フクロオオカミ)と言います」という誤った解答や、「[1]」などの無意味な脚注の番号が含まれていました。英語版Wikipediaからそのままコピーしているわけではないようで、脚注がどこから来たのかは不明。

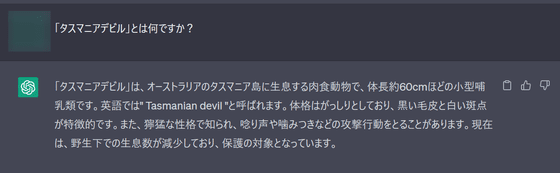

ChatGPT(GPT-3.5)で試してみると以下の文章を生成しました。

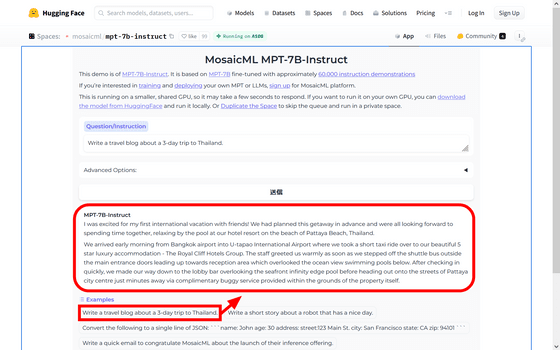

今度はデモページに記載されていた質問例からプロンプトをそのままコピーして入力しました。すると、約900文字で「3日間のタイ旅行のブログ」を出力しました。ウタパオ国際空港やThe Royal Cliff Hotels Groupなど、回答中に出現する固有名詞はすべて回答内容と関連性があるものでした。

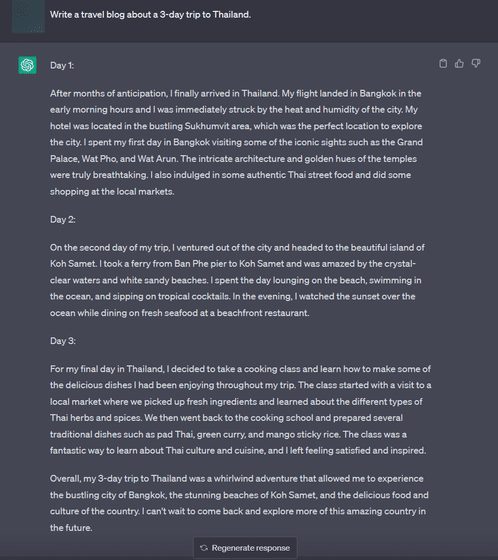

ChatGPTで同様の質問を投げかけると、約1900文字で回答を出力しました。

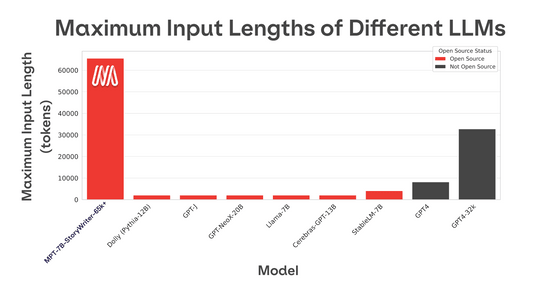

ほとんどのオープンソースの言語モデルは、数千トークンまでのシーケンスしか扱えません。しかし、MosaicMLプラットフォームと8xA100-40GBのシングルノードを使えば、MPT-7Bを簡単に微調整して最大6万5000までのコンテキスト長を扱えるようにできるとのこと。

MPT-7B-StoryWriter-65k+は6万5000トークンの処理を賄えるモデルです。これは、約8000または約3万2000トークンを扱えるGPT-4の2倍。MPT-7Bに6万8000トークン弱の小説「グレート・ギャツビー」を試しに読み込ませてみると、約20秒(1分間に15万単語)で読み込み、「エピローグ」というプロンプトに対してエピローグを生成することに成功したとのことです。

4種のモデルはわずか数週間での構築に成功したとのことで、今後同様のモデルが次々に誕生する可能性も十分考えられます。MosaicMLは「MPT-7Bはデモンストレーションだと考えてください。MPT-7Bはほんの始まりに過ぎません。コミュニティがツールや成果物を構築していく様子を見るのを楽しみにしています。MosaicMLは、より高い品質の基礎モデルを作り続けていきます。すでにトレーニング中のモデルもあります。ぜひ、ご期待ください」と述べました。

・関連記事

MicrosoftがBingのチャットAIを全ユーザーに開放、「質問に画像やグラフで回答」などAI機能の強化や今後追加予定の新機能も発表 - GIGAZINE

「オープンソースは脅威」「勝者はMeta」「OpenAIは重要ではない」などと記されたGoogleのAI関連内部文書が流出 - GIGAZINE

WebGPUでブラウザからGPTなど言語モデルを体験できる「WebGPT」 - GIGAZINE

画像生成AI「Stable Diffusion」開発元が自然な文章から画像を生成できる「DeepFloyd IF」を発表 - GIGAZINE

有料の「GPT-4」を無料で使えるようにした「gpt4free」がOpenAIから「削除しないと訴える」と脅迫される - GIGAZINE

・関連コンテンツ

in ソフトウェア, Posted by log1p_kr

You can read the machine translated English article Open source and commercially available l….