Googleドキュメントでより非差別的な用語を推奨してくる入力支援ツールに対し「地獄のように迷惑」と非難の声

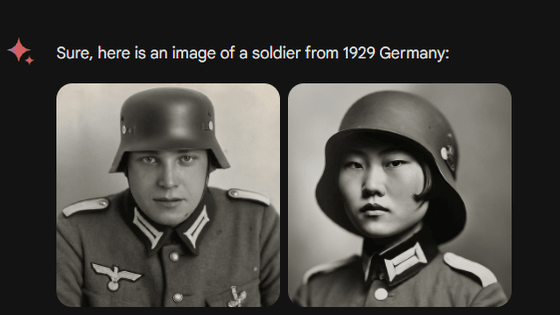

Googleはオンラインで文書の作成・編集ができるGoogleドキュメントにおいて、「assistive writing」というAIを用いた入力支援ツールを2022年4月から提供しています。assistive writingはユーザーがより適切かつ簡潔で、そして差別的要素を避けた包括的な文書を作成することを支援するとされていますが、海外メディアのMotherboardはこのassistive writingについて「地獄のように迷惑」と報じています。

Google’s AI-Powered ‘Inclusive Warnings’ Feature Is Very Broken

https://www.vice.com/en/article/v7dk8m/googles-ai-powered-inclusive-warnings-feature-is-very-broken

assistive writingは2022年4月から順次、Google Workspaceの有料プランを使用する一部ユーザー向けにリリースされている入力支援ツールであり、対象ユーザーでは既定で有効となっています。このツールはより適切かつ簡潔で、差別的用語を避けた包括的な文章の作成を支援するとされていますが、Motherboardのライターからはツールの不完全性を非難する声が上がっているとのこと。

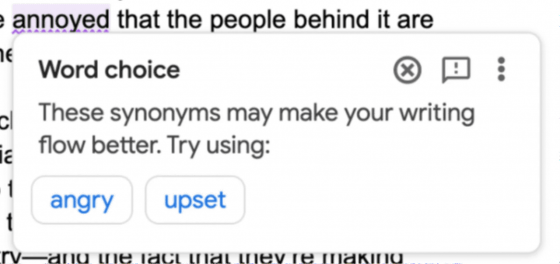

Motherboardの上級スタッフライターであるLorenzo Franceschi-Bicchierai氏は、「annoyed(イライラした)」と入力したところ、assistive writingは文章の流れをよりよくするためとして、「angry(怒る)」「upset(動転する)」といった単語に言い換えることを推奨してきたと報告しています。これについてFranceschi-Bicchierai氏は、イライラすること、怒ること、気が動転することはそれぞれまったく異なる感情であると指摘。ライターであるFranceschi-Bicchierai氏にとって、assistive writingの提案はとても気が利かないものだったようです。

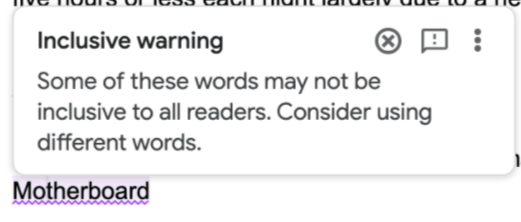

また、編集者のEmily Lipstein氏がメディアの名前である「Motherboard」を入力したところ、なんと「このような単語はすべての読者にとって包括的ではないかもしれません。別の言葉に言い換えることを検討してください」と指摘されてしまいました。これは「Mother(母親)」という単語について、よりLGBTQ+の人々への配慮をするようにという指示だと思われますが、メディア名を言い換えるとまったく意味が変わってきてしまう上に、そもそも「Motherboard(マザーボード)」は電子機器における主要な電子回路基板のことを指す用語でもあります。

さらにジャーナリストのRebecca Baird-Remba氏は、「landlord(家主)」という単語について「property owner(不動産所有者)」または「proprietor(所有者)」といった単語に言い換えるように警告を受けたと報告しています。

well pic.twitter.com/sBHXyzGKDk

— Rebecca Baird-Remba (@thecitywanderer) April 18, 2022

そこでMotherboardの編集者であるSamantha Cole氏とTim Marchman氏は、さまざまなインタビューや演説でassistive writingを試してみたとのこと。すると、マーティン・ルーサー・キング・ジュニア(キング牧師)の有名なスピーチ「I Have a Dream」について、「the fierce urgency of now」という文章を「the intense urgency of now」と言い換えることを提案してきたほか、ジョン・F・ケネディの就任演説でも「for all mankind」を「for all humankind」に言い換えるよう警告したとのこと。

また、白人至上主義団体のクー・クラックス・クラン(KKK)の元最高幹部であるデービッド・デュークのインタビューでは、デュークが黒人への差別表現であるNワードを使ったり使ったり「黒人狩り」について話したりしているにもかかわらず、assistive writingは警告を出さなかったそうです。一方、ラディカル・フェミニストであるヴァレリー・ソラナスの「SCUMマニフェスト(男性皆殺し協会マニフェスト)」はデュークのインタビューより多くの警告を受け取っているほか、聖書の言葉遣いにもassistive writingは警告を発しているとCole氏は報告しています。

Motherboardの問い合わせに対し、Googleは「asssitive writingは言語理解モデルを使用しており、何百万もの一般的なフレーズや文章に依存して、人々のコミュニケーション方法を自動学習します。これはまた、assistive writingがいくつかの人間の認知バイアスを反映し得ることを意味しています」「私たちの技術は常に改善されており、不要な単語連想やバイアスを識別・軽減するための完全なソリューションはまだありません(今後もないかもしれません)」と述べました。

Cole氏は、確かに「Policemen」よりは「Police officers」の方が正確であり、「ブラックリスト」「マスター/スレイブ」というプログラミング用語を非人種差別的なものに言い換える試みも、技術用語における長年の偏見に対処する1つの方法だと認めています。しかし、それぞれの言葉は異なる意味や背景を持っているものであり、言葉を使用する人々は微妙な違いに自覚的となり、それを読者に伝えられるようにすることも重要だと指摘。「極端な言い方をすれば、誰かが人種差別的・性差別的・排他的な文章をGoogleドキュメントで書きたいのであれば、アルゴリズムがその意図を消して読者を混乱させようとするのではなく、本来の主張を書くことが許されるべきなのです」と主張しています。

また、「母親」「父親」といった二項対立的な要素から離れて思考したり、書いたりすることも重要な一方で、誰かの「母親」「父親」である人も現実に存在しており、自分の「母親」「父親」について書きたい人もそれを自覚するべきだとCole氏は指摘。「すでに深い欠陥があるとわかっており非知的な場合も多い機械学習アルゴリズムを使い、自己認識や感受性、慎重な編集を人々の文章に押し込めようとするのは見当違いです」と非難しました。

・関連記事

「ヘイトスピーチ検出AI」が逆に人種差別を助長する可能性がある - GIGAZINE

ヘイトスピーチは「言論の自由」で守られるべきなのか? - GIGAZINE

Googleが倫理的AIチームの研究者を新たに解雇したことが判明 - GIGAZINE

Googleが倫理的AIチームのテクニカルリーダーを解雇 - GIGAZINE

Googleが倫理的AIチームの研究者を解雇したことは「前例ない検閲」だとして非難集中、Google社員1200人以上が抗議文に署名 - GIGAZINE

「ブラックリスト」「マスター/スレイブ」というプログラミング用語が「人種差別的」として言い換えられつつある - GIGAZINE

「差別用語が含まれる」としてアメリカ全土の660以上もの地名が変更へ、当事者からは賛否両論 - GIGAZINE

「AIが差別発言しないかをAIでチェックする」というDeepMindの試み - GIGAZINE

SNSで特定の単語を規制することの何が問題なのか? - GIGAZINE

・関連コンテンツ

in ソフトウェア, Posted by log1h_ik

You can read the machine translated English article 'Hell-like annoyance' criticized for inp….