なんと397BのAIモデルをiPhoneで動かすことに成功

Appleのハードウェアと、外部ストレージからAIの「重み」をストリーミングするという手法を用い、パラメータ数が397B(3970億)の大型モデルをiPhoneで動作させるという試みが成功したことが分かりました。

Autoresearching Apple's "LLM in a Flash" to run Qwen 397B locally

https://simonwillison.net/2026/Mar/18/llm-in-a-flash/

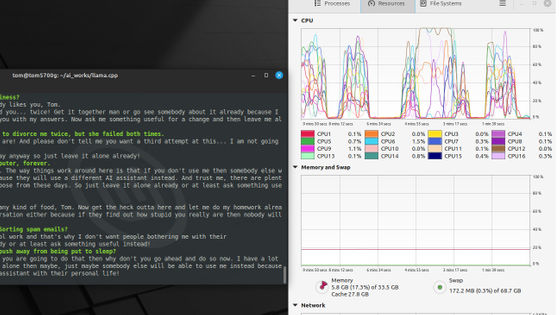

試みの発端となったのは、AI研究者ダン・ウッズ氏が実施した実験でした。ウッズ氏は、ハードウェアのDRAM容量要件を超えるLLM(大規模言語モデル)を効率的に実行するという課題に対して、モデルのパラメータを外部フラッシュメモリに格納し、必要に応じてDRAMに読み込むことで対処するという手法「LLM in a Flash」を採用。ディスク容量が209GB、RAMが48GBのMacBook Pro M3 Maxで、「Qwen3.5-397B-A17B」のカスタムバージョンを実行させることに成功しました。

Qwen3.5-397B-A17BはMoE(Mixture of Experts)アーキテクチャを採用していて、重みの一部だけで推論を実行することができるため、情報を全て同時にRAMで保持して実行する必要がなく、外部ストレージからのストリーミングで対応できるとのことです。

ウッズ氏は毎秒5.7トークンの処理速度と最大毎秒7.07トークンのスループットを実現し、約5.5GBの常駐メモリを使用しながら、本番環境レベルの出力品質を維持することに成功しました。

— Dan Woods (@danveloper) March 18, 2026

この情報を元に、AI研究者のANEMLL氏がiPhone 17 Proで同様の実験を行ったところ、毎秒0.7トークンで処理することに成功したそうです。これにはウッズ氏も思わず「WHAT.」と驚きの声を寄せました。

WHAT.

— Dan Woods (@danveloper) March 23, 2026

なお、ウッズ氏によると、処理のために必要なコードはすべてClaudeが記述したもので、ウッズ氏はアイデアと参考資料を提供しただけだそうです。LLM in a Flashや動作に必要なハードウェアは以前からあったものの、専門分野ではないので手を出せずじまいだったそうですが、2026年2月に登場したClaude Opus 4.6が優秀で、今回実現に至ったとのことです。

・関連記事

信頼できるAIコーディングを実現するためのオープンソース証明検証基盤「Leanstral」をMistral AIがリリース、重大なボトルネック「人間によるレビュー」の克服を目指す - GIGAZINE

NVIDIAが1200億パラメータ規模の日本語対応ハイブリッドMoEオープンウェイトAIモデル「Nemotron 3 Super」を発表 - GIGAZINE

Claudeで自分のPCを操作できる新機能やスマホからPC上のClaudeに指示できる新機能が登場 - GIGAZINE

無料でローカルAIモデルのメモリ使用量を最大80%削減し処理速度を2倍に向上させる「Unsloth Studio」、Windows・macOS・Linux対応でチャットだけならCPUのみでもOKでスマホでも動作可能 - GIGAZINE

「iPhone 17」の外観を詳しくチェックしてみた、ProやAirと比べてオーソドックスな無印モデル - GIGAZINE

・関連コンテンツ

in AI, スマホ, Posted by log1p_kr

You can read the machine translated English article We have successfully managed to run the ….