Googleがスパース推論でニューラルネットワークの高速化を達成したと報告

Googleがモバイル向けの機械学習用ソフトウェアライブラリTensorFlow Liteとニューラルネットワーク推論最適化ライブラリのXNNPACKにさらなるスパース化最適を組み込むことで、推論速度を大幅に向上させたと報告しました。

Google AI Blog: Accelerating Neural Networks on Mobile and Web with Sparse Inference

https://ai.googleblog.com/2021/03/accelerating-neural-networks-on-mobile.html

「スパース(Sparse)」とは「スカスカ」を意味する英単語です。ビッグデータなどの解析においては「データ全体は大規模だが、意義のあるデータはごく一部しかない」という状況がよくあります。スパースモデリングは、こうした性質を持つデータを取捨選択して意義のあるデータのみを解析するという方法論で、MRIやX線CTの解像度向上や、立体構造計算の高速・高精度化などに用いられています。

Googleが新たに発表したのは、モバイル向けの機械学習用ソフトウェアライブラリTensorFlow Liteとニューラルネットワーク推論最適化ライブラリのXNNPACKをアップデートし、さらなるスパース化最適を実現したという報告です。この新たなアップデートで解析対象となるモデルがスパースであるか否かを検出できるようになり、推論速度の大幅な向上を達成することが可能となります。

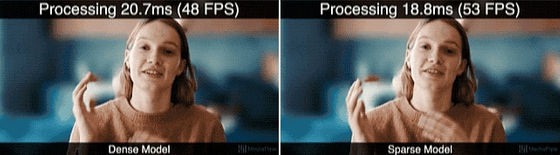

ビデオ会議アプリのGoogle Meetのリアルタイム処理においては、以下の画像のように旧来のモデル(左側)よりもスパース化モデル(右側)は低処理時間・高FPSを実現していることがわかります。Googleによると、前景に来る被写体の画質品質を維持しながら70%のスパース化を行うことで、処理速度を30%も高速化することに成功したとのこと。

同様に、手の形状検出モデルであるMediaPipe Handsにおいても、スパース化によって50%の処理速度向上を達成したとのこと。以下の画像は左が旧来のモデルで、中央が「蒸留(distillation)」という高度なAIの入力と出力をシンプルなAIに学習されたモデル、右側がスパース化モデル。旧来のモデルでは処理速度が60ms前後ですが、スパース化モデルは蒸留モデルよりわずかに速い25ms弱という処理速度に達しています。

Googleはスパース化がニューラルネットワークのCPU推論を改善するシンプルかつ強力な手法であるとして、今後もこの種の研究を続ける予定だと述べています。

・関連記事

Google傘下のDeepMindがゲームのルールを教えられなくても勝ち方を勝手に学習していくAI「MuZero」を発表 - GIGAZINE

3kbpsという低いビットレートでも高音質を実現するコーデック「Lyra」をGoogleが開発 - GIGAZINE

Googleが開発した「改ざん不可能なログシステム」を構築できる「Trillian」とは? - GIGAZINE

Googleのエンジニアが人間がコーディングを行うよりも高速で自己進化するAI「AutoML-Zero」を発表 - GIGAZINE

・関連コンテンツ

in ソフトウェア, Posted by darkhorse_log

You can read the machine translated English article Google reports that sparse inference has….