OpenAIが「GPT-5.4」をリリース、人間より上手にPCを操作できる「エージェント性能に優れた最も有能で効率的なフロンティアモデル」

OpenAIが専門的な業務に特化して設計された最新のフロンティアモデルであるGPT-5.4を2026年3月5日にリリースしました。このモデルはChatGPT、API、Codexを通じて展開され、推論やコーディング、自律的なエージェントとしてのワークフローにおける成果が一つのモデルに集約されています。より高度な推論を行う「GPT-5.4 Thinking」や、複雑なタスクで最高の性能を発揮する「GPT-5.4 Pro」も同時に発表されており、これらは特に知識労働やプロフェッショナルな実務において高い能力を発揮するように構築されています。

Introducing GPT-5.4 | OpenAI

https://openai.com/index/introducing-gpt-5-4/

OpenAIは3月4日にGPT-5.3 Instantを発表しました。この時にOpenAIはX(旧Twitter)で「GPT-5.4は思っているより早くリリースされる」と示唆していました。

5.4 sooner than you Think.

— OpenAI (@OpenAI) March 3, 2026

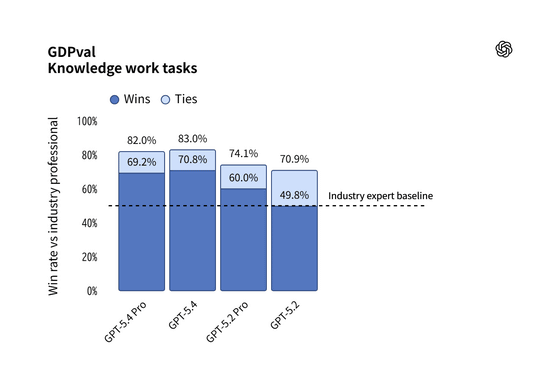

GPT-5.4は実世界の業務における正確性と効率性を重視しており、スプレッドシートやプレゼンテーション、文書作成などのツールを跨いだ操作が大幅に改善されているとのこと。44の職業にわたる知識労働の質を評価するGDPvalベンチマークにおいて、GPT-5.4は83.0%というスコアを記録し、前モデルであるGPT-5.2の70.9%を大きく上回る成果を示しました。OpenAIはGPT-5.4について「プロフェッショナルな仕事のための最も有能で効率的なフロンティアモデル」と評価しています。

また、投資銀行のアナリストが行うようなモデリングタスクでも87.3%の平均スコアを達成し、従来の68.4%から精度を向上させているとのこと。さらに、ファクトチェック性能についても強化が図られており、ユーザーが事実と異なるプロンプトを入力した際に、事実と異なる返答をする確率は33%低下し、回答全体の誤り率はGPT-5.2比で18%改善されました。さらにOpenAIはChatGPTをワークブックに直接取り込むExcelアドインとして、「ChatGPT for Excel」のベータ版をリリースしています。

ARC-AGI-2の結果は以下の通り。

GPT-5.4 and GPT-5.4 Pro from @OpenAI on ARC-AGI Semi Private

— ARC Prize (@arcprize) March 5, 2026

ARC-AGI-2:

- GPT-5.4: 74.0%, $1.52/task

- GPT-5.4 Pro: 83.3%, $16.41/task pic.twitter.com/vpBlCIDrUb

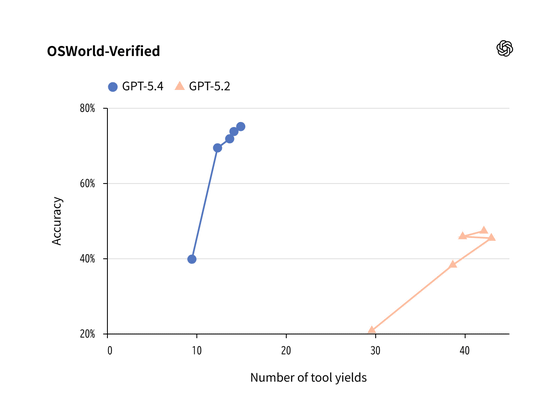

今回のアップデートにおける特筆すべき点として、汎用モデルとして初めてネイティブなコンピューター操作機能を備えたことが挙げられます。デスクトップ環境をスクリーンショットや入力デバイスを通じて操作する能力を測るOSWorld-Verifiedでは、人間の平均的な成功率である72.4%を超える75.0%のスコアを達成しました。

視覚認識能力も飛躍的に向上しており、最大1024万(10.24M)ピクセルや長辺6000ピクセルの高解像度画像を、本来の解像度のままで知覚する「フルフィデリティ」で処理することが可能です。これにより、開発者はWebサイトやソフトウェアシステムを横断して実務を完結させるエージェントをより高い信頼性で構築できるようになりました。

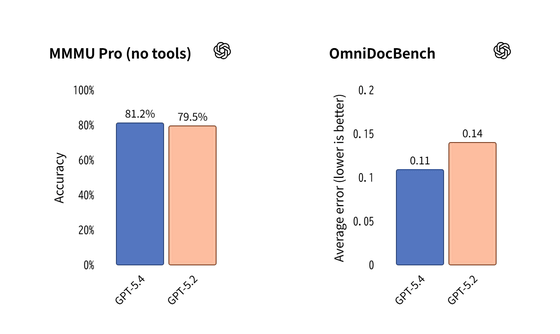

視覚的な理解と推論を測定するベンチマークであるMMMU-Proにおいて、GPT-5.4はツールを使用しない状態で81.2%の成功率を達成し、GPT-5.2の79.5%から確実な進歩を遂げました。OmniDocBenchでは、推論努力なしのGPT-5.4は平均誤差0.109を達成し、GPT-5.2の0.140から改善しました。これはフルフィデリティでの知覚をサポートする新しい画像入力レベルの導入によって支えられているとOpenAIはアピールしています。

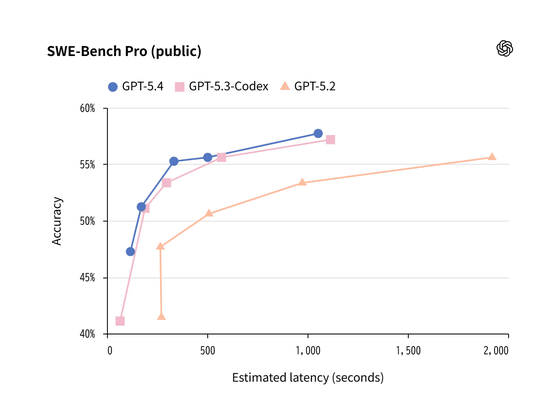

コーディング能力においては、GPT-5.4はGPT-5.3-Codexの強みを取り入れています。SWE-Bench Proでは、GPT-5.4はGPT-5.3-Codexと同等またはそれ以上の性能を発揮しながら、推論処理全体のレイテンシを低く抑えることに成功したとのこと。また、Codexに新しく導入された/fastモードを使用することで、モデルの知能を維持したまま最大1.5倍のトークン速度で処理を行うことが可能です。

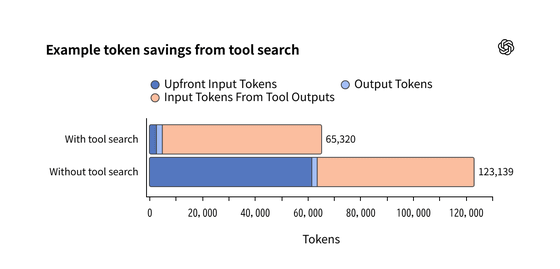

さらに大規模なツールセットを扱う際の効率を改善するため、APIにツール検索機能が導入されました。これは従来のように全てのツール定義をプロンプトに含めるのではなく、必要に応じて定義を動的に取得する仕組みで、トークン使用量を47%削減しながらも精度を維持できることをMCP Atlasベンチマークで実証したとOpenAIは報告しています。

さらに、Codexでは実験的に100万(1M)トークンのコンテキストウィンドウをサポートし、長期的なタスクの計画と実行、検証を可能にしているほか、ウェブアプリの視覚的なデバッグを行うPlaywright Interactiveなどの新しいスキルも提供されています。

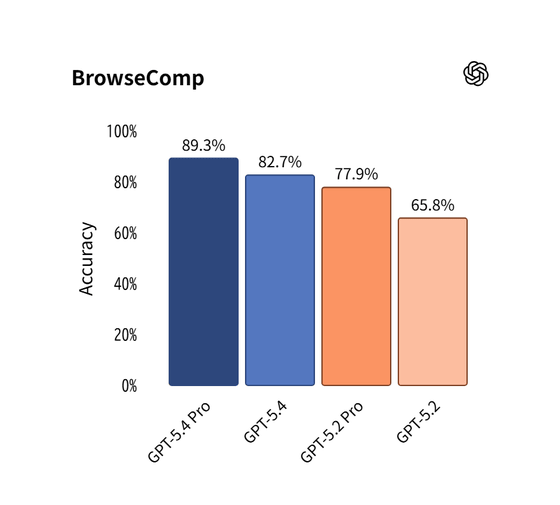

そして、OpenAIはGPT-5.4が自律的なエージェントによるウェブ検索およびブラウザ操作能力において大幅な向上を遂げていると述べています。見つけにくい情報をウェブ上で粘り強く探索する能力を測定するベンチマークであるBrowseCompにおいて、GPT-5.4はGPT-5.2と比較して絶対値で17%上回るスコアを記録しました。さらに、最上位モデルであるGPT-5.4 Proは89.3%という数値を達成し、新たな世界最高水準を確立しています。

OpenAIはGPT-5.4の展開にあたり、GPT-5.3-Codexで導入された安全策をさらに改善し、高いサイバー能力を持つモデルとして適切な保護措置を講じていると述べています。これには監視システムや信頼されたアクセス制御、ゼロデータ保持(ZDR)環境におけるリスクの高いリクエストに対する非同期ブロッキングなど、拡張されたサイバー安全スタックが含まれるとのこと。

また、思考の連鎖(CoT)の監視可能性に関する研究も継続されており、新しく導入されたCoT制御性の評価において、GPT-5.4 Thinkingは自身の推論を意図的に隠蔽する能力が低いことが示されました。これは安全性の観点からは肯定的な特性であり、CoT監視が依然として有効なツールであることが示されるとOpenAIは述べました。

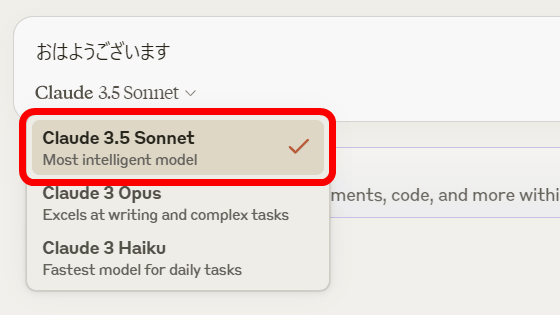

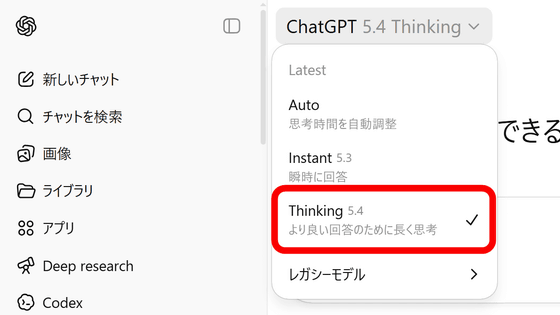

GPT-5.4は3月6日(金)よりChatGPTおよびCodexを通じて段階的に展開されており、APIでは「gpt-5.4」として利用可能です。ChatGPTにおいては、Plus、Team、Proの有料プランユーザーに対してGPT-5.4 Thinkingの提供が開始され、従来のGPT-5.2 Thinkingを置き換える形となります。なお、旧モデルとなったGPT-5.2 Thinkingは、2026年6月5日に廃止されるまで、レガシーモデルとして3カ月間提供が継続されます。さらに高性能なGPT-5.4 Proについては、ProおよびEnterpriseプランで利用できるほか、APIでも「gpt-5.4-pro」として提供されています。

APIでの利用料金は、その高い能力を反映してGPT-5.2と比較して高めに設定されており、gpt-5.4の入力価格は100万トークンあたり2.50ドル(約375円)、キャッシュされた入力は0.25ドル(約37.5円)となっています。最上位モデルであるgpt-5.4-proの入力価格は100万トークンあたり30ドル(約4500円)です。また、APIではバッチ処理やフレックスプライシングを利用することで標準料金の半額で利用できる一方、優先処理を選択した場合は2倍の料金が適用されます。

なお、GPT-5.4は以前のモデルよりもトークン効率が大幅に向上しており、同じ問題を解く際により少ないトークン量で済むため、最終的な総コストの削減に寄与するとOpenAIは論じています。

・関連記事

「GPT-5.3 Instant」が登場、ChatGPTの余計な前置きが減ってウェブ検索機能も強化される - GIGAZINE

GPT-5.2&Claude Sonnet 4&Gemini 3 Flashは戦争ゲームをプレイすると一切降伏せず95%のケースで核兵器を使用 - GIGAZINE

研究者がOpenAIのGPT-5.2 Proを使って量子重力に関する新たな発見に成功 - GIGAZINE

OpenAIが超高速コーディングAI「GPT-5.3-Codex-Spark」を発表、NVIDIA以外のAIチップで高速動作を実現しリアルタイムコーディングを可能に - GIGAZINE

日本語能力を強化したAI「GPT-OSS Swallow」と「Qwen3 Swallow」を東京科学大の研究チームが公開 - GIGAZINE

・関連コンテンツ

in AI, Posted by log1i_yk

You can read the machine translated English article OpenAI releases 'GPT-5.4,' 'the most cap….