「AIエージェントを使う人間たちはAIにどれだけの権限を与えているのか」をAnthropicが報告

Anthropicが自社のコーディングエージェントであるClaude Codeや公開APIを通じた数百万件の対話データを分析し、AIエージェントが実社会でどのように自律性を発揮しているかについての調査報告を2026年2月18日に発表しました。

Measuring AI agent autonomy in practice \ Anthropic

https://www.anthropic.com/research/measuring-agent-autonomy

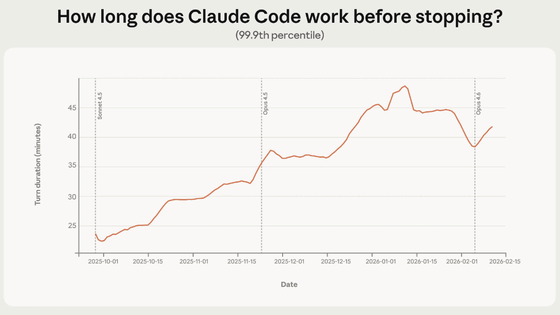

調査の結果、Claude Codeのセッションにおいてエージェントが人間の介入なしに働き続ける時間は顕著な増加傾向にあることが分かりました。特に稼働時間の長い上位0.1%のセッションにおいて、エージェントが停止するまでの時間(縦軸)は2025年10月から2026年1月(横軸)にかけて倍増しており、45分前後に拡大しています。この傾向は、Sonnet 4.5やOpus 4.5といった新モデルのリリース後も急激な変化ではなく緩やかに進んでいることから、単なるモデル性能の向上だけが要因ではなく、既存のモデルが実運用で発揮されている以上の自律性を備えていることを示唆しているとAnthropicは論じました。

また、Anthropicの内部利用データでも、最も困難なタスクにおける成功率が倍増する一方で、1セッションあたりの人間の介入回数は5.4回から3.3回へと減少しており、自律性と実用性が同時に向上している実態が確認されたとのこと。

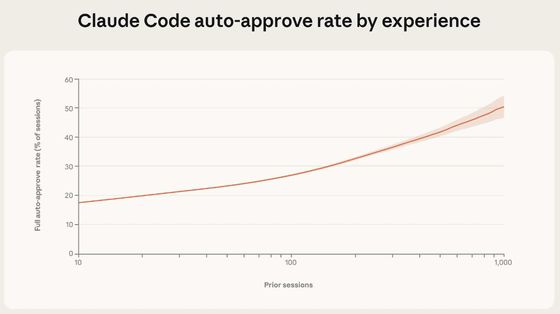

さらに、ユーザーがClaude Codeの利用に慣れるにつれて、エージェントにより大きな権限を与えるようになるという明確なパターンが見出されました。セッション数(横軸)が少ない新規ユーザーの場合、全てのアクションを自動承認する設定を使用する割合(縦軸)は約20%に留まりましたが、セッション数が750回を超える熟練ユーザーではその割合が40%を超えたとのこと。これはツールへの信頼が着実に蓄積されていることを示しています。

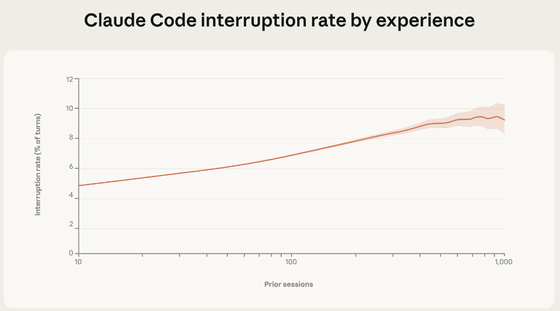

一方で、熟練ユーザーは自動承認を増やすと同時に、エージェントの動作を中断して介入する頻度も高くなっており、介入率(縦軸)を見るとセッション数(横軸)が少ない新規ユーザーは5%程度ですが、セッション数の多い熟練ユーザーでは約9%に達していたことがわかりました。これは、初心者は個々のアクションを事前に一つずつ承認する「事前承認型」の監視を行うのに対して、経験豊富なユーザーはエージェントを自律的に動かしつつ、問題が生じた際に即座に介入する「能動的モニタリング型」の戦略をとっているからだとAnthropicは考察しています。

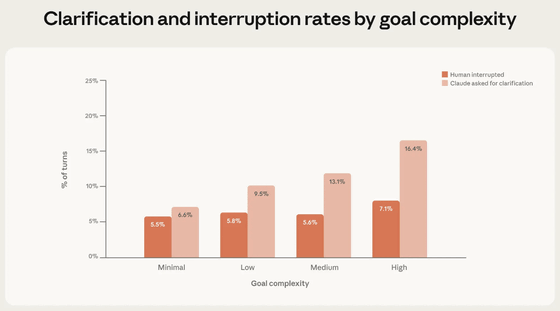

そして、自律性は人間側だけで決まるものではなく、AI自身も自身の不確実性を認識して自律性を制限しています。Claude Codeは、タスクが複雑になるほど自ら停止して人間に説明を求める頻度が高くなり、最も複雑なタスクでは人間が介入する頻度の2倍以上の回数で質問を投げかけています。

エージェントの利用はソフトウェアエンジニアリングが中心であり、公開APIにおけるツール使用アクションの約50%を占めています。しかし、バックオフィス自動化やマーケティング、財務、さらには医療・ヘルスケアといった多様な領域での実験的な活用も始まっています。

リスクの観点では、現状のAPIアクションの80%には権限制限や人間による承認といった「保護策」が適用されており、取り消し不可能なアクションは全体の0.8%に過ぎません。ただし、金融取引の実行や医療記録の更新、セキュリティ上の特権昇格といった、リスクと自律性が共存するフロンティア領域での活用も少数ながら確認されています。これらの多くは現時点では評価やレッドチーム演習によるシミュレーションであると推測されていますが、今後エージェントが社会の重要なインフラへと浸透するにつれ、リスクと自律性の境界線が拡大していくことが予想されるとAnthropicは述べました。

Anthropicは今回の調査結果に基づき、「安全なAIエージェントの展開には、事前の性能評価だけでなくデプロイ後の継続的な監視インフラが不可欠である」と結論付け、「モデル開発者はAIが自身の不確実性を認識できるようにトレーニングすべきであり、製品開発者はユーザーが全てのアクションを一つずつ承認することを強制するのではなく、エージェントの行動を透明化し、必要な時に素早く介入できる設計を優先すべきだ」としています。

また、Anthropicは法規制についても、「特定の対話パターンを義務付けることは熟練ユーザーの利便性と安全性を損なう可能性があるため、人間が効果的に介入できる立場にあるかどうかに焦点を当てるべきである」と提言しました。

・関連記事

FigmaとAnthropicが「Code to Canvas」をリリース、Claude Codeで生成されたコードを編集可能なデザインとしてFigmaに直接インポートできるように - GIGAZINE

Anthropicが東京に続くアジア第2の拠点をインド・ベンガルールに開設 - GIGAZINE

国防総省がAnthropicを「サプライチェーンリスク」に指定して請負業者に取引中止を求めることも検討 - GIGAZINE

AI企業のAnthropicが4兆6000億円の資金調達に成功、Claude Codeが好調で収益は毎年10倍以上増加 - GIGAZINE

AnthropicがClaude Opus 4.6のリサーチプレビュー版に高速モードを導入、2.5倍高速だが価格は6倍 - GIGAZINE

AnthropicがClaude Opus 4.6を発表、コーディングだけでなく財務処理や文書作成の性能も向上&最大100万トークンのコンテキストウィンドウに対応 - GIGAZINE

・関連コンテンツ

in AI, Posted by log1i_yk

You can read the machine translated English article Anthropic reports on 'How much authority….