DeepSeekはどのようにしてOpenAIの3%のコストでo1を超えたのか?

中国のAI企業・DeepSeekが2025年1月にリリースしたオープンソースモデル「DeepSeek R1」はAI業界に衝撃をもたらし、そのインパクトは株式市場をも揺るがしています。特に注目されているR1のコストパフォーマンスについて、IT系ニュースサイトのVentureBeatが掘り下げました。

DeepSeek-R1’s bold bet on reinforcement learning: How it outpaced OpenAI at 3% of the cost | VentureBeat

https://venturebeat.com/ai/deepseek-r1s-bold-bet-on-reinforcement-learning-how-it-outpaced-openai-at-3-of-the-cost/

R1の特徴はその運用コストの安さで、OpenAIのo1のコストが100万入力トークンあたり15ドル(約2330円)、100万出力トークンあたり60ドル(約9330円)なのに対し、R1に基づいたモデルであるDeepSeek Reasonerのコストは100万入力トークンあたり0.55ドル(約85円)、100万出力トークンあたり2.19ドル(約340円)と、それぞれo1の約3.6%ほどしかかかりません。

VentureBeatは、R1が達成したブレークスルーのひとつは「純粋な強化学習への移行」にあるとしています。

一般的に、現行の大規模言語モデル(LLM)のトレーニングには、教師あり微調整(supervised fine-tuning:SFT)という手法が用いられています。これは、厳選されたデータセットでモデルをトレーニングし、思考の連鎖(chain-of-thought:CoT)と呼ばれる段階的な推論で学習させるもので、モデルの推論能力の向上には不可欠とされてきました。

しかし、R1はSFTをほとんど使わずほぼ強化学習のみでR1をトレーニングしました。このアプローチにより、モデルは複雑な問題に追加の処理時間を割り当て、難易度に基づいてタスクを優先順位付けするという、予期せぬ能力を発展させました。

DeepSeekの研究者は技術レポートの中で、この現象を「アハ体験(Aha moment)」と呼んでいます。

開発の最終段階で限定的にSFTが用いられましたが、DeepSeekがほとんど強化学習だけでパフォーマンスを大幅に向上させた点を、VentureBeatは高く評価しました。

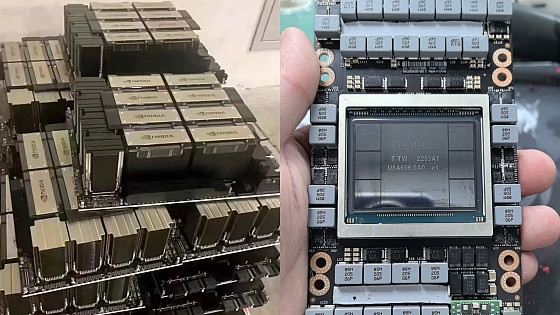

もう1つの注目点が、わずかなマシンパワーで開発された点です。DeepSeekは中国のヘッジファンドであるHigh-Flyer Quantを前身として2023年に設立された企業で、High-Flyer Quantはアメリカの輸出規制が発動される前に1万枚のNVIDIA製GPUを確保し、規制強化後は代替ルートを通じてGPUを5万枚まで拡大させました。

こうして調達されたGPUは、規制に準拠するためにチップ間の転送速度を落としたNVIDIA H800であるとされている一方、一部報道では「中国は規制を回避して高度なチップを国内に持ち込んでいる」とも伝えられています。

中国のブローカーがアメリカの規制を回避してAI研究用チップを中国に持ち込む方法 - GIGAZINE

とはいえ、いずれにせよ5万枚という数は、OpenAI・Google・Anthropicなどの大手AIラボが50万枚を超えるGPUでAIを運用しているのと比べると非常に少ないと言えます。

VentureBeatは「限られたリソースで競争力のある結果を出したDeepSeekの能力は、最先端のLLMをトレーニングするという高コストのパラダイムに、創意工夫と機転がどこまで挑戦できるかを浮き彫りにしました」と述べました。

また、重み付けが公開されているオープンウェイトモデルであるという点も、R1が注目を集める理由のひとつです。主要なオープンソースモデルとして先行しているMetaのLlamaでさえ、プロンプトで積極的に指示しなければCoTの過程を表示しませんが、R1はデフォルトで回答のCoTを透過的に表示するとのこと。

とはいえ、技術レポートで研究結果が明かされているということは、競合モデルがすぐにそれを採り入れて追いつくことができるということでもあるため、R1のイノベーションは圧倒的なリードを確立する武器にはなりません。VentureBeatによると、MetaやMistral AIなどのオープンソースモデル企業であれば数カ月でキャッチアップできるとみられているとのこと。

また、R1には天安門事件で中国政府が行った残忍な弾圧に関する質問に答えないことなど、倫理的な問題も指摘されています。

多くの開発者は、こうしたバイアスはエッジケース、つまり極端な例であり、微調整によって軽減できると考えています。例えば、MetaのLlamaはデータセットが公開されておらず、隠れた偏見があるとの非難や著作権侵害訴訟などに直面していますが、相変わらず人気のオープンモデルであり続けています。

Metaのマーク・ザッカーバーグCEOがAI「Llama」の開発チームに対し著作権で保護された作品の無断使用を許可したと訴訟で追及される - GIGAZINE

VentureBeatは、OpenAIやOracle、ソフトバンクなどが主導している巨額AI投資計画「Stargate Project」と、低コストAIを実現したDeepSeekを対比させて、「Stargate Projectは、汎用(はんよう)人工知能(AGI)の実現には前例のない計算リソースが必要だという信念に基づいていますが、DeepSeekがわずかなコストで高性能モデルを実証したことは、このアプローチの持続可能性にとっての試練であり、膨大な投資に見合った成果を出すOpenAIの能力に疑問を投げかけるものです」と述べました。

・関連記事

DeepSeekが「大規模な悪意のある攻撃」を受けて新規ユーザー登録を制限中 - GIGAZINE

DeepSeekの登場で株価が下落したNVIDIAが「DeepSeekの推論にも相当のNVIDIAチップが必要」と主張し自社の価値をアピール - GIGAZINE

中国のAI「DeepSeek」ショックでハイテク株がパニック売りに、NVIDIAの時価総額が91兆円消し飛んで暴落記録を2倍以上更新 - GIGAZINE

DeepSeekが画像生成モデル「Janus Pro」をMITライセンスで公開、DALL-E 3を超える性能と自負 - GIGAZINE

DeepSeekのAIモデル「DeepSeek-R1」は天安門広場や台湾、ウイグル族の扱いなどのデリケートな話題に対して中国政府の制限を順守している - GIGAZINE

中国のAI開発企業「DeepSeek」が急速に台頭してテクノロジー業界で話題に、App Storeの無料アプリランキングでも1位を獲得 - GIGAZINE

・関連コンテンツ

in AI, ソフトウェア, Posted by darkhorse_log

You can read the machine translated English article How did DeepSeek surpass OpenAI's O1….