Googleが映像と音声を理解して質問に答えるGPT-4oっぽいAIエージェント「Project Astra」を発表

Googleが現地時間の2024年5月14日に開催した開発者向けイベントの「Google I/O」で、映像や音声を理解してリアルタイムで質問に答えてくれるAIエージェント「Project Astra(Astra)」を発表しました。実際に、ユーザーがスマートフォンとスマートグラスのカメラで撮影した物事について、Astraにあれこれ質問しているデモ動画も公開されています。

Google Gemini updates: Flash 1.5, Gemma 2 and Project Astra

https://blog.google/technology/ai/google-gemini-update-flash-ai-assistant-io-2024/

Google strikes back at OpenAI with “Project Astra” AI agent prototype | Ars Technica

https://arstechnica.com/information-technology/2024/05/google-strikes-back-at-openai-with-project-astra-ai-agent-prototype/

現地時間の5月13日、OpenAIが音声や視覚情報を高速で処理してリアルタイムで応答する新たなAIモデル「GPT-4o」を発表し、大きな話題を呼びました。この翌日に開催されたGoogle I/Oで、日常生活に役立つユニバーサルAIエージェント開発の一環としてGoogleはAIエージェントのAstraを発表しました。

GoogleのAI部門であるGoogle DeepMindのデミス・ハサビス氏は、「Google DeepMindは人類に利益をもたらすため、責任を持ってAIを構築するというミッションの一環として、日常生活に役立つユニバーサルAIエージェントを開発したいと常々考えてきました。そこで本日は、Project Astra(advanced seeing and talking responsive agent:見たり話したりできる高度な応答エージェント)によるAIアシスタントの未来の進捗(しんちょく)状況を共有します」と述べています。

実際に、ユーザーがスマートフォンとスマートグラスのカメラで周囲を撮影しながら、Astraにあれこれ質問している様子は以下のデモ動画で確認可能です。

Project Astra: Our vision for the future of AI assistants - YouTube

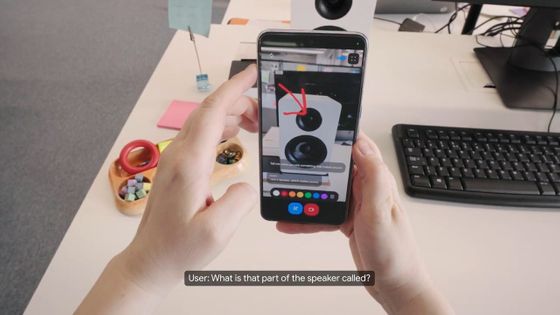

スマートフォンのカメラとマイクをオンにして、ユーザーが「何か音を出す物を見かけたら教えてください」とAstraに呼びかけます。

カメラの視界にスピーカーが映ると、「音を出すスピーカーが見えます」とAstraがすぐに反応しました。

続いてユーザーはカメラの映像に矢印を書き込み、スピーカー上部の音が出る部分について「スピーカーのこの部分は何と呼ばれますか?」と尋ねます。

するとAstraは、「それはツィーターです。高周波の音を発生させる部分です」と回答しました。

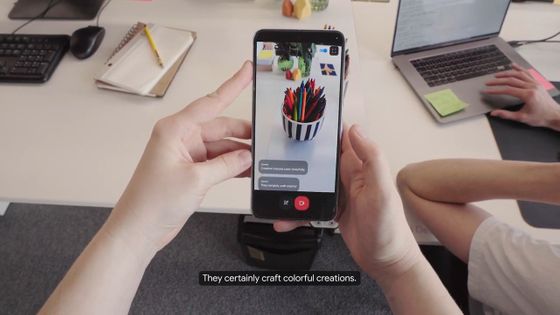

今度はペン立てに刺さったクレヨンを映し、「これらについて、クリエイティブに韻を踏んでください」と呼びかけたところ、Astraは「Creative crayons color cheerfully. They certainly craft colorful creations.(クリエイティブなクレヨンは陽気に色をつける。彼らは確かにカラフルな作品を作る。)」という韻を踏んだ詩のような文章を読み上げました。

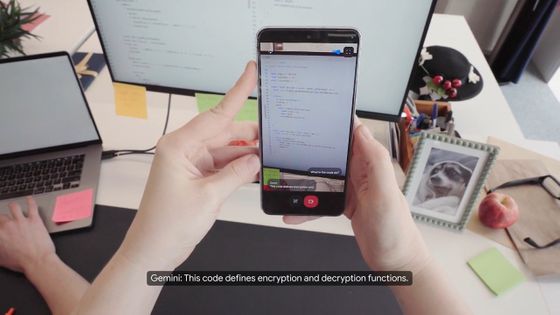

また、PC画面に映ったコードがどのような動作をするのか尋ねると、Astraは暗号化関数と復号化関数を定義するものだと回答。

窓の外の景色を映して「私はどこの地域にいると思いますか?」と聞いてみたところ、Astraは「ここはロンドンのキングスクロス地区のようです。この場所は鉄道駅と交通機関の接続で知られています」と答えました。

さらにユーザーは、「私のメガネをどこで見たか覚えていますか?」と意外な角度の質問も投げかけます。

かなり難しそうに思えましたが、Astraは「ええ、見ました。あなたのメガネは机の上、赤いリンゴの近くにありました」と回答。確かに赤いリンゴの近くにスマートグラスが置かれていました。

今度は装着したスマートグラスのカメラで周囲を映しながら、Astraにあれこれ話しかけます。

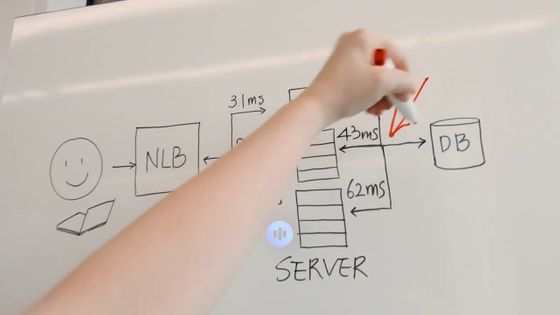

ホワイトボードの図式に書き込んで「このシステムを高速化するために、ここに何を追加できますか?」と尋ねると、Astraは「サーバーとデータベースの間にキャッシュを追加すると、速度が向上する可能性があります」と回答。

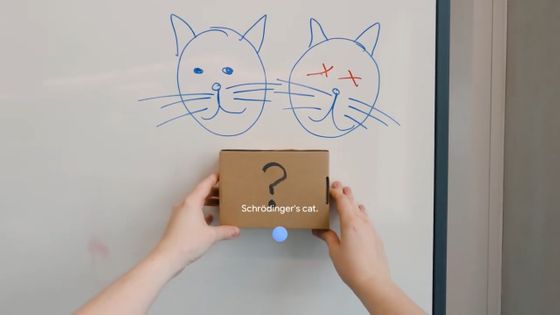

さらに、ホワイトボードに描かれた2匹のネコの顔の間に「?」マークが記された箱を配置し、「これを見て何を思い出しますか?」と質問。ちょっとしたなぞなぞのような問いかけでしたが、Astraは「シュレーディンガーの猫」と答えました。

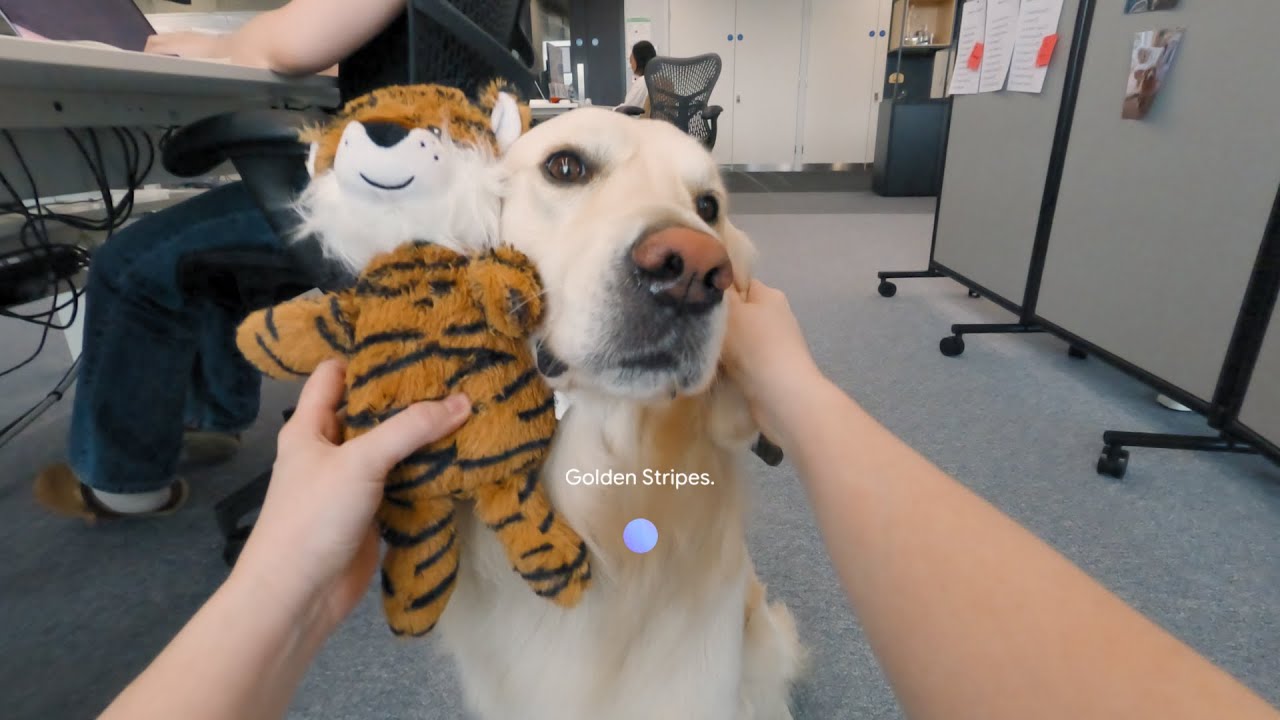

トラのぬいぐるみとイヌを見せて「このデュオのバンド名を教えてください」と尋ねたところ、「ゴールデンストライプス」という答えが返ってきました。まるで人間と会話しているような自然な応答がリアルタイムで可能となっています。

Project Astraではビデオフレームを連続的にエンコードし、動画と音声入力を組み合わせてイベントのタイムラインに結合し、キャッシュ化した情報を効率的に呼び出して高速な情報処理を可能にしているとのこと。また、最先端の音声モデルを使用して声の響きを向上させ、イントネーションの幅も広がったそうです。

ハサビス氏は、「このようなテクノロジーにより、人々がスマートフォンやスマートグラスを通して、専門のAIアシスタントをそばに置いておく未来を思い描くのは簡単です。また、Geminiアプリやウェブエクスペリエンスなど、これらの機能の一部は今年中にGoogleのサービスに搭載される予定です」とコメントしました。

・つづき

映像や音声を理解してリアルタイムで質問に答えてくれるGoogle製AIアシスタント「Project Astra」をスマホやスマートグラスで使いまくるデモ動画が公開中 - GIGAZINE

・関連記事

OpenAIが「GPT-4o」を発表、人間と同等の速さでテキスト・音声・カメラ入力を処理可能で「周囲を見渡して状況判断」「数学の解き方を教える」「AI同士で会話して作曲」など多様な操作を実行可能 - GIGAZINE

OpenAIのAIモデル「GPT-4o」がチェスパズルで従来モデルの2倍以上の好成績をたたき出しランキングトップに - GIGAZINE

OpenAIが画像読み取り可能なAI「GPT-4 Turbo with Vision」を一般公開開始、JSONモードや関数呼び出しをサポート - GIGAZINE

Googleが「生成AIを使った検索機能」の有料化を検討している - GIGAZINE

GoogleがチャットAIのGeminiでマルウェアを分析し脅威レポートを要約するサイバーセキュリティツール「Google Threat Intelligence」を発表 - GIGAZINE

OpenAIが2024年5月13日にGoogleのライバルとなる「AI検索エンジン」を発表するとの報道 - GIGAZINE

・関連コンテンツ

in AI, 動画, ソフトウェア, ネットサービス, Posted by log1h_ik

You can read the machine translated English article Google announces 'Project Astra,' a GPT-….