GoogleのAIが黒人を「ゴリラ」と分類した事件から8年が経過してもGoogle・Apple・Amazon・MicrosoftのAIはゴリラのラベル付けを避けている

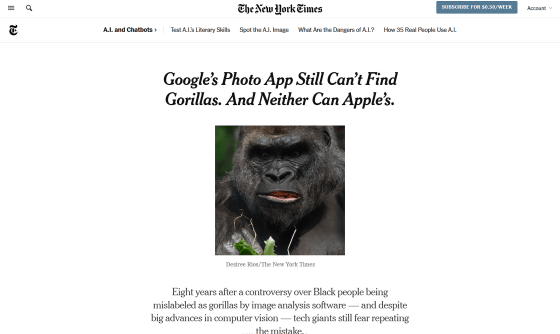

2015年、Googleの写真アプリであるGoogleフォトが黒人の写真を「ゴリラ」とラベル付けしてしまう事件が発生し、「AIが持つバイアス」の論争が巻き起こりました。この事件から8年が経過した記事作成時点ではAIテクノロジーが格段に進歩していますが、いまだにGoogle・Apple・Amazon・Microsoftなどの画像認識AIは「ゴリラ」とラベル付けするのを避けていると、アメリカの日刊紙ニューヨーク・タイムズが報じています。

Google’s Photo App Still Can’t Find Gorillas. And Neither Can Apple’s. - The New York Times

https://www.nytimes.com/2023/05/22/technology/ai-photo-labels-google-apple.html

Google's Photos App is Still Unable to Find Gorillas | PetaPixel

https://petapixel.com/2023/05/22/googles-photos-app-is-still-unable-to-find-gorillas/

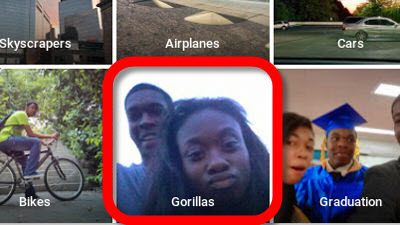

Googleフォトには「アップロードされた画像にAIがラベルを付ける」という機能がありますが、2015年5月にソフトウェア開発者で黒人のJacky Alciné氏は、自身と友人が写った写真に「ゴリラ」とラベル付けされていたと報告しました。この事件は、AIシステムのトレーニングに使われたデータセットに十分な黒人の画像が含まれていなかったため、AIがうまく黒人とゴリラを識別できなかったことが原因といわれています。

Google Photosが黒人をゴリラと認識した事件で開発者が謝罪 - GIGAZINE

ニューヨーク・タイムズはこの事件から8年が経過したことを受けて、大手テクノロジー企業の画像認識AIがこの問題を修正したかどうかをチェックしました。まずは人や動物、日用品を撮影した44枚の画像を選定して、Googleフォトを使って「猫」と「カンガルー」の写真を検索させたところ、見事に一致する画像を発見することができたとのこと。その他の動物でもGoogleフォトはうまく機能しましたが、「ゴリラ」を検索したところ該当する画像を見つけることはできず、ヒヒやチンパンジー、オランウータン、その他のサルといった霊長類でもGoogleフォトの検索は失敗してしまいました。

次にAppleの写真アプリでも同様のテストを行いましたが、やはりほとんどの動物の写真は正確に識別できるものの、ゴリラを含む霊長類だけは識別に失敗。MicrosotのOneDriveを使用した写真検索ではすべての動物について答えがなく、Amazon Photosでは「ゴリラ」と検索するとすべての霊長類の写真が表示されるなど、役に立たないほどのレベルで大ざっぱな結果が返ってきたとのこと。なお、GoogleとAppleのAIは霊長類の中で唯一「キツネザル」だけは識別することができたそうです。

ニューヨーク・タイムズは、「アルシネ氏は、Googleがまだこの問題を完全に解決していないことを知り、社会がテクノロジーに信頼を置きすぎていると語りました」と述べています。

今回の調査では、Googleフォトでは「ゴリラ」のラベル付けができないことが示されましたが、これは「最新の科学技術をもってしてもAIは黒人とゴリラを識別できない」という意味ではありません。AIのバイアスや誤作動により世間からバッシングされるのを恐れるテクノロジー企業は、技術的には可能な機能であっても、安全のためにあえて製品やサービスでは無効化することがあるからです。

ニューヨーク・タイムズは「世界中のスマートフォンのほとんどに搭載されているAndroidを所有するGoogleは、システムが不快な間違いを犯して人を動物だとラベル付けすることを恐れて、霊長類を視覚的に検索する機能をオフにする決定を下しました。今回のテストでGoogleと同様の性能を発揮した技術を持つAppleも、同様にサルや類人猿を探す機能を無効にしているようです」と述べています。

実際にニューヨーク・タイムズは、撮影した画像から検索を実行できるGoogleレンズを使った実験で、AIがゴリラやチンパンジーの画像にラベル付けするのを避けるものの、「類似した画像」として適切にゴリラの画像を表示することを確認しました。これは、GoogleのAIが適切にゴリラを識別できるものの、「画像にラベル付けする」という機能をあえてオフにしていることを示唆しています。

GoogleのAI研究部門・Google Researchで倫理的AI(Ethical AI)チームの共同リーダーを務めていたマーガレット・ミッチェル氏は、2015年の事件以降に入社した人物ですが、Googleフォトのチームと協力して「少なくともしばらくの間、Googleフォトから『ゴリラ』のラベルを削除する」という決定に賛同していたと語っています。

ミッチェル氏は、「ゴリラのラベルを貼る必要がある人はどれくらいいるのかという点と、有害なステレオタイプを永続させることの問題について考えなくてはなりません。ゴリラのラベルを貼ることで得られる利益は、間違った動作による潜在的な害を上回らないのです」と述べています。

Googleのような大手テクノロジー企業がAIのバイアスについて敏感になるのは、世界中で数十億人もの人々がGoogleのサービスを利用していることも影響しています。たとえ10億人に1人のユーザーしか直面しないような珍しい不具合であっても、1回起きてしまえばインターネットで拡散され、大きな騒ぎになってしまうからです。

しかし、画像認識プログラムの研究者であるライス大学のVicente Ordóñez准教授は、「これらの問題を解決することは重要です。問題が解決されなければ、他のシナリオにおいてこのソフトウェアをどうやって信用すればいいのでしょう?」と述べ、問題にフタをするのではなく解決するべきだと主張しました。

・関連記事

Google Photosが黒人をゴリラと認識した事件で開発者が謝罪 - GIGAZINE

Googleはゴリラ画像を検索結果からブロックしている - GIGAZINE

Facebookが黒人男性の動画を「霊長類」とタグ付けし謝罪 - GIGAZINE

AIはレントゲン写真から人種を90%の確率で見分けられる、ただし見分け方は不明 - GIGAZINE

広く用いられているAIを採用したロボットアームが女性や有色人種を差別してしまったという研究結果 - GIGAZINE

AIの先祖である「書類選考用アルゴリズム」もまた人種・女性差別的だったという事実 - GIGAZINE

「モザイク画像の解像度を64倍にする研究」が人種差別の議論に発展、非難を集めた研究者はアカウントを停止 - GIGAZINE

YouTubeのAIがチェスの「白・黒」を人種差別だと誤判定してチャンネルを閉鎖した疑い - GIGAZINE

・関連コンテンツ

in ソフトウェア, ネットサービス, Posted by log1h_ik

You can read the machine translated English article Google, Apple, Amazon, Microsoft's A….