「コントロールの喪失」の恐れがあるとしてGPT-4を超えるAIの即時開発停止を全技術者に対して6カ月間求める公開書簡、イーロン・マスクやスティーブ・ウォズニアックなど1300人以上が署名

OpenAIが開発したGPT-4やChatGPTの成功をきっかけに、多数の企業やAI開発団体がAIの研究や開発を行っており、AI分野は急成長しています。しかし、急速な発展を遂げるAIは「社会と人類への深刻なリスク」があるとして、イーロン・マスク氏やAppleの共同創設者であるスティーブ・ウォズニアック氏などが公開書簡に署名しました。書簡の内容は「GPT-4を超えるAIの少なくとも6カ月間にわたる即時開発停止」です。

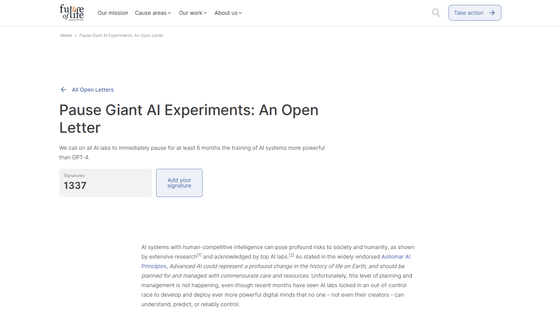

Pause Giant AI Experiments: An Open Letter - Future of Life Institute

https://futureoflife.org/open-letter/pause-giant-ai-experiments/

Tech pioneers call for six-month pause of "out-of-control" AI development | IT PRO

https://www.itpro.co.uk/technology/artificial-intelligence-ai/370345/tech-pioneers-call-for-six-month-pause-ai-development-out-of-control

AI Leaders Urge Labs to Halt Training Models More Powerful Than ChatGPT-4 - Bloomberg

https://www.bloomberg.com/news/articles/2023-03-29/ai-leaders-urge-labs-to-stop-training-the-most-advanced-models

Elon Musk, scientists, tech leaders sign open letter about GPT-4, Open AI

https://www.axios.com/2023/03/29/elon-musk-gpt-4-chat-open-ai

公開書簡を発表した、人工知能の責任ある倫理的開発を推進する非営利団体のFuture of Life Instituteは「AI開発の波が続く一方で、社会に重大なリスクをもたらす危険性がある、GPT-4やChatGPTのような生成型AI開発に対し、企業および規制上の保護措置が明らかに不足しています」と主張しています。

また、書簡ではAIの研究課題や倫理などを含むガイドラインであるアシロマの原則を提示し「アシロマの原則で述べられているように、高度なAIは地球上の生命の歴史に大きな変化をもたらす可能性があり、相応の注意とリソースで計画および管理する必要があります」と述べ「残念ながら、現状のAI開発はこのレベルでの計画や管理が行われていません。現状のAI開発団体は、AIの作成者でさえも理解や予測、コントロールできない競争に閉じ込められています」と批判しています。

また「現代のAIは今や試験やプログラミングなどの一般的なタスクで人間と競争ができるまでに成長しています。それでも私たちは現状人間が行う仕事をAIで自動化すべきでしょうか。人間がこれまで培ってきた文明を失う危険を冒すべきでしょうか」と提起しています。

そこで、Future of Life Instituteは、高度なAI開発のための一連の共有安全プロトコルを共同で開発・実装するために、高度なAIの開発とトレーニングを少なくとも6カ月間、ただちに一時停止すべきと求めています。さらにFuture of Life Instituteは「開発の一時停止は公開され、検証可能なものでなければなりません」「AI開発の一時停止が即座に決定出来ない場合、各国の政府はAI開発団体に介入すべきです」と主張しています。

さらにFuture of Life Instituteは「高性能なAIは、開発による効果がプラスになり、リスクが管理可能であると確信した場合にのみ開発すべきです」と述べています。

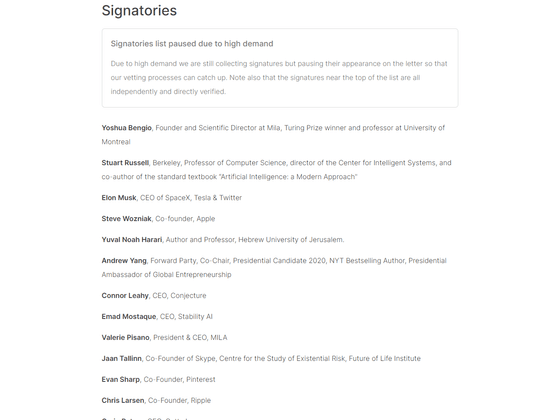

これらのFuture of Life Instituteの主張に対し、マスク氏やウォズニアック氏のほか、Skypeの共同創設者であるジャーン・タリン氏やPinterestの共同創設者のエヴァン・シャープ氏、ヨシュア・ベンジオ氏、スチュアート・ラッセル氏などの著名なコンピューター科学者など、記事作成時点で1300人以上の署名が集まっています。以下は公開書簡に署名した人物リストの一例です。

一方でOpenAIの広報担当者は「私たちはGPT-4のトレーニング終了後、モデルの安全性に関する調整に6カ月以上を費やしました」と明かし、Future of Life Instituteの書簡に署名しない姿勢を見せています。

・つづき

「制御不能なAI開発競争」の一時停止を求める公開書簡に偽の署名者が多数まぎれていたことが判明、AI研究者からは書簡への反論が続出 - GIGAZINE

・関連記事

今後は全職業の80%がAIの影響を受けるとの研究結果、ChatGPTで影響を受ける仕事は賃金が高い傾向あり - GIGAZINE

Mozillaが「秘密にまみれた大企業のAI」を打破するべくオープンなAI開発企業「Mozilla.ai」を設立 - GIGAZINE

AIが「全知全能の神」になる日を信じて崇拝する宗教団体が待ちわびる未来とは? - GIGAZINE

ゲーム開発者が「一晩でAIに仕事のやりがいを奪われてしまった」と悲痛な叫びを漏らす - GIGAZINE

ChatGPTなどの優れたチャットボットAIがいかに犯罪に使われやすいかをユーロポールがまとめて公開 - GIGAZINE

・関連コンテンツ

in メモ, ソフトウェア, Posted by darkhorse_log

You can read the machine translated English article More than 1,300 people, including Elon M….