蚊を「空飛ぶ注射器」にしてコウモリにワクチンを打つ新技術が開発される

中国の研究チームが、コウモリが媒介する人獣共通感染症の流出(スピルオーバー)を防ぐために、蚊をワクチンの運び手として利用する、あるいは塩水トラップを用いた経口接種を行うという、生態学に基づいた新しいワクチン接種プラットフォームを開発しました。この手法は、コウモリを駆除することなく、狂犬病ウイルスやニパウイルス、コロナウイルスなどの病原体が人や家畜に伝播するリスクを軽減し、コウモリの保護と公衆衛生の維持を両立させることを目的としています。

Ecological vaccination: A strategy to prevent zoonotic spillover from bats | Science Advances

https://www.science.org/doi/10.1126/sciadv.aec0269

Turning mosquitoes into flying vaccine carriers to protect against bat-borne viruses

https://phys.org/news/2026-03-mosquitoes-flying-vaccine-carriers-borne.html

コウモリは哺乳類の約22%を占める重要な生態学的役割を持つ動物ですが、エボラ、SARS、COVID-19などの重篤な感染症の原因となるウイルスの自然宿主でもあります。野生のコウモリに従来の筋肉内注射や経口餌でワクチンを届けることは、その広大な生息域やコロニーの大きさから極めて困難であり、ラテンアメリカで行われたコウモリの駆除はかえって病気の伝染を悪化させる結果となったと報告されています。

そこで研究チームは「コウモリが蚊を捕食し、蚊がコウモリから吸血する」という行動、そして多くの哺乳類が塩分を求める習性に着目しました。

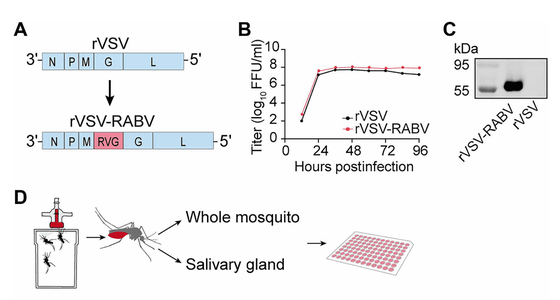

まず、昆虫と哺乳類の両方に感染可能な水疱性口内炎ウイルス(rVSV)を改変し、狂犬病やニパウイルスのタンパク質を発現するワクチンを作製しました。このワクチンを吸わせた蚊を40グレイのX線で照射して不妊化し、野生での繁殖を防ぐことで、環境への流出リスクを抑えながらコウモリにワクチンを届ける「空飛ぶ注射器」として機能させます。

マウスを用いた実験では、ワクチンを運ぶ蚊に刺される、あるいは蚊のホモジネートを経口摂取することで、防御閾値を超える抗体が誘導され、狂犬病ウイルスの致死的攻撃から保護されることが確認されました。続いてコウモリに対しても同様の検証が行われ、ワクチンを運ぶ蚊との共同生活やワクチンの入った塩水の経口接種により、高い生存率が示されました。

広東省の洞窟での調査では、実際にコウモリが蚊を食べており、蚊もコウモリから吸血していることが遺伝子解析で裏付けられています。また、北京の洞窟に設置された塩水ミスト発生器を備えたトラップの実験では、85%のコウモリの糞からバイオマーカーであるテトラサイクリンが検出され、野生環境でもこの手法が有効に機能する可能性が示されました。さらに、このワクチンは蚊から交尾相手や子孫へ伝播せず、家畜の豚に1億 FFUという高用量を投与しても発症やウイルス排出が見られないなど、高い安全性が確認されています。

研究チームはゴールデンシリアンハムスターやコウモリで免疫応答を確認しており、この戦略をニパウイルスやSARS-CoVなどにも応用し、将来的には野生動物に対するスケーラブルなワクチン接種法として利用することを期待しています。ただし、記事作成時点では実用化には規制や安全面での課題が残っているとしています。

・関連記事

鼻からスプレーするだけでウイルス・細菌・アレルギーに効く万能ワクチンが開発中 - GIGAZINE

人間の血液に「蚊を殺す毒」を含ませてマラリアの感染を抑えるアイデア、イベルメクチンの代わりとなる薬が発見される - GIGAZINE

「毒入り精液」を出すようにオスの蚊を遺伝子組み換えして感染症媒介を防ぐ試み - GIGAZINE

蚊が好む花を除去することでマラリア感染を弱められるのではないかとの指摘 - GIGAZINE

「ペットの遺体を裏庭に埋めてはいけない」のには理由がある - GIGAZINE

・関連コンテンツ

in サイエンス, 生き物, Posted by log1i_yk

You can read the machine translated English article A new technology has been developed that….