OpenAIがAIのコーディング能力を測る代表的ベンチマークは「もはや無意味」と説明、初期の解けなかった問題を調べると逆に問題が悪いことが発覚

「SWE-bench Verified」は2024年8月にOpenAIが公開したベンチマークで、AIのプログラミング能力を測る代表的な指標として広く使われてきました。新たな分析により、SWE-bench Verifiedには2つの重大な問題があり、「もはや最先端モデルの能力を正しく測定するべきベンチマークとして適切ではない」とOpenAIが提言しています。

SWE-bench Verifiedがフロンティアのコーディング能力を測定しなくなった理由 | OpenAI

https://openai.com/ja-JP/index/why-we-no-longer-evaluate-swe-bench-verified/

OpenAIが2023年にリリースした「SWE-bench」は、12のオープンソースPythonリポジトリのいずれかにある解決済みのGitHub issueを出典として、対応するプルリクエストと組み合わせることで、モデルが生成したコード変更が正しいかどうかを判断するテストを用意します。AIモデルは元の問題テキストと修正前のリポジトリの状態のみに基づいてコードの修正や変更を生成する必要があり、その変更が適用された後にテストが実施され評価を行います。SWE-benchがモデルの自律的なソフトウェアエンジニアリング能力を体系的に過小評価していることが判明したことから、より正確な評価を提供するベンチマークとして2024年にリリースされたのがSWE-bench Verifiedです。

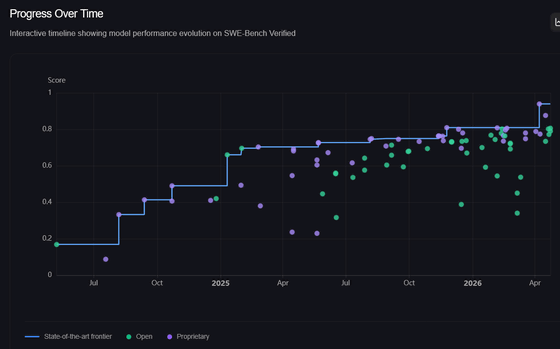

SWE-bench Verifiedはリリースされてから広く最先端モデルの評価に用いられました。初期はモデルのパフォーマンスが急速に上昇していましたが、2025年8月から2026年2月は6か月間で6%程度の改善と、成長が鈍化しています。この成長の鈍化がモデルの限界を示しているのか、それともデータセット自体の特性を反映しているのか、SWE-bench Verifiedの有効性を再確認する必要性がありました。

そこで詳細な分析を実施したところ、SWE-bench Verifiedには2つの重大な問題があることが判明したとOpenAIは2026年2月に報告しました。

問題の1つ目は「テストが正しい解法を拒否することがある」という欠陥です。OpenAIの分析では、モデルが解けなかったデータセットの27.6%を監査したところ、少なくとも59.4%に「機能的に正しい解答の送信を拒否してしまう欠陥のあるテストケース」が含まれていたことが判明しました。これはつまり、本来は正しいコード修正をAIがしていた場合でも、答えが単一ではないなどテストの作り方が不適切なために、「不正解」と判定されてしまうケースがあるということです。OpenAIは「これは、SWE-bench Verifiedの初期作成時に改善すべく最大限の努力を払ったにもかかわらず、起きた現象です」と語っています。

もう一つの重大な問題が「データ汚染」です。SWE-benchの問題は、多くのモデル提供者が学習目的で使用するオープンソースのリポジトリから取得されています。OpenAIの分析では、最先端モデルが問題文や実際の修正コードを再現できてしまうケースが確認され、「試験前に問題と答えを見ている」状態にあったことが指摘されました。これはつまり、ベンチマーク結果のパフォーマンス向上は、モデルの改善ではなく、「モデルがトレーニング時にベンチマークをどれだけ参照していたか」を反映している可能性が高いというわけです。

OpenAIは実際に、2026年2月時点の最新モデルであるGPT-5.2を用いた検証結果も紹介しています。SWE-bench Verifiedで「失敗」と判定された問題の一部について人間が精査したところ、実際には正しい修正を行っていたにもかかわらずテストの不備によって不正解とされていたケースが多数確認されたことが報告されています。また、モデルが問題に含まれるコード変更をそのまま再現できてしまう例も確認されており、これは事前学習によるデータ汚染の影響を示唆するものです。

こうした問題を受けてOpenAIはSWE-bench Verifiedの結果報告を停止し、代替として「SWE-bench Pro」など新しい評価手法の利用を推奨しています。SWE-bench Proはデータ汚染を防ぐため、評価データの一部を非公開にするなど、従来よりも厳密な評価設計が採用されています。完璧ではありませんがSWE-bench Verifiedと比べてかなり汚染レベルが低く、どのモデルも完全に事前学習から得た逐語的な正解パッチを生成することはできなかったとのこと。また、今後は汚染されていないデータセットやより実環境に近い評価方法、人間によるレビューを含む評価といった新しいアプローチが重要になるとOpenAIは述べています。

・関連記事

OpenAIがAIの仮想通貨に対する攻撃・防御能力を測定できるベンチマークテスト「EVMbench」を発表 - GIGAZINE

AIの現実世界での能力を測定するベンチマーク「GDPval」をOpenAIが開発、弁護士や映画監督など現実の職業としての性能を測定可能 - GIGAZINE

「Balatro」をどのAIが最も上手くプレイできるのかが分かるベンチマーク「BalatroBench」 - GIGAZINE

Googleが人狼ゲームとポーカーをAIベンチマーク「Game Arena」に採用 - GIGAZINE

・関連コンテンツ

in AI, Posted by log1e_dh

You can read the machine translated English article OpenAI explains that the standard benchm….