無料でGoogleのローカルAI「Gemma 4」の威力がGoogle公式アプリ「AI Edge Gallery」で誰でも試せるように、iPhoneでもローカル動作可能

Googleが2026年4月2日に発表したオープンソースAIモデル「Gemma 4」がGoogle公式アプリ「Google AI Edge Gallery」で提供されています。この「AI Edge Gallery」が4月3日からiOS向けにも配信されており、iPhone上でもGemma 4をローカルで動作させることが可能になったとのことで、実際に試してみました。

Gemma 4 can run on phones without an internet connection! ????

— Google Gemma (@googlegemma) April 6, 2026

It can perform local agentic tasks, such as logging and analyzing trends. When connected, it can also make API calls.

Want to try it yourself? Get the Google AI Edge App on iOS or Android. (???? Sound on for the demo!) pic.twitter.com/eUy0lmtqBE

iOS向けのGoogle AI Edge Galleryは以下で配信されています。

Google AI Edge Galleryアプリ - App Store

https://apps.apple.com/jp/app/google-ai-edge-gallery/id6749645337

「入手」をタップし、AI Edge Galleryをインストールします。なお、今回はiPhone 15 Proに導入しました。

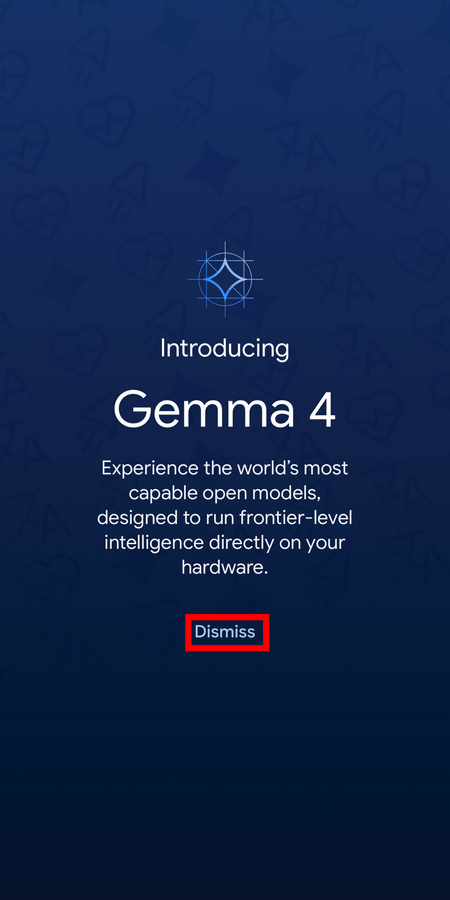

AI Edge Galleryを起動すると、Gemma 4がアピールされました。「Dismiss」をタップ。

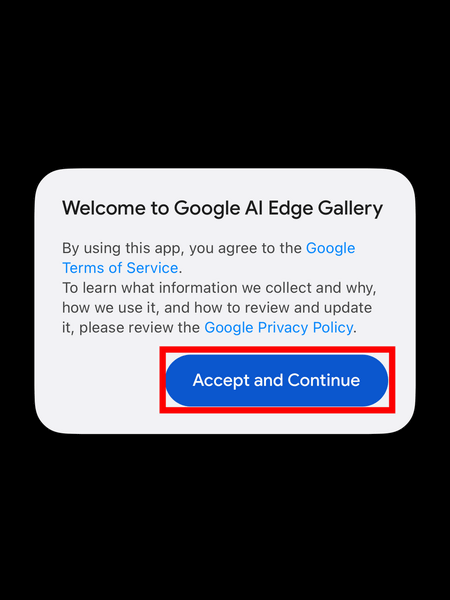

Googleのサービス規約とプライバシーポリシーが表示されるので「Accept and Continue」をタップ。

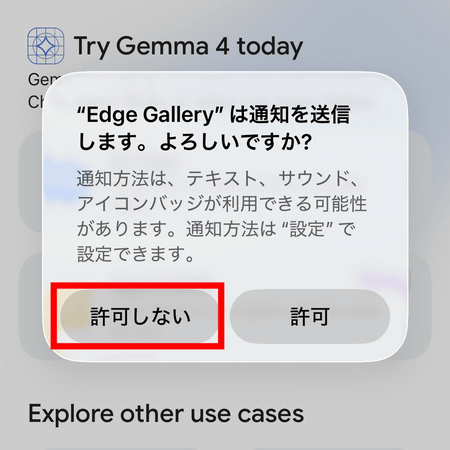

通知を許可するかを尋ねられるので、今回は「許可しない」をタップ。

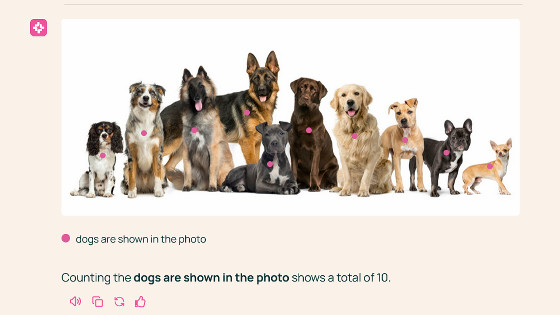

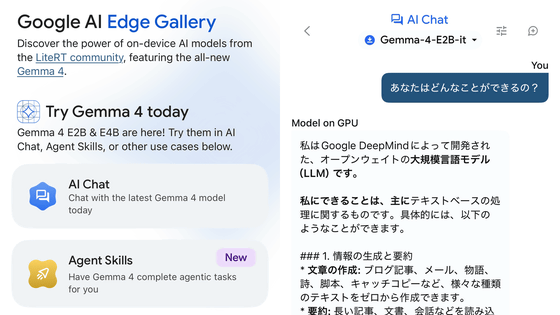

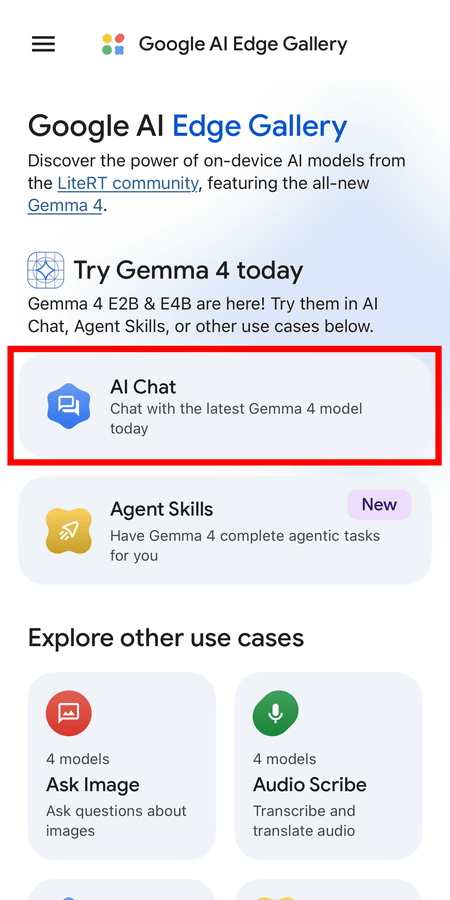

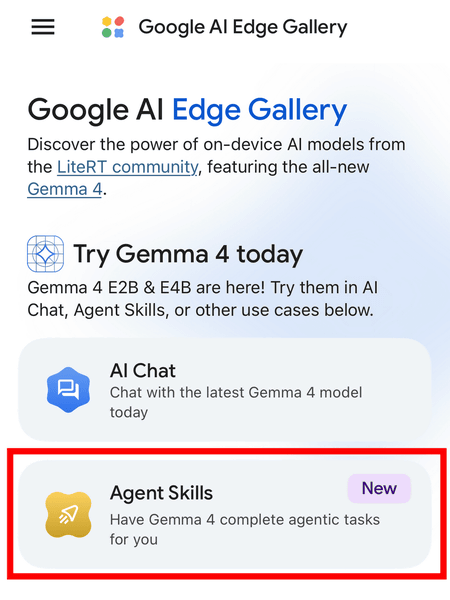

Google AI Edge Galleryのトップで、「AI Chat」をタップします。

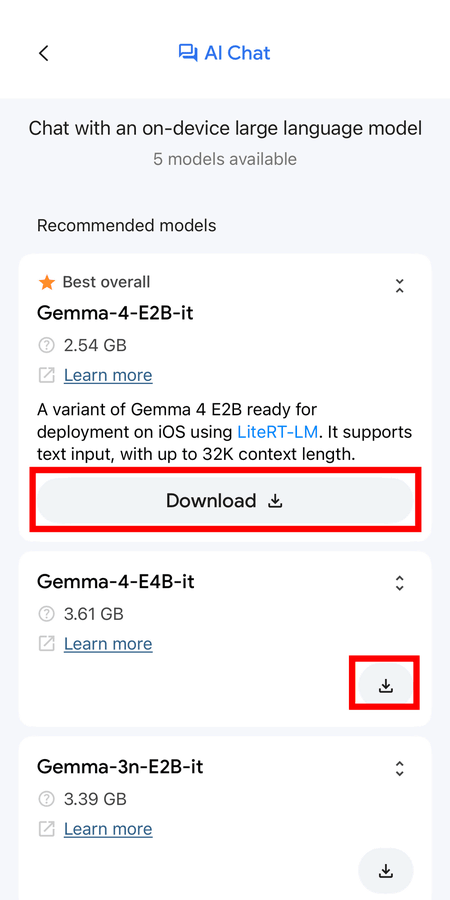

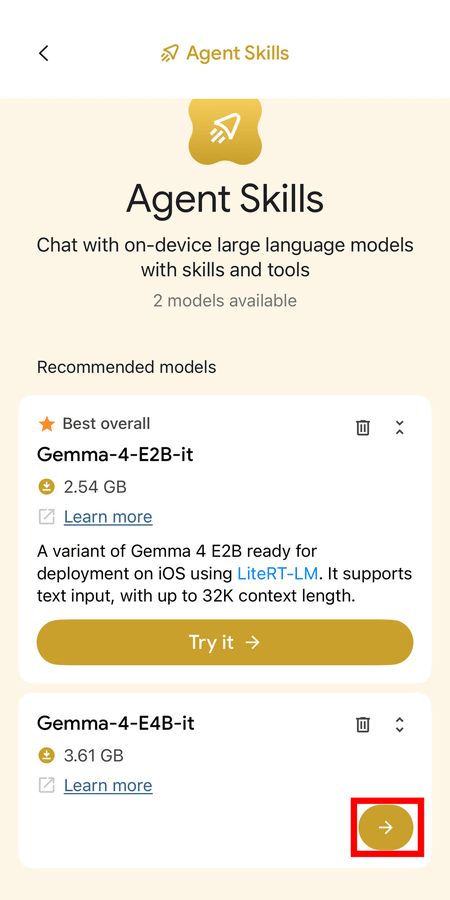

モデル一覧が表示されます。記事作成時点では最上部にGemma 4のうちE2BモデルとE4Bモデルが表示されていました。E2BモデルとE4Bモデルはモバイル機器やIoT機器向けに設計されたEffectiveモデルで、31B Denseモデルや26B MoEモデルと比べてかなり小規模なのが特徴。「Download」あるいは「↓」ボタンをタップして、モデルをダウンロードします。なお、モデルサイズはE2Bモデルが2.54GB、E4Bモデルが3.61GBとなっているので、通信量やストレージの残り容量に注意してください。

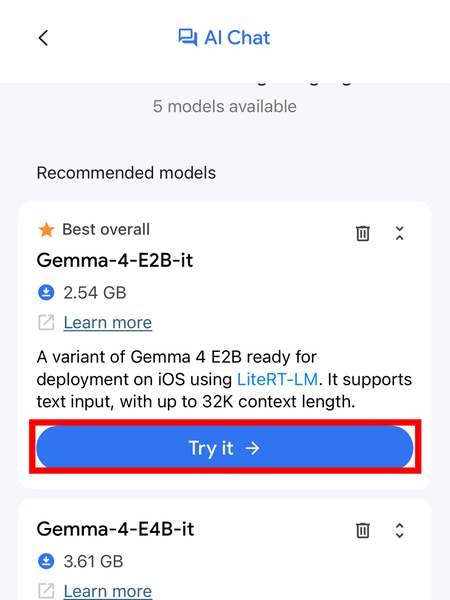

ダウンロードが終わったら、「Try it →」をタップし、まずはE2Bモデルを試してみます。

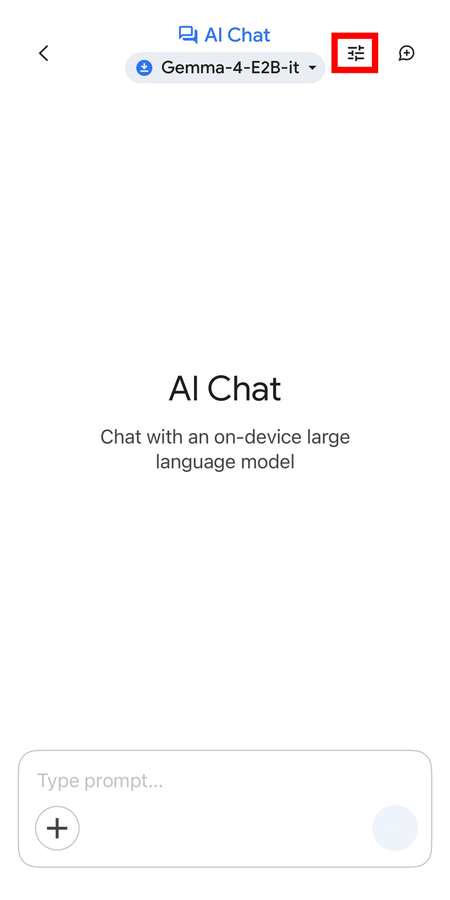

AIチャットの画面はこんな感じ。右上のスライドバーアイコンをタップすることで設定を変更できます。

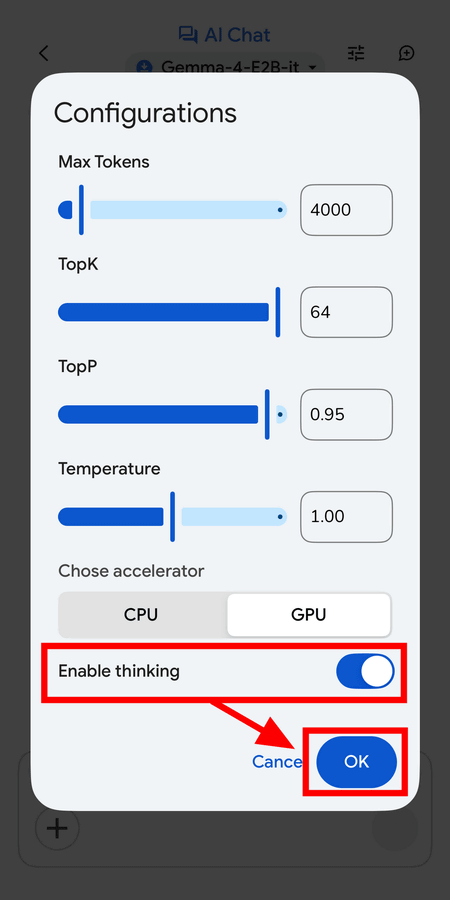

変更できるのは最大トークン数やトークンのフィルタリング制限であるTopK、関数調整のTopPやTemperture。また、演算資源をCPUにするかGPUにするかを選択可能。「Enable thinking」は推論モードのオン・オフで、デフォルトでオフになっています。オンにする場合はスイッチを入れて、「OK」をタップします。

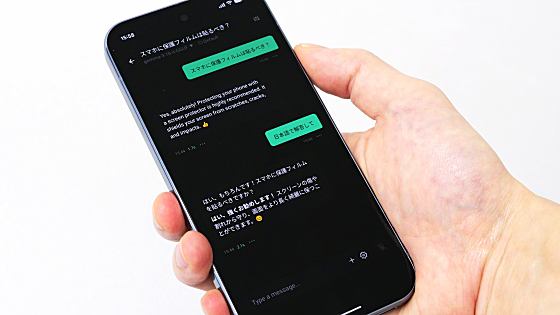

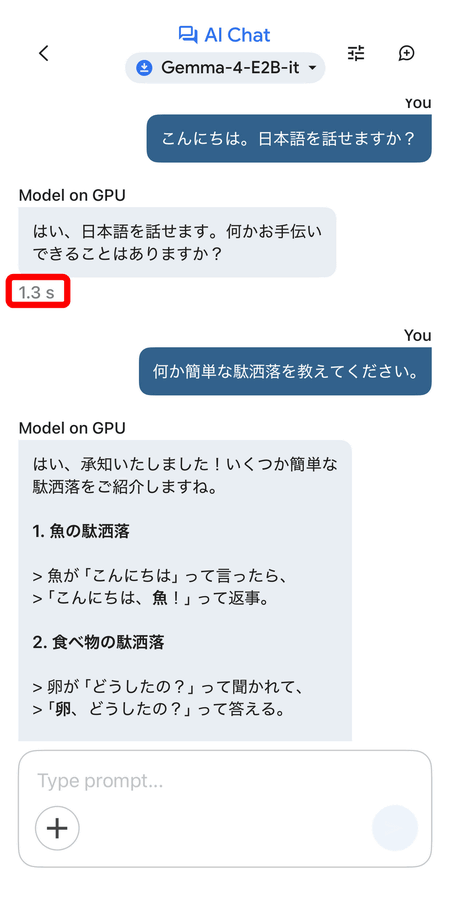

Gemma 4は日本語に対応しています。話しかけてみると、iPhone 15 Pro上でローカル動作しているにもかかわらず、数秒で回答が返ってきます。E2Bモデルはパラメーターサイズが小さいこともあり、駄洒落(だじゃれ)の回答を見ても分かる通り、内容のクオリティはそこまで高いというわけではありませんが、動作自体は機敏です。

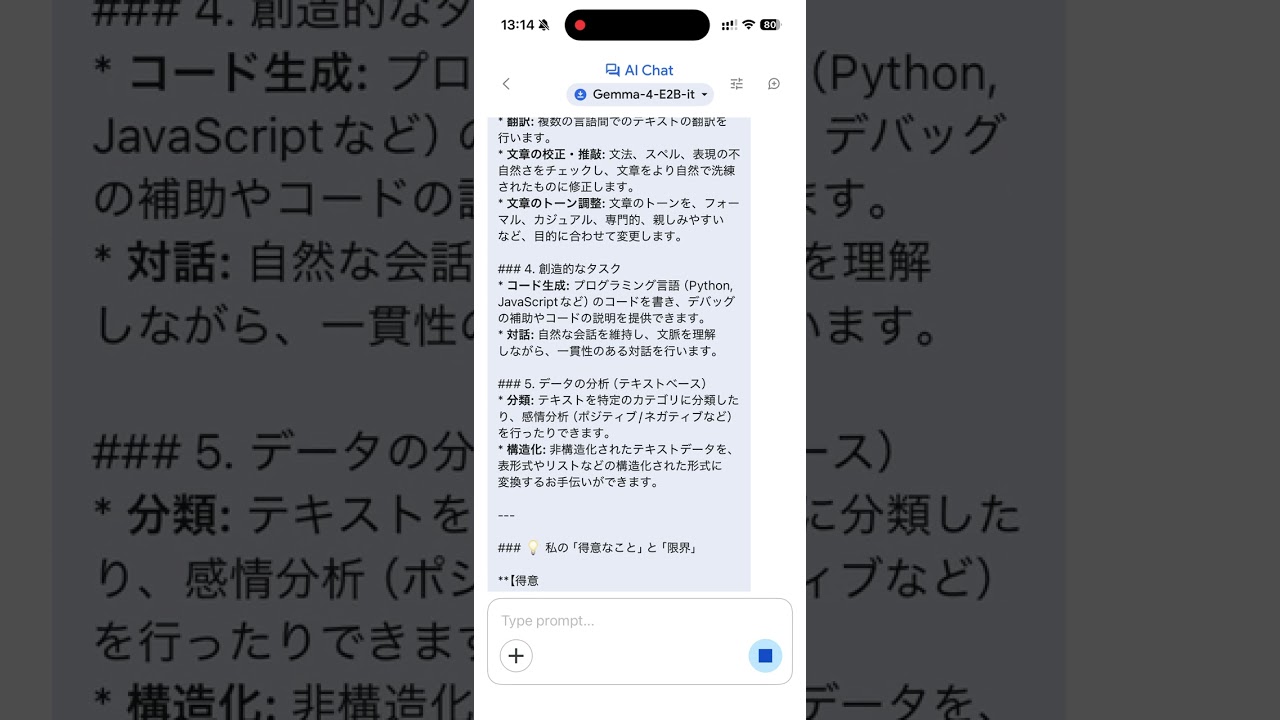

Gemma 4のE4Bモデルに「どんなことができるの?」と日本語で話しかけてみたところが以下のムービー。返答は早く、回答の日本語にも破綻はありません。

iPhoneでGemma 4をローカル動作させて日本語で話しかけてみた - YouTube

また、GoogleはGemma 4の公開と同時に、デバイス上で完全にマルチステップの自律的なエージェントワークフローを実行できる「Agent Skills」をGoogle AI Edge Galleryに実装しています。

Bring state-of-the-art agentic skills to the edge with Gemma 4 - Google Developers Blog

https://developers.googleblog.com/bring-state-of-the-art-agentic-skills-to-the-edge-with-gemma-4/

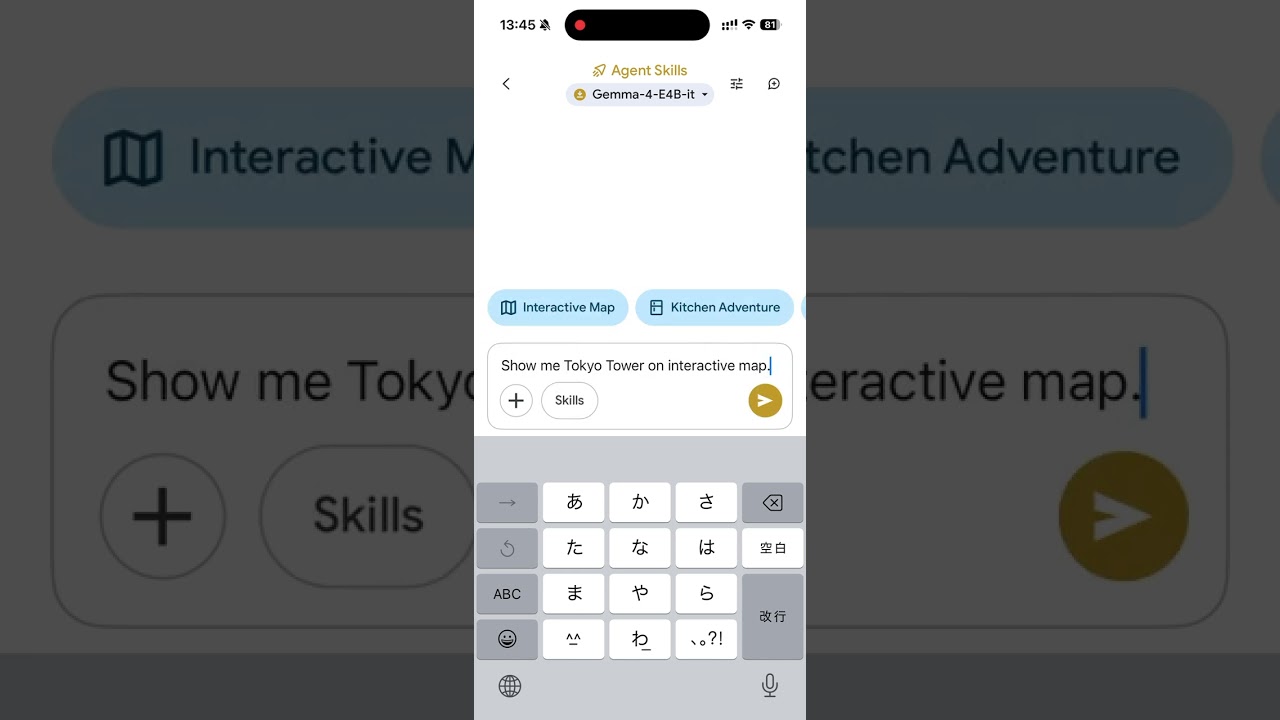

Google AI Edge Galleryから「Agent Skills」をタップ。

今回はE4Bモデルで試してみます。「→」をタップ。

たとえば、E4Bモデルに「東京タワーの場所をGoogleマップで検索して埋め込みで表示させる」というタスクを行わせてみたところ、以下のムービーのように十数秒でサクッと表示されました。エージェントスキルの一覧はプロンプト入力欄の「Skills」をタップします。

Gemma 4のE4Bモデルのエージェントスキルで東京タワーの場所を地図で表示してもらった - YouTube

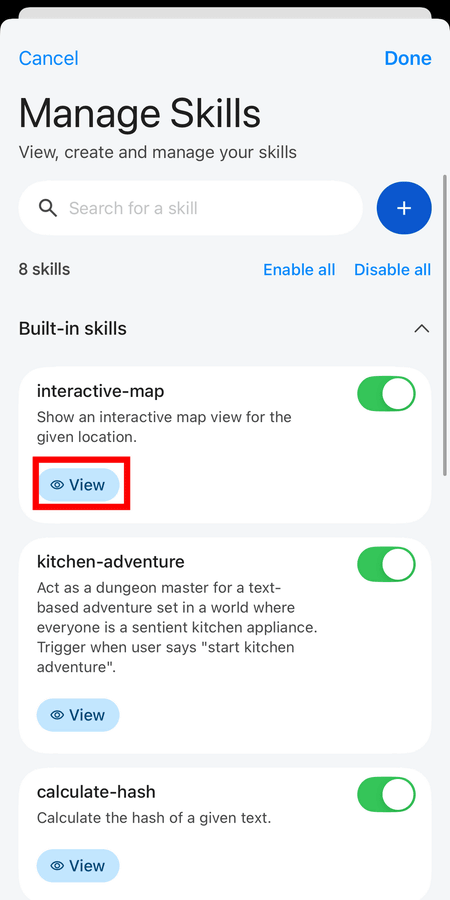

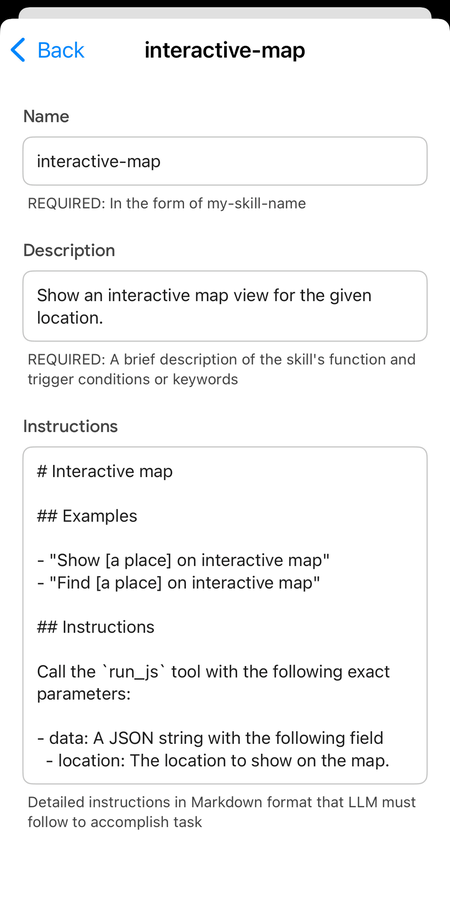

デフォルトだと8種類のスキルが有効化されています。今回利用した「interactive-map」のスキル内容を見るためには「View」をタップ。

interactive-mapの中身はこんな感じ。スキルは新しく自分でも追加することが可能となっています。

・関連記事

GoogleがオープンAIモデル「Gemma 4」を発表、ライセンスをApache 2.0に変更 - GIGAZINE

iPhone 17 Proでパラメーター数80億のAIモデル「1-bit Bonsai 8B」をローカル実行してみたよレビュー、無料アプリのLocally AIで簡単に実行できる - GIGAZINE

スマホでAIモデルをローカル実行できる無料アプリ「Off Grid」レビュー、LLMも画像生成モデルも実行可能でiOS・Androidどっちも対応 - GIGAZINE

パラメーター数8Bなのにメモリ消費わずか1.15GBの省メモリAIモデル「1-bit Bonsai」が登場、メモリ消費量14倍のモデルと同等以上の性能を発揮 - GIGAZINE

無料でiPhone/iPad・AndroidスマホでいろいろなローカルAIを動かしチャット&ローカルAIベンチマークができるオープンソースアプリ「PocketPal AI」、サブスク不要&オフラインでどこでも利用可能 - GIGAZINE

・関連コンテンツ

in AI, 動画, ソフトウェア, レビュー, Posted by log1i_yk

You can read the machine translated English article Google's local AI, 'Gemma 4,' is now….