GoogleがオープンAIモデル「Gemma 4」を発表、ライセンスをApache 2.0に変更

Googleがオープンモデル群であるGemma 4を2026年4月2日に公開しました。このモデルはGemini 3と同様の技術を基盤としており、高度な推論や自律的なエージェント機能に特化して設計されています。今回のリリースでは開発者の利便性を考慮し、ライセンスを従来の独自形式から商業的に寛容なApache 2.0へと変更しています。

Gemma 4: Our most capable open models to date

https://blog.google/innovation-and-ai/technology/developers-tools/gemma-4/

What’s new in Gemma 4 - YouTube

Google announces Gemma 4 open AI models, switches to Apache 2.0 license - Ars Technica

https://arstechnica.com/ai/2026/04/google-announces-gemma-4-open-ai-models-switches-to-apache-2-0-license/

Googleによれば、Gemmaは初代公開以来4億回以上ダウンロードされ、10万を超える派生モデルが生まれているとのこと。今回発表されたGemma 4はエッジデバイスからデスクトップ環境までをカバーする4つのサイズで構成されています。

モバイルやIoT機器向けにはパラメータサイズ20億のエフェクティブ2B(E2B)、およびパラメーターサイズ40億のエフェクティブ4B(E4B)が用意され、高い計算効率とメモリ効率を実現しています。このE2BとE4Bの2モデルは、デバイス上での展開におけるパラメータ効率を最大化するためにレイヤーごとの埋め込み(PLE)を採用しており、より効果的(Effective)なモデルになっています。より大規模なタスク向けにはパラメーターサイズ260億のMoEモデル(26B)とパラメーターサイズ310億のDenseモデル(31B)の2種類が存在します。

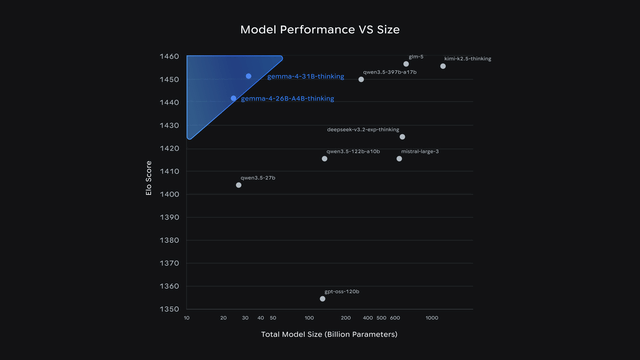

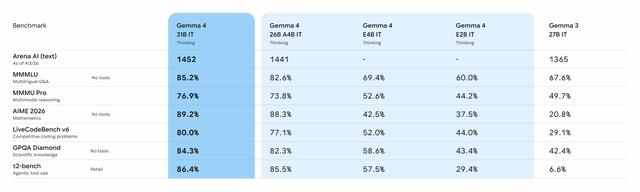

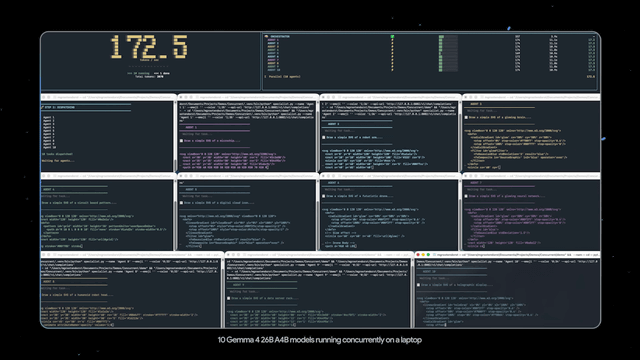

26Bモデルは推論時に総パラメーターのうち38億のみを活性化させることで、同規模の他モデルを上回るトークン生成速度を達成しました。31Bモデルは業界標準のArena AIリーダーボードにおいて世界で第3位のオープンモデルとしてランクインしています。26Bモデルも第6位を獲得しており、自身の20倍以上の規模を持つモデルに匹敵する性能を示したとのこと。これにより開発者は、少ないハードウェアリソースで最先端のAI機能を活用できるとGoogleは述べています。

機能面では多段階の計画立案や論理思考が大幅に強化され、数学や指示追従のベンチマークで高いスコアを記録しています。自律型エージェントの構築を支援するため、関数の呼び出しや構造化されたJSON出力、ネイティブなシステム指示に標準で対応しました。コード生成能力も高く、大規模モデルを動かせるハードウェアがあれば、ローカルのオフライン環境でも高品質なコード生成が可能です。

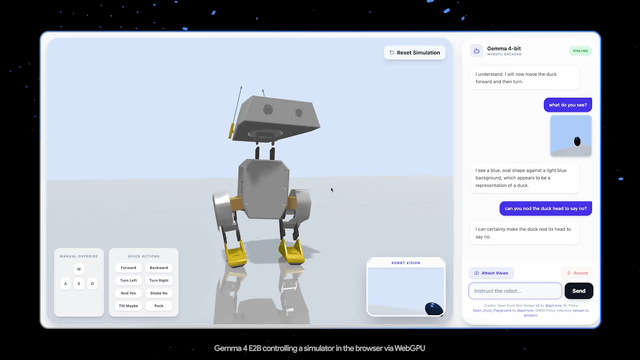

Gemma 4は全モデルが画像やビデオを処理できるマルチモーダル機能を備えており、文字認識(OCR)やグラフの理解において優れた精度を発揮します。エッジ向けのE2BとE4Bは音声入力もサポートしており、デバイス上での音声認識や理解が可能です。Gemma 4は140以上の言語に対応しており、グローバルなアプリケーション開発を後押しします。

文脈を理解するコンテキストウィンドウは、エッジモデルで12万8000トークン、大型モデルで最大25万6000トークンまで処理できます。これはローカルモデルとしては異例の長さであり、大規模なソースコードや長い文書を一度に読み込ませる運用に適しています。

特に26Bモデルと31Bモデルは、研究者や開発者が個人のPC環境でも最先端級の推論性能をオフラインで扱えるように位置付けられた大型モデルです。非量子化のbfloat16版でも80GBのNVIDIA H100 GPU 1枚で動作するよう設計されており、量子化版であれば一般的な消費者向けGPUでもローカル実行が可能。26Bモデルは推論時に総パラメーター260億のうち38億だけを有効化することで低レイテンシと高速なトークン生成を重視しており、一方の31B Denseモデルは速度よりも出力品質を優先し、追加学習や用途特化のチューニングの土台として使うことが想定されています。

対して、E2BとE4Bはモバイル機器やIoT機器向けに設計されており、QualcommやMediaTek、Google Pixelチームとの協力により、スマートフォンやRaspberry Pi、Jetson Orin Nanoなどで低メモリかつ低遅延で動作するよう最適化されています。Googleはこれらのモデルが次世代のGemini Nano 4の基盤にもなると説明しており、Android向けのローカルAI機能強化にもつながるとみられます。

また、GoogleはGemma 4のリリースに際して、従来のライセンス体系を抜本的に見直し、これまでのモデルで採用されていた独自のカスタムライセンスを廃止し、業界で広く普及しているApache 2.0ライセンスへと全面的に切り替えています。この変更は開発者コミュニティからのフィードバックを反映したものであり、AIの未来を築くための共同アプローチを重視し、制限的な障壁を取り除くことを目的としているとGoogleは述べています。

実際に以前のGemma 3などで使用されていたカスタムライセンスは、多くの開発者にとって制約が多すぎるものでした。Googleが一方的に更新可能な厳格な禁止事項が含まれていたほか、GemmaベースのすべてのプロジェクトにおいてGoogleの規則を強制的に適用させる必要がありました。さらに、Gemmaが生成した合成データを用いて作成された他のAIモデルにまでライセンスが継承されると解釈できる条項も存在しており、開発者がGoogleのオープンモデルを採用する際の大きな心理的障壁となっていました。

新たに採用されたApache 2.0は、商用利用においても非常に寛容なオープンソースライセンスです。過度な利用規約や商用制限が存在しないため、開発者は自身のデータ、インフラ、およびモデルに対して完全な制御権を持つデジタル主権を確保できます。また、将来的にGoogleが一方的にライセンス条件を変更することも不可能であるため、開発者は長期的な安心感を持って自社のプロジェクトに技術を組み込めます。ライセンスの刷新により、オンプレミスやクラウドを問わず、あらゆる環境で自由にモデルを構築し、安全に展開することが可能になりました。

Hugging Faceの共同創設者兼CEOであるクレマン・ドゥラング氏は、この変更を大きな節目として高く評価しており、初日からGemma 4ファミリーを全面的にサポートすることを表明しています。Googleは開発者にデータや展開計画の管理権限を委ねることで、Gemmaを活用した革新的な研究や製品がさらに拡大することを期待しています。

Gemma 4はGoogle AI Studioで31Bモデルと26Bモデルが、Google AI Edge GalleryでE4BモデルとE2Bモデルにアクセス可能。また、HuggingFaceでモデルが配布されているほか、KaggleやOllamaからもモデルウェイトを取得可能です。

Welcome Gemma 4: Frontier multimodal intelligence on device

https://huggingface.co/blog/gemma4

また、GoogleはGemini APIに「Flex」と「Priority」という2つのサービスティアを追加したことを発表しました。これにより、バックグラウンドで処理を行うタスクと、チャットボットのように高い信頼性が求められる対話型のタスクでAPIを使い分け、コストと信頼性のバランスが取りやすくなったとアピールしています。

Flex and Priority tiers in the Gemini API

https://blog.google/innovation-and-ai/technology/developers-tools/introducing-flex-and-priority-inference/

・関連記事

GIGAZINE春のプレゼント大放出企画「アンケートに答えて全部持っていってください!」 - GIGAZINE

AIを8倍高速化しメモリ使用量を6分の1に削減するGoogleの新アルゴリズム「TurboQuant」 - GIGAZINE

GPT・Llama・Grokなどさまざまな大規模言語モデルのアーキテクチャを図示した「LLM Architecture Gallery」 - GIGAZINE

NVIDIAが日本語特化の小型AIモデル「Nemotron-Nano-9B-v2-Japanese」を公開、10B以下で最高性能を達成し商用利用可能 - GIGAZINE

信頼できるAIコーディングを実現するためのオープンソース証明検証基盤「Leanstral」をMistral AIがリリース、重大なボトルネック「人間によるレビュー」の克服を目指す - GIGAZINE

Qwen3.5シリーズの超小型AIモデル「Qwen3.5-0.8B」「Qwen3.5-2B」「Qwen3.5-4B」「Qwen3.5-9B」が一斉に登場 - GIGAZINE

Alibaba Qwenチームの主任研究者ら主要メンバーが突如退職 - GIGAZINE

・関連コンテンツ

in AI, 動画, ソフトウェア, Posted by log1i_yk

You can read the machine translated English article Google announces open AI model 'Gemma 4'….