実はボイジャー1号は69KBのメモリと8トラックのテープレコーダーで今も動作している

by dilettantiquity

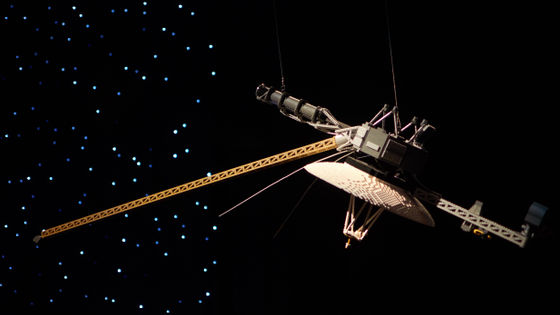

地球の情報を載せて宇宙空間に放たれた宇宙探査機「ボイジャー1号」は、宇宙で地球から最も遠いところにある人工物です。このボイジャー1号に搭載されたメモリは、近年のスマートフォンのわずか数十万分の1ほどしかないにもかかわらず、発射から50年近く経過した時点でも動き続けています。

A 1977 Time Capsule, Voyager 1 runs on 69 KB of memory and an 8-track tape recorder

https://techfixated.com/a-1977-time-capsule-voyager-1-runs-on-69-kb-of-memory-and-an-8-track-tape-recorder-4/

ボイジャー1号は1977年9月5日に打ち上げられた宇宙探査機で、人類の文明の記録を伝えるために作り出された「ゴールデンレコード」を搭載し、人工物として初めて太陽圏の外を飛行しています。

宇宙で最も遠いところから、既存のどの機器も収集できない科学データを地球に送信し続けていますが、これらの動作はわずか69KBのメモリと8トラックのテープレコーダーで実現されています。2026年時点で最新のスマートフォン「Pixel 10」は12GB(1キロバイト=1000バイト換算で1200万KB)もメモリがあることを考えると、ボイジャー1号のメモリはとんでもなく少ないと言えます。

ボイジャー1号に搭載されているコンピュータは毎秒約8万1000の命令を実行する能力を持ちます。スマートフォンはおそらくこれの約7500倍速く処理できます。

データ通信速度は毎秒160ビットです。令和になりほとんど見られなくなったダイヤルアップ接続でも少なくとも毎秒2万ビットの速度を出すことができます。

地球に向けて信号を発する送信機はわずか22.4Wの電力しか発生させません。信号が地球に到達する頃には宇宙空間に完全に拡散しているため、出力は約0.1兆分の1Wにまで減少しています。

ボイジャー1号は1ビット当たり何個の光子を送信しそのうち何個が受信されるのか? - GIGAZINE

現代の技術と比較すると吹けば飛ぶような性能ですが、ボイジャー1号は科学史に残る貴重な発見をいくつも成し遂げています。

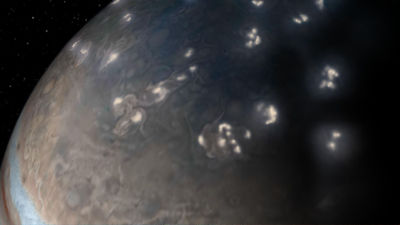

例えば、1979年の木星フライバイの際、ボイジャー1号は木星の衛星イオに活火山を発見しています。これは地球以外の天体で火山活動が観測された初めての事例でした。

1980年、ボイジャー1号は土星最大の衛星タイタンに接近し、厚い窒素大気が存在することを発見しました。これにより、タイタンは太陽系で唯一、相当量の大気を持つ衛星であることが確認され、後にカッシーニ・ホイヘンス探査機によって確認されることになる炭化水素化学の存在を示唆しました。

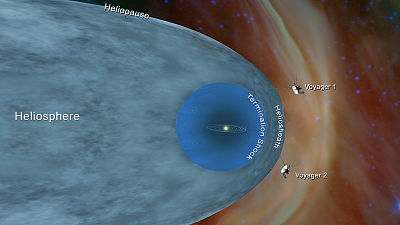

2012年には太陽風が星間物質に反作用できなくなる境界であるヘリオポーズを越え、人類が作った物体として初めて星間空間に到達しました。

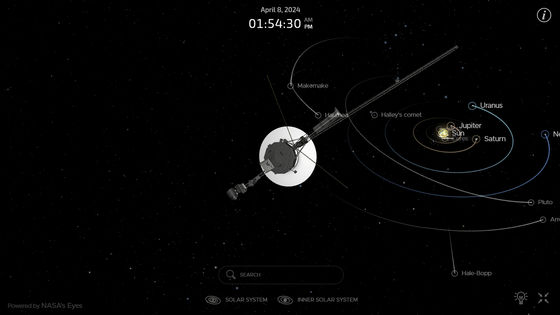

2026年時点で、ボイジャー1号は秒速約17キロメートルで移動しています。太陽系の最も外側の重力境界を示す、遠く離れた氷の天体の層であるオールトの雲の内縁に到達するにはおよそ300年、オールトの雲から脱出するにはおよそ3万年かかるとされていて、ボイジャー1号にはさらなる旅が待ち構えています。搭載されている放射性同位体熱電発電機は、2036年まで技術データを送信するのに十分な電力を供給できるとされています。つまり、人間がボイジャー1号からデータを得られるのは残りあと10年ほどしかないということです。

・関連記事

240億km以上離れたボイジャー1号と通信が途絶えるも40年使っていなかったサブ通信システムにより復帰 - GIGAZINE

ボイジャー1号が残された2台の機器からの科学データの送信に成功しオンラインに完全復帰 - GIGAZINE

宇宙から解読不能なデータを送信し続けていたボイジャー1号がついに科学データの送信を再開 - GIGAZINE

・関連コンテンツ

in ハードウェア, Posted by log1p_kr

You can read the machine translated English article In fact, Voyager 1 is still functioning ….