与えられた輪郭からAIがリアルな実写風映像を自動的に生成する「vid2vid」

あるムービーをベースにし、そこに含まれる要素を実在しない別のものに置き換えるムービーをAIが新たに生成する分野「Video-to-Video Synthesis」で、従来にはないリアルさを持つ新しい技術「vid2vid」が開発されました。

Video-to-Video Synthesis

https://tcwang0509.github.io/vid2vid/

[1808.06601] Video-to-Video Synthesis

https://arxiv.org/abs/1808.06601

vid2vidは、マサチューセッツ工科大学とNvidiaの専門家による開発チームによって開発されたもの。どれほどリアルな映像を生成できるかは、以下のムービーを見ればよくわかります。

Video-to-Video Synthesis - YouTube

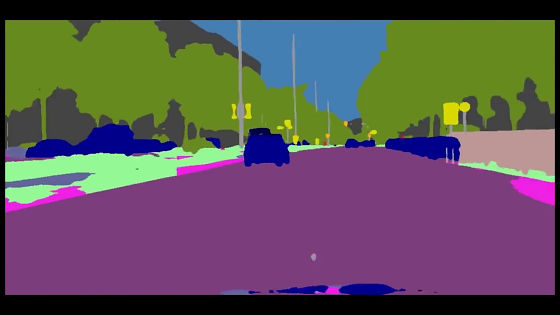

コンピューターに与えられるのは、以下のような画面上の要素を色分けした映像素材。この素材をもとに生成された風景が……

コレ。ヨーロッパっぽい雰囲気を持つ街並みの中を、複数の自動車が走っている様子が再現されていますが、これらは全てVideo-to-Video Synthesisで生成されたものであるとのこと。

ただし、シーンによっては並木が不自然に見えたり、自動車の形状がゆがんでしまったりすることも。とはいえ、静止画で見ると不自然さが目立ちますが、動いているムービーだとさほど気にならなく感じます。

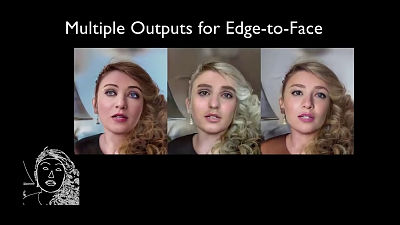

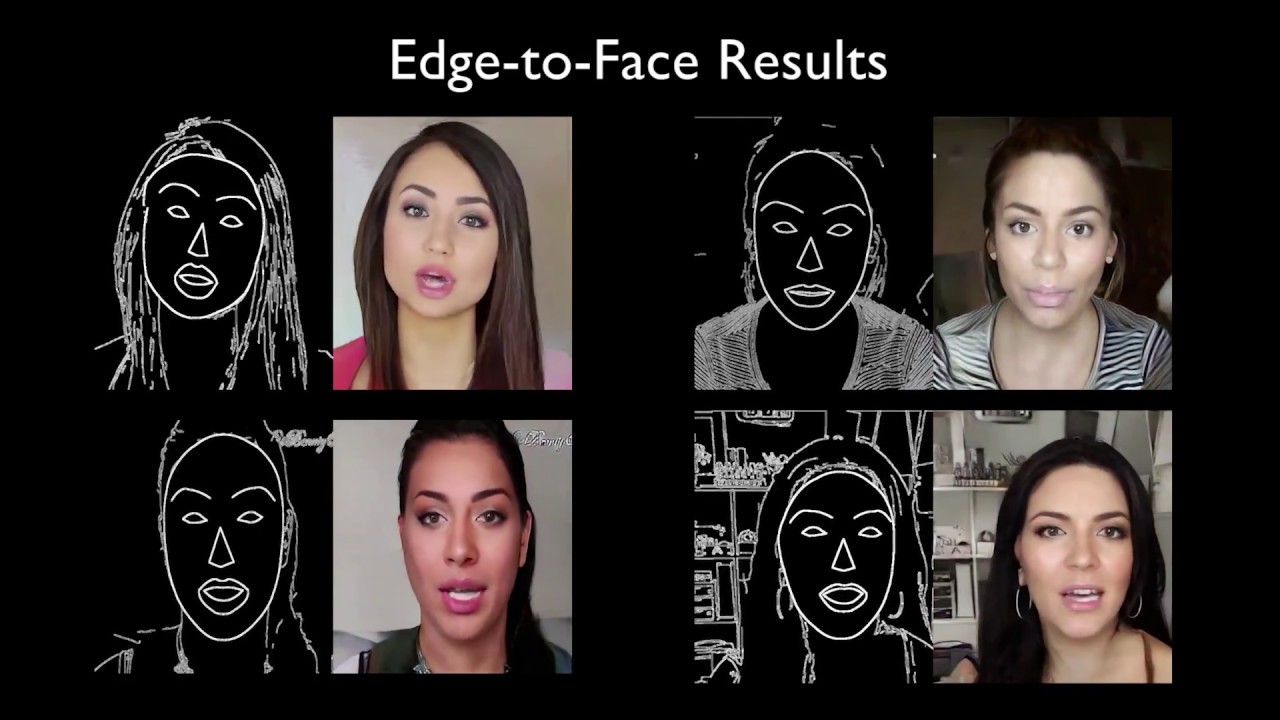

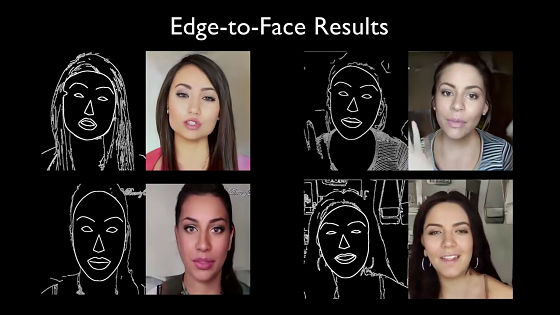

vid2vidは、要素ごとに区分けされた素材を与えられることで、さまざまな映像を作り出してしまうことができるとのこと。このように、顔の要素を輪郭化した素材から人の顔を再現したり……

同じ素材から、髪や肌の色や顔立ちまで違う人物を再現してしまうことも可能。

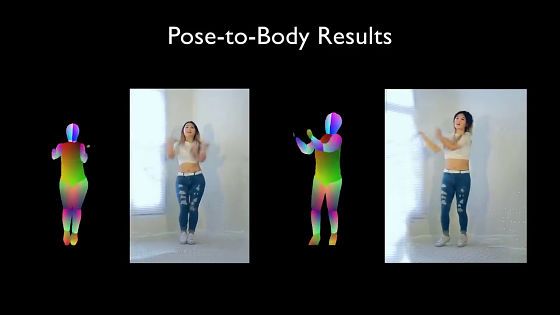

以下のダンスシーンでも人物は生成されたものですが、そこに自然な影が映っていることも、リアルさが増す要素となっている模様です。

冒頭の自動車のシーンで、背景をガラッと入れ替えてしまうことも可能です。

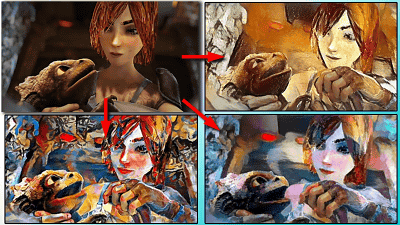

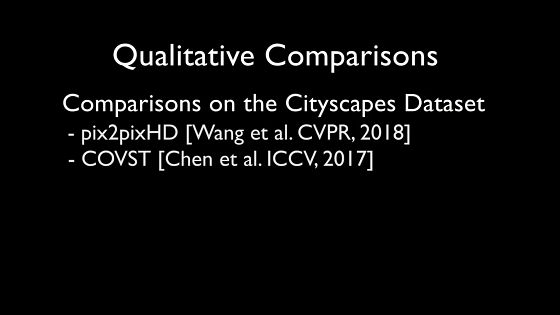

vid2vidは、既存の最新テクノロジー「pix2pixHD」や「COVST(COherent Video Style Transfer)」などと比較しても、品質が高いことが特長であるとのこと。

左上が入力素材で、右上がpix2pixHD、左下がCOVSTによって生成された映像なのですが、いずれも動きに不自然な点が目立ったり、明るさが妙に変化したりと、とても自然な仕上がりとはいえない状態。それに比べてvid2vidが生成した右下の映像は、いわゆる「ヌルサク」ともいえるナチュラルな様子に仕上がっていることが一目でわかります。

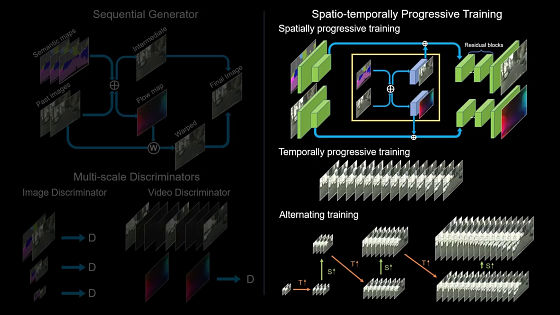

vid2vidは、映像を変換するAIを新たな方法で学習させたことで生み出されたもの。チームは、静止画と映像それぞれで内容を認識させる「ディスクリミネーター」を使い、「Spatio-temporally Progressive Training(時空間進行性学習)」と呼ばれる手法でAIに学習を行わせています。

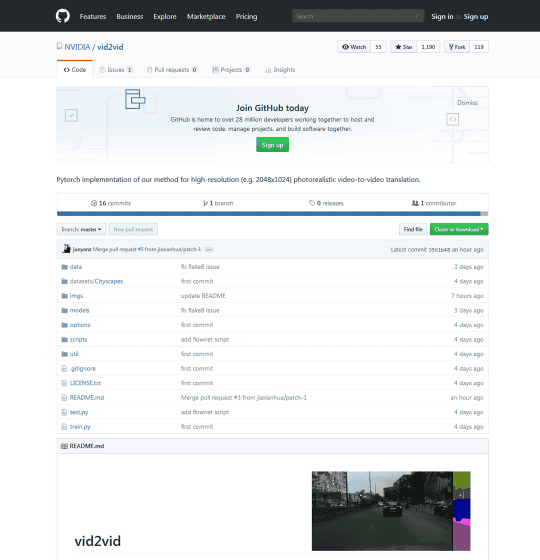

vid2vidのアルゴリズムやデータセットは、以下のGithubのリンク先で公開されています。

GitHub - NVIDIA/vid2vid: Pytorch implementation of our method for high-resolution (e.g. 2048x1024) photorealistic video-to-video translation.

https://github.com/NVIDIA/vid2vid

・関連記事

Googleがディープラーニングを使ってプロレベルの写真を自動生成できる「バーチャルフォトグラファー」を開発 - GIGAZINE

ディープラーニングで既存の映像をありとあらゆる絵画テイストに自動で変換できる驚異のアルゴリズム - GIGAZINE

手描きの線画が妙にリアルで恐ろしげなイラストに変換される「The fotogenerator」 - GIGAZINE

適当に描いた図形が「ネコ」へ自動変換される「edges2cats」 - GIGAZINE

ディープラーニングでリアルタイムに声をボカロのものに変換する試み - GIGAZINE

・関連コンテンツ

in 動画, ソフトウェア, Posted by darkhorse_log

You can read the machine translated English article 'Vid2vid' which automatically generates ….