カラフルな手袋による安価で高速な手の動作認識システムをMITが開発

リモコンを振ってゲームをプレイする任天堂の「Wii」のように、機器をジェスチャーで操作することは一般的になってきています。

そしてマサチューセッツ工科大学(MIT)の研究チームが、非常に高速に処理できる、手の動作を認識するシステムを開発しました。動作に必要なものはカラフルな手袋とウェブカメラのみであるため、従来よりも非常に安価なシステムになっています。

詳細は以下から。

Gesture-based computing on the cheap

MITのRobert WangとJovan Popovićが開発したシステムでは、カラフルな手袋とノートPCに標準搭載されているウェブカメラ1台を用いるだけで、カメラで捉えた画像を遅延なしで三次元空間上の手のデータに変換することができ、さらに場所やユーザーが変わってもキャリブレーション可能です。

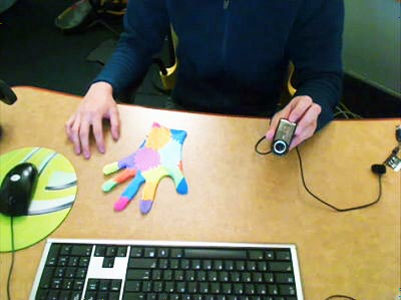

認識に必要な手袋とウェブカメラ。

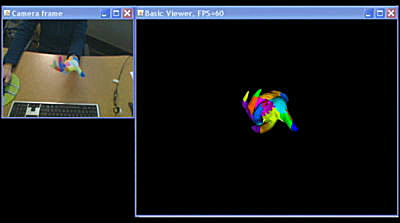

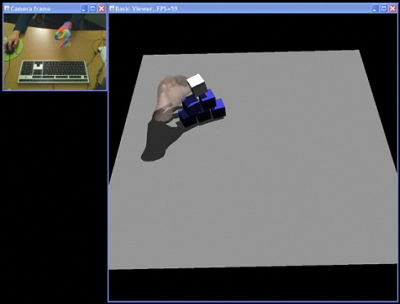

手袋をはめてみたところ。左がカメラ画像で右がそこから得られた三次元オブジェクト。ちゃんとカメラの画像どおりになっています。なお、手袋は10色を用いた20の複雑な形のピースからなっており、色や形については、カメラから見た手の背後の状態や光源の影響を受けたとしても区別でき、さらに似た色がなるべく重ならないように慎重に選ばれているそうです。

手の情報を取得する手順としては、まず、ウェブカメラで取得した画像から背景を取り除いて手袋だけを切り出してから、40×40ピクセルの画像データにサイズを縮小します。あとはその画像データをあらかじめ登録しておいたデータベース上から検索するだけです。検索された画像は手の形状に関する細かい情報を持っているため、指の位置などを計算で求める必要がなく高速に得ることができます。

現時点での問題は画像データベースがやや大きいこと。画像自体は40×40ピクセルと非常に小さいのですが、数が非常に多いため数百メガバイト必要です。

同様のジェスチャーベースのユーザインタフェースの研究では部屋に複数台のカメラを取り付ける必要がありましたが、この手法ではウェブカメラ1台で済みます。また、別の指先にカラーテープを着けてカメラで認識する研究では指先の情報しか取れませんが、この手法では手の甲の位置なども取得できます。

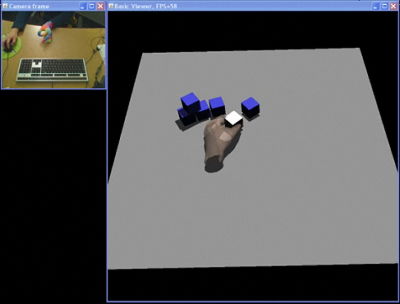

手袋とウェブカメラのみで実現可能なため、今後はこの手法を利用したゲームなどが出てくるかもしれません。リンク先の動画内にある、ブロック積み上げのデモではこの手法を用いてリアルタイムに三次元オブジェクトを操作しています。

ブロックをつまんで持ち上げた結果。

タイヤパーツの分解操作のデモ。両手を使うことで回転操作ができるようです。

パーツをつかんで取り出したところ。

・関連記事

空中で指を動かすだけでタイピングできる携帯機器向けの次世代インターフェースが開発される - GIGAZINE

慶應義塾大学、脳内イメージでPCを操作できる技術の開発に成功 - GIGAZINE

62インチの仮想画面を実現する映像用電子メガネ「iWear AV920」 - GIGAZINE

ジェスチャーでモニター上にスイッチが出現、動きを認識して照明操作できる画像認識LSIのデモムービー - GIGAZINE

現実世界で表現された「PONG」のムービーあれこれ - GIGAZINE

仮想世界「セカンドライフ」がテロリストの訓練場に - GIGAZINE

・関連コンテンツ

in サイエンス, Posted by darkhorse_log

You can read the machine translated English article MIT develops low-cost, high-speed hand m….