OpenAIとAnthropicが未発表AIを政府機関へ提出することに合意

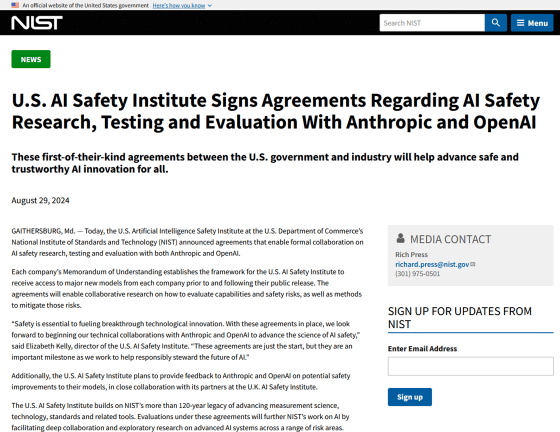

アメリカ国立標準技術研究所の内部組織である「U.S. Artificial Intelligence Safety Institute(アメリカAI安全研究所)」が、OpenAIおよびAnthropicと「リリース前のAIのテストに関する契約」を締結したことを発表しました。

U.S. AI Safety Institute Signs Agreements Regarding AI Safety Research, Testing and Evaluation With Anthropic and OpenAI | NIST

https://www.nist.gov/news-events/news/2024/08/us-ai-safety-institute-signs-agreements-regarding-ai-safety-research

今回の契約は、アメリカAI安全研究所がOpenAIおよびAnthropicのリリース前のAIモデルにアクセスする枠組みを確立するものです。アメリカAI安全研究所は両社のAIモデルにアクセスすることで機能および安全リスクの評価が可能となります。また、アメリカAI安全研究所は両社と共にAIの安全リスクを軽減する方法を研究する意向を示しています。

さらに、アメリカAI安全研究所はOpenAIとAnthropicの新型AIモデルに関する安全性評価をイギリスAI安全研究所に共有することも明らかにしています。

OpenAIのサム・アルトマンCEOは「私たちは将来のモデルのリリース前テストについて、アメリカAI安全研究所と合意に至ったことをうれしく思います。私たちは多くの理由からAIの安全テストが国家レベルで実施されることが重要だと考えています。アメリカは引き続き主導的な役割を果たす必要があります」と述べ、アメリカAI安全研究所との取り決めを歓迎しました。

we are happy to have reached an agreement with the US AI Safety Institute for pre-release testing of our future models.

— Sam Altman (@sama) August 29, 2024

for many reasons, we think it's important that this happens at the national level. US needs to continue to lead!

なお、OpenAIは数学を解けるAIモデル「Strawberry」を開発しており、アメリカ国家安全保障局(NSA)にデモを披露したと報じられています。

OpenAIがアメリカ当局者に対し「Strawberry」と呼ばれる画期的な成果をデモ、コード名「Orion」という主力LLMのトレーニングデータを作成することでGPT-4越えの性能を目指す - GIGAZINE

・関連記事

OpenAIが評価額14兆円超えの資金調達ラウンドに向けて交渉中との報道、ベンチャーキャピタルが約1400億円を拠出してリードしMicrosoftも参加か - GIGAZINE

OpenAI・Amazon・Microsoftなどの大手IT企業が「AI生成コンテンツへのラベル付与を義務付ける法案」に賛同 - GIGAZINE

「GPT-4oには人間の政治思想に影響を与えるリスクが中程度ある」とOpenAIが発表 - GIGAZINE

Anthropicが対話型生成AI「Claude」各モデルのシステムプロンプトの変更ログを公開、大手AIベンダーとしては初 - GIGAZINE

・関連コンテンツ

You can read the machine translated English article OpenAI and Anthropic agree to submit unp….